Verknotet Was ist Kubernetes?

„Kubernetes“ ist eine Plattform zur Verwaltung von Container-Workloads und -Diensten, welche die IT-Branche im Sturm erobert hat. Ursprünglich aus Googles Feder unterliegt Kubernetes einer quelloffenen Lizenz. Das Kubernetes-Ökosystem umfasst zahlreiche Dienste, Erweiterungen und Werkzeuge und wird von zahlreichen Systemintegratoren unterstützt.

Anbieter zum Thema

Die Bezeichnung Kubernetes stammt aus dem Griechischen und bedeutet so viel wie Steuermann oder Pilot. Konzeptionell zieht es Inspiration aus Googles Erfahrungen mit der Ausführung verteilter, massiv skalierbarer Produktions-Workloads in Hyperscale-Rechenzentren.

Kubernetes unterstützt sowohl die Automatisierung von Workloads als auch die deklarative Konfiguration im kleineren Maßstab.

Die Funktionsweise von Kubernetes

Eine Kubernetes-Bereitstellung hantiert mit Clustern. Ein Cluster ist eine Gruppe von Maschinen, den so genannten Knoten, welche containerisierte Anwendungen unter der administrativen Kontrolle von Kubernetes.

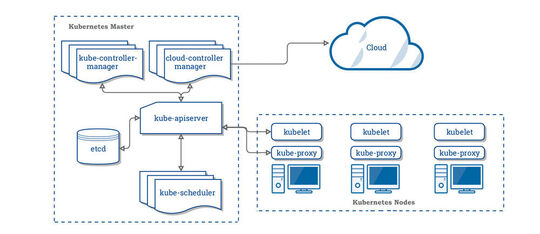

Die Architektur eines Kubernetes-Clusters ist recht übersichtlich. Ein Cluster verfügt über mindestens einen Arbeitsknoten (worker node) und mindestens einen Hauptknoten (master node). Die Arbeitsknoten hosten die so genannten Pods, die Komponenten der Anwendung. Die Hauptknoten verwalten die Arbeitsknoten und die Pods in ihrem jeweiligen Cluster. Zur Gewährleistung von Failover und Hochverfügbarkeit benötigt ein Cluster mehrere Hauptknoten.

Die Komponenten der Kontrollebene

Die Kontrollebene eines Kubernetes-Clusters bilden die Master-Komponenten. Diese Elemente der Architektur zeichnen für administrative Entscheidungen mit `globaler´ Wirkung verantwortlich, wie zum Beispiel das Scheduling. Sie lassen sich auf jeder Maschine im Cluster ausführen. Der Einfachheit halber die Initialisierungsskripte starten Elemente der Kontrollebene gewöhnlich auf derselben Maschine und führen die Container der Anwendung woanders aus.

API-Server: Dieses Front-End der Kontrollebene von Kubernetes macht die API verfügbar; die Hauptimplementierung, kube-apiserver, skaliert horizontal im Einklang mit dem Bedarf

etcd: Dieser konsistente und hochverfügbare Schlüsselwertspeicher dient als persistenter Speicher für Daten des Cluster.

kube-scheduler: Diese Komponente der Steuerungsebene überwacht die Erstellung von Pods und wählt für sie einen Knoten zur Ausführung unter Einbezug von Kriterien wie die Ressourcenanforderungen der Workloads, Richtlinien für die Nutzung von Hard- und Software, Spezifikationen der Affinität und Anti-Affinität, Datenlokalität, Interferenz zwischen Workloads und Deadlines.

kube-controller-manager: Die Komponente der Kontrollebene, welche die verschiedenen Kontroller zur Steuerung von Knoten, Replikation von Pods, Endpoints, Services-Accounts und Token koordiniert

cloud-controller-manager: Diese Komponente führt Kontroller aus, welche mit der Cloud-Umgebung des Infrastrukturanbieters interagieren.

Master-Komponenten können auf jedem Computer im Cluster ausgeführt werden. Richten Sie jedoch der Einfachheit halber Skripts ein, die in der Regel alle Master-Komponenten auf demselben Computer starten und keine Benutzercontainer auf diesem Computer ausführen. Ein Beispiel für eine Multi-Master-VM-Konfiguration finden Sie unter Erstellen von Hochverfügbarkeits-Cluster.

Die Bestandteile eines Knotens

Eine Gruppe von Kubernetes-Komponenten läuft auf jedem Knoten, um die Lauffähigkeit der Pods zu gewährleisten und die Kubernetes-Runtime am Leben zu halten.

kubelet: Dieser Agent gewährleistet, dass in einem Pod "gesunde" Container unter der Kontrolle von Kubernetes laufen

kube-proxy: Dieser Netzwerkproxy läuft in jedem Knoten in einem Kubernetes-Cluster und wacht hier über die Netzwerkrichtlinien und kann sich hierzu die Paketfilterebene des Betriebssystems zunutze machen (sofern vorhanden und verfügbar).

Container Runtime: Die Container-Laufzeitumgebung von Kubernetes unterstützt neben „Docker“ auch „containerd“, „cri-o“, „rktlet“ und jede Implementierung des „Kubernetes CRI“ (Container Runtime Interface).

Die einzige Komponente der Kontrollebene, welche Remote-Dienste nach außen hin bereitstellt, ist der API-Server. Alle Kommunikationspfade vom Cluster zum Master-Knoten enden am API-Server.

In einer typischen Bereitstellung ist der API-Server so konfiguriert, dass er Remote-Verbindungen an einem sicheren HTTPS-Port (443) mit einer oder mehreren aktivierten Formen der Client-Authentifizierung überwacht. Eine oder mehrere Formen der Zugriffsautorisierung sollten aktiviert werden, insbesondere wenn anonyme Anfragen oder Token zum Zugriff auf Dienste zulässig sind.

Die Sicherheitsaspekte einer Kubernetes-Bereitstellung

Auf dem Weg vom Master (API-Server) zum Cluster gibt es zwei primäre Kommunikationspfade. Zum einen besteht die Möglichkeit im Verbindungsaufbau vom API-Server zum HTTPS-Endpoint des Kubelet-Prozesses, der auf jedem Knoten im Cluster ausgeführt wird. Die Standardkonfiguration macht stillschweigend die Annahme, dass Kubernetes in einem vertrauenswürdigen Netzwerk läuft.

Da der API-Server standardmäßig die Zertifikatsprüfung unterlässt, besteht bei diesem Setup die Gefahr einer MITM-Attacke (Man-in-the-Middle-Attacke) . Um diesen Angriffsvektor zu neutralisieren, kann der Administrator entweder die Zertifikatsprüfung einstellen oder SSL-Tunneling aktivieren.

- Beim Einsatz von SSH-Tunneling initiiert der API-Server einen SSH-Tunnel zu jedem Knoten im Cluster (wobei er eine Verbindung zum SSH-Server herstellt, der Port 22 überwacht) und leitet den gesamten Datenverkehr, der für ein Kubelet, einen Knoten, einen Pod oder einen Dienst bestimmt ist, durch den Tunnel. Dieser Tunnel stellt sicher, dass der Datenverkehr nicht außerhalb des Netzwerks ausgesetzt wird, in dem die Knoten ausgeführt werden Letzteres ist eigentlich auch schon wieder veraltet; die Kubernetes-Community tüftelt an einer Ersatzlösung.

- Der zweite Kommunikationspfad führt vom API-Server zu einem beliebigen Knoten, Pod oder Dienst über die Proxy-Funktionalität von Kubernetes. Standardmäßig erfolgt der Verbindungsaufbau unverschlüsselt ganz einfach via HTTP.

Der Administrator kann zwar HTTPS konfigurieren, aber die Zertifikatsvalidierung findet dann trotzdem nicht statt. Diese Art des Verbindungsaufbaus eignet sich nicht zur Ausführung in nicht vertrauenswürdigen Netzen.

Die Add-ons

Mit zusätzlichen Addons lassen sich zusätzliche Features implementieren. Zu den empfehlenswerten Erweiterungen zählen DNS, Dashboard (eine Web-basierte Admin-Schnittstelle), Container Resource Monitoring und Logging auf Cluster-Ebene.

Die Version 1.0 von Kubernetes wurde im Juli 2015 veröffentlichtt. Nahezu zeitgleich kündigte Google die Gründung der Cloud Native Computing Foundation (CNCF) unter dem Dach der Linux Foundation an.Die Google-Entwickler übergaben das Kubernetes-Projekt der Stiftung, die seither die Sourcen von Kubernetes hostet.

*Das Autorenduo Anna Kobylinska und Filipe Pereira Martins arbeitet für McKinley Denali Inc. (USA).

Artikelfiles und Artikellinks

(ID:46313703)

:quality(80)/p7i.vogel.de/wcms/9b/71/9b71f0cbf75b2fcdb03b0515f7de85b1/0131546105v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/40/11/4011ec959c9f026bff4c9b26556000b8/0131576135v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ab/da/abda4198eec4667e63121b4038eb9696/0127011549v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/cb/71/cb71e590a7dc308eaba6d56d64b7eb88/0131454836v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8a/e5/8ae5e6328c2f85c5f9e73dab50830070/0131318362v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/6a/d9/6ad97677dbd05d030c274d5da2ac55fa/0131318196v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e2/31/e231589b0fc5261a4d5174e8efde28d9/0131455263v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e0/98/e09817246d3203a4b491b223997c76dd/0131317840v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a1/dd/a1ddf02ccf707e1002dc9f0b0c41f6cf/0131298906v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/af/21/af21f7761950c841306c223f77f91155/0131423495v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/80/6e803451356aedef2f7983857510d019/0131541101v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/94/179447f80cab81cfdbadd85c46cc9b72/0131191448v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c6/2b/c62b87f2a390d03996b4db6e3c51b1ee/0131312711v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/b8/36b8ba441409b46b71455151dfc60538/0131002266v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/49/7a/497af014bb9c80eb964cbd4b170f1af6/0130709118v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/b4/66b480de5d9d98134871015eef2737fe/0131527877v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8f/c0/8fc06e30fbc48da5ff5e068b2a32fc40/0131517134v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e9/1f/e91fc245c584b6ed72107ab6433bbf9a/0131310055v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/95/6e9529f775612253d132e9002edc3c6f/0131312462v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/ec/41ecbc8077275d54daf5895ae6f98b6c/0130998245v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/60/de/60ded37a20a00/logo-vertiv.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/6a/03/6a032acb3d1c7/kentix-aa-logo-.png)

:fill(fff,0)/p7i.vogel.de/companies/65/6d/656def888f484/02-01-eps-logo-4c-rzi.jpeg)

:quality(80)/p7i.vogel.de/wcms/d6/70/d67006932f70bacb0dc440e3caadcb27/0127006250v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/1d/39/1d399b775de18953c4e7f9a090626c06/0127632042v2.jpeg)