HPE Discover More Greenlake im Zentrum

Von der Edge über das Datacenter bis in die Cloud: Bei HPE soll mit „Greenlake“ alles zum Service werden. Auf der HPE-Veranstaltung „Discover More“ in München stellte der Hersteller mit Greenlake Central einen zentrale Management-Service für die komplette Hybrid-IT-Umgebung vor.

Anbieter zum Thema

Die Vorteile der Cloud hinsichtlich Flexibilität und verbrauchsbasierter Abrechnung soll HPE Greenlake für die Rechenzentren der Kunden ermöglichen, das laut dem Hersteller in Sachen Performance und Compliance immer noch die erste Wahl ist. Gleichzeitig soll Greenlake Unternehmen den Weg in die Hybrid-Multi-Cloud ebnen, so sie ihn gehen wollen und es für sie sinnvoll ist.

Mit „Greenlake Central“ wird es durch eine zentrale Management-Plattform für die Multi-Hybrid-Cloud erweitert. „HPE Greenlake Central ist eine transformative Plattform, die das Spielfeld in der Hybrid-IT verändert”, sagt dazu Antonio Neri, CEO von HPE. „Der CIO kann jetzt als strategischer Service-Broker agieren, und jeder profitiert von einer konsistenten Cloud-Erfahrung, die zu geringeren Kosten und Risiken sowie zu einer größeren Auswahl, Kontrolle, Einfachheit und Geschwindigkeit führt.” Für den Hersteller ist der Start der Management-Plattform ein weiterer Puzzlestein in der Strategie, bis 2022 das komplette Portfolio als Service anzubieten.

Greenlake Central als Management-Plattform

Greenlake Central ist eine als Service vorgestellte Software-Plattform, die aus mehreren Elementen besteht und unterschiedliche Aufgaben erfüllt. Für den CIO eines Unternehmens stellt der Service in einem Dashboard gesammelte Informationen über die Auslastung, die Kosten sowie die Sicherheitsprobleme und die Compliance der gesamten, über Greenlake genutzten Hybrid-IT-Infrastruktur zusammen.

Der CFO bekommt durch interaktive Diagramme eine detaillierten Einblick in die auflaufenden Kosten für die On-Premises oder in der Cloud verwendeten Ressourcen und kann so Budgetüberschreitungen schnell erkennen. Beispielweise wird vor übermäßiger oder unzureichender Nutzung von IT-Ressourcen gewarnt, sowohl lokal als auch in der Cloud. Auch werden so „verwaiste” VMs oder überdimensionierte Public-Cloud-Instanzen identifiziert.

Die IT-Abteilung oder ein betreuendes Systemhaus können über das Dashboard Workloads und virtuelle Maschinen ausrollen und verwalten. Zudem erhalten sie Warnungen bei Fehlern, Sicherheitsrisiken und Compliance-Problemen. Die werden über über eine Sammlung von Regeln erkannt, die für Audits genutzt werden. Für das Erstellen von Regeln sind keine speziellen IT-Kentnisse erforderlich. Diese Aufgabe kann also beispielsweise von der Rechtsabteilung oder externen Juristen erledigt werden.

:quality(80)/images.vogel.de/vogelonline/bdb/1654200/1654250/original.jpg)

Kundenkonferenz HPE Discover More 2019

HPE – die „Edge-to-Cloud-as-a-Service“-Company

Für DevOps ist Greenlake Central eine Pay-per-use-Plattform, über die sie schnell und einfach Applikationen in der Hybrid-Cloud ausrollen können, ohne sich um die darunterliegende Infrastruktur kümmern zu müssen. Den Anwendern wird schließlich ein Marktplatz geboten, über den sie Applikationen in der hybriden Cloud unkompliziert testen und ordern können. Neben der Private Cloud können derzeit Ressourcen auf AWS und Microsoft Azure verwaltet werden.

Im Prinzip soll mit Greenlake und Greenlake Central das Public-Cloud-Modell auf das eigene Rechenzentrum der Kunden übertragen werden: Sie müssen sich nicht mehr um die konkrete Hardware kümmern, sondern geben nur noch die Workloads und ihre Anforderungen an die Verfügbarkeit vor.

Für das Netzwerk-Management aus der Cloud bietet HPE schon seit einigen Jahren „Aruba Central“ an. Etwa 40.000 Kunden nutzen die Plattform bereits, so Ulrich Seibold, Channel-Chef bei HPE. Mit der wachsenden Verbreitung von Industrial IoT erwartet er hier noch einen deutlichen Zuwachs.

Den verzeichnet seine Firma auch mit Greenlake. Fast 40 Prozent betrug das Plus im Fiskaljahr 2019. Laut Seibold können die Partner in Deutschland mit Greenlake in erheblichem Umfang neue Kunden ansprechen. Bisher kommen diese ausschließlich aus dem Enterprise-Umfeld. Aktuell erweitert der Hersteller das Vertriebs- und Servicemodell auch in Richtung Mittelstand, also für Kunden mit 100 bis 500 IT-Arbeitsplätzen. Hier soll weiterhin die Distribution als Schnittstelle zu den Partnern agieren.

Greenlake für den Mittelstand

Das Pilotprojekt für Greenlake im Mittelstand hat HPE gemeinsam mit dem Systemhaus Bizteam verwirklicht. Viele Mittelstandskunden hätten immer noch Vorbehalte gegenüber der Public Cloud, erklärt Anton Braun, Geschäftsführer des Systemhauses, seien aber an den Vorteilen einer verbrauchsbasierten IT-Lösung interessiert. Für den Kunden in dem Projekt, eine mittelständische Klinik, sei Greenlake ideal, da hier durch die fortschreitende Digitalisierung im Gesundheitswesen ein massiv wachsender Storage-Bedarf erwartet werde, dessen Ausmaß sich aber nicht prognostizieren lasse.

Da aus Datenschutzgründen der Weg in die Public Cloud nicht gangbar ist, ermöglicht Greenlake ein flexibles Storage, die sich an den tatsächlichen Bedarf anpassen lässt, so Braun. Für Bizteam und den Kunden sei wichtig gewesen, dass das Systemhaus weiterhin den Service gewährleistet, was HPE mit Greenlake für den Mittelstand ermöglicht.

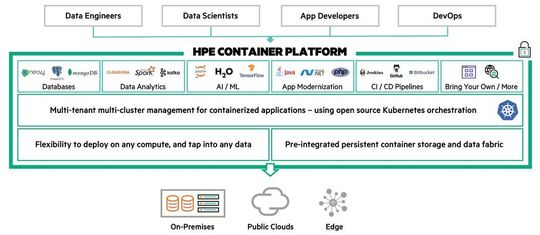

HPE Container Platform: Für cloudnative und monolithische Applikationen

Kubernetes ist gerade die angesagteste Technologie für die Container-Orchestrierung. Sie dient daher auch als Basis für die Container Platform von HPE, allerdings im Kombination mit Software der in diesem Jahr übernommenen Firmen Blue Data und Mapr. Die HPE-Lösung soll Container nicht nur aus VMs oder Cloud-Instanzen, sondern auch direkt auf Bare-Metal-Servern ausführen und so Kosten sparen und die Komplexitiät vermindern.

Generell verspricht HPE mit Blue Data ein deutlich einfacheres und schnelleres Ausrollen von Applikationen in Containern als mit einer reinen Kubernetes-Lösung. Zusätzlich sollen sich bestehende Applikationen auf Basis von Java, PHP oder .Net mit Hilfe der Data Fabric von Mapr für persistenten Storage einfach in Container packen lassen.

Die HPE Container Plattform wird als Subskription vertrieben. Sie ist im Rechenzentrum oder Edge-Umgebungen nicht auf HPE-Hardware beschränkt, und sie soll die Public Clouds aller relevanten Anbieter unterstützen.

Demenzforschung mit Memory-Driven Computing

Mit Memory-Driven Computing engagiert sich HPE selbst in der medizinischen Forschung. Auf der Discover More präsentierte der Hersteller ein Projekt, in dem er mit dem Deutschen Zentrum für Neurodegenerative Erkrankungen in der Helmholtz-Gemeinschaft (DZNE) kooperiert (siehe Kasten: „Lebensrettung per Memory-driven Computing bei Jungla und DZDE“. Der Forschungsverbund mit bundesweit zehn Standorten arbeitet eng mit Universtäten und Universitätskliniken zusammen.

Einer der Schwerpunkte das DZNE ist die Demenzforschung, bei der ein „Superdome Flex“ von HPE zum Einsatz kommt. Der Hochleistungsrechner nutzt Konzepte, die HPE für das Architekturprojekt „The Machine” entwickelt hat. Dieser massiv parallele ARM-Computer mit einem sehr großen nichtflüchtigen Speicherpool aus Memristoren war ursprünglich als als Produkt geplant, ließ sich dann aber aus technischen Gründen nicht realisieren.

Seitdem wird „The Machine” als Forschungsprojekt weitergeführt. Der Superdome Flex basiert zwar auf „Intel-Xeon“-Prozessoren, nutzt aber eine Kombination von DRAM und HPE Persistentem Speicher, um In-Memory-Computing-Anwendungen insgesamt 160 Terabyte Arbeitsspeicher zur Verfügung zu stellen. Dieser riesige Speicher wird in dem Projekt genutzt, um Daten aus Genom-Analysen deutlich schneller vergleichen zu können, als das bisher möglich war. In einem weiteren Schritt werden auch Daten aus anderen Quellen wie etwa bildgebenden Verfahren mit in den Datenbestand integriert, um sie für Analysen schnell zugänglich zu machen.

Artikelfiles und Artikellinks

(ID:46291735)

:quality(80)/p7i.vogel.de/wcms/66/3a/663ae529db74f304708a26681d66b273/0131573284v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bf/a9/bfa9522af622dfe0fca8fcf1ae0f157b/0131569943v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/40/11/4011ec959c9f026bff4c9b26556000b8/0131576135v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ab/da/abda4198eec4667e63121b4038eb9696/0127011549v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/3b/163bc234d4d71264517ebbeffaf9910b/0131633516v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/33/aa/33aab4afaa9cbf3b93381e13ba228049/0131602549v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/48/a0/48a062512b997888422d6fd83a7552f0/0131634933v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0a/83/0a8371885d52666e74c9b549a0a6050e/0131542674v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/6b/35/6b3528ecb1548d836b815c159a772d72/0131318428v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e2/31/e231589b0fc5261a4d5174e8efde28d9/0131455263v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/80/6e803451356aedef2f7983857510d019/0131541101v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/94/179447f80cab81cfdbadd85c46cc9b72/0131191448v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e0/98/e09817246d3203a4b491b223997c76dd/0131317840v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/b8/36b8ba441409b46b71455151dfc60538/0131002266v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/3b/0a/3b0a6454f10da767b7bee189834df9b7/0131639288v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/5d/6c/5d6cd85b4158d85fb69241d2a91421fb/0131626686v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/b4/66b480de5d9d98134871015eef2737fe/0131527877v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8f/c0/8fc06e30fbc48da5ff5e068b2a32fc40/0131517134v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/60/de/60ded37a20a00/logo-vertiv.jpeg)

:fill(fff,0)/images.vogel.de/vogelonline/companyimg/117800/117805/65.png)

:fill(fff,0)/p7i.vogel.de/companies/65/6d/656def888f484/02-01-eps-logo-4c-rzi.jpeg)

:quality(80)/images.vogel.de/vogelonline/bdb/1656900/1656958/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1656900/1656959/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1656900/1656960/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1656900/1656961/original.jpg)

:quality(80)/p7i.vogel.de/wcms/5a/f0/5af0d661a64ca6b2512c94f3f6b35d5c/0125399737v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/4b/6f/4b6f8cc555057a3956ca108724ce750d/0125785083v1.jpeg)