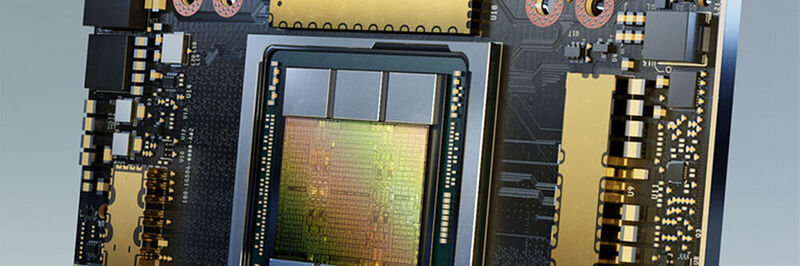

Die GPU für das KI-Supercomputing Der 80-Gigabyte-Grafikprozessor von Nvidia

Am heutigen Montag stellt Nvidia eine „A100“-GPU vor, die mit doppelt so viel Speicher wie der Vorgänger die Supercomputing-Plattform „HGX“ antreibt, die ihrerseits zu einem „AI Datacenter in a Box” stilisiert wird. Der neue Grafikprozessor mit HBM2e-Technologie verdoppelt den 40-Gigabyte-GPU-Speicher von „Ampere 100“ mit hoher Bandbreite auf 80 GB und liefert eine Speicherbandbreite von über 2 Terabyte pro Sekunde.

Anbieter zum Thema

Bryan Catanzaro, Vice President bei Nvidia im Bereich angewandte Forschung für Deep Learning, begründet diese Art des Ausbaus der technischen Kapazitäten. Sie befähigten eine noch größere Beschleunigung und ermöglichten zugleich noch größere Modelle und Datenmengen. „Um in der HPC- und KI-Forschung den neuesten Stand der Technik zu erreichen, müssen die größten Modelle gebaut werden, aber diese erfordern mehr Speicherkapazität und Bandbreite als je zuvor.“

Er betont, dass die A100-GPU mit 80 GB doppelt so viel Speicher wie das Vorgängermodell bietet, das erst vor sechs Monaten eingeführt worden ist. Zugleich durchbreche die Technik die Grenze von 2 TB/s. Der 80-GB-Grafikprozessor ist in der Nvidia-Hardware „DGX A100“ und der „DGX Station A100“erhältlich.

Außerdem unterstützen Systemanbieter wie Atos, Dell Technologies, Fujitsu, Gigabyte, Hewlett Packard Enterprise, Inspur, Lenovo, Quanta und Supermicro die Technik und bieten A100-ausgestattete Systeme an. Nach Angaben von Nvidia werden die integrierten Baseboards mit A100 80GB GPUs, die Inspur, Lenovo, Quanta und Supermicro heute angekündigt haben, in der ersten Hälfte des Jahres 2021 bereitstehen.

Gedacht sind diese Systeme für die Betankung datenintensiver Arbeitslasten, etwa im Bereich der KI-Trainings. So verfügen Systemmodelle für Empfehlungen wie DLRM über Tabellen, die Milliarden von Benutzern und Milliarden von Produkten enthalten können. A100 80 GB kann eine bis zu 3-fache Beschleunigung bieten, so dass diese Modelle schnell, in vielen Fällen nahe an der Echtzeit, und sehr präzise Empfehlungen geben können (siehe auch Beispiele aus der Bildergalerie).

Außerdem ermögliche die Prozessoreinheit auch ein Training der größten Modelle mit mehr Anpassungsparametern als bisher, und zwar innerhalb eines einzigen HGX-basierten Servers. Als Beispiel nennt Nvidia das Verarbeitungsmodell „GPT-2 für natürliche Sprache , verbunden mit generativen Fähigkeit für Texte. Dadurch entfalle die Notwendigkeit, Daten oder parallele Architekturen zu modellieren, was zeitaufwändig sein kann, aufwendig zu implementieren und zu langsam, wenn die Anwendung sich über mehrere Knoten erstreckt.

Wie auch die Vorgängerausführung kann die GPU mit seiner Multi-Instanz-GPU (MIG)-Technologie in bis zu sieben GPU-Instanzen partitioniert werden, mit jeweils 10 GB Speicher. Dies bietet etwa eine sichere Hardware-Isolierung und maximiert die GPU-Auslastung für eine Vielzahl kleinerer Arbeitsbelastungen.

Neben dem KI-Training soll auch das Inferencing profitieren

Das kommt etwa bei der KI-Inferenzierung von automatischen Spracherkennungsmodellen wie RNN-T zum Tragen. Eine einzelne A100 80GB MIG-Instanz kann viel größere Losgrößen als bisher bedienen und liefert einen 1,25x höheren Durchsatz in der Produktion von Schlussfolgerungen. Laut Nvidia hat ein großen Datenanalyse-Benchmark für den Einzelhandel im Terabyte-Bereich gezeigt, dass die 80GB-A100 die Leistung von bis zu 2x steigern konnte.

Aber auch für wissenschaftliche Anwendungen von Wettervorhersage bis Quantenchemie wird zunehmend Beschleunigung beim Rechnen nachgefragt. „Quantum Espresso“, eine Materialsimulation, hat mithilfe der Nvidia-GPU Durchsatzgewinne von fast 2x auf einem einzelnen Knoten erzielt.

Zu den Ausstattungsmerkmalen (siehe: Bildergalerie) der GPU A100 80GB gehören:

- Tensorcores der dritten Generation: Im Vergleich zur „Volta“-Generation bieten sie mit dem Format TF32 einen bis zu 20-fachen AI-Durchsatz sowie 2,5x FP64 für HPC, 20x INT8 für AI-Inferenz und Unterstützung für das BF16-Datenformat.

- größeren, schnelleren HBM2e-GPU-Speicher

- MIG-Technik: Verdoppelt den Speicher pro isolierter Instanz und bietet bis zu sieben MIGs mit jeweils 10 GB.

- NVLink und NVSwitch der dritten Generation: Bietet die doppelte GPU-zu-GPU-Bandbreite im Vergleich zur Interconnect-Technologie der vorherigen Generation, also beim Datentransfer zum Grafikprozessor wird auf bis zu 600 Gigabyte pro Sekunde beschleunigt.

Das AI-Datacenter-in-a-Box

Ergänzend zur Vorstellung der A100-80GB-GPU stellt Nvidia zur Supercomputing-Konferenz „SC20“ den KI-Server „DGX Station A100“ vor. Es handelt sich um ein integriertes System im Petascale-Format – mit bis zu mit bis zu 320 Gigabyte GPU-Speicher-, das für Arbeitsgruppen in Büros und Laboren gedacht ist.

Es ist die zweite Generation des Systems und bietet laut Nvidia 2,5 PetaFlops KI-Leistung. Darin stecken vier von den jüngsten A100 Tensor Core Grafikprozessoren, die per NVLink verbunden sind. DGX Station A100 ist außerdem die einzige Workstation, die die Technik Multi-Instance GPU (MIG) unterstützt. Dadurch bietet ein einzelner Rechner bis zu 28 separate GPU-Instanzen, auf denen sich parallel Jobs unterschiedlicher Benutzer ausführen lassen – laut Nvidia ohne Beeinträchtigung der Systemleistung.

Der Vorteil liegt laut Charlie Boyle, Vice President und General Manager für DGX-Systeme bei Nvidia auf der Hand: „Die DGX Station A100 bringt die KI aus dem Rechenzentrum mit einem System der Serverklasse, das sich von Wissenschaftsteams und KI-Experten praktisch überall nutzen lässt.“

Das zeige sich auch in der Akzeptanz der DGX-Systeme;

- Die BMW Group Produktion nutzt Nvidia DGX-Stationen, um KI-Modelle einzusetzen, die den Betrieb verbessern.

- Das DFKI, das Deutsche Forschungszentrum für Künstliche Intelligenz, verwendet die DGX-Station zur Erstellung von Modellen mit denen Herausforderungen aus Gesellschaft und Industrie angegangen werden, einschließlich Systemen, die den Notfalldiensten helfen, schnell auf Naturkatastrophen zu reagieren.

- Lockheed Martin nutzt DGX-Station zur Entwicklung von KI-Modellen, die Sensordaten und Protokolle nutzen, um den Wartungsbedarfs vorherzusagen. Das trägt erhöht die Betriebsbereitschaft, die Sicherheit für die Mitarbeiter und reduziert die Betriebskosten.

- NTT Docomo, Japans führender Mobilfunkbetreiber mit über 79 Millionen Abonnenten, verwendet DGX Station zur Entwicklung KI-gesteuerter Dienste, etwa in der Bilderkennung.

- Das Pacific Northwest National Laboratory verwendet die Rechner, um, fokussiert auf Fragen aus dem Energiebereich, zur nationalen Sicherheit beizutragen, durch Forschungen auf dem Gebiet der Chemie, der Geowissenschaften und Datenanalyse.

Mit und ohne Rechenzentrum

Die DGX Station A100 benötigt dabei weder Strom noch Kühlung in Rechenzentrumsqualität, erlaubt aber eine Fernwartung, mit Funktionen, die ansonsten den DGX A100-Systeme für Datacenter zur Verfügung stehen. So können laut Hersteller Systemadministratoren alle Verwaltungsaufgaben problemlos über eine Remote-Verbindung ausführen –selbst dann, wenn die Wissenschaftler zu Hause aus arbeiteten. Generell ist das System mit vier 80-GB- oder 40-GB-A100 Tensor Core-GPUs erhältlich.

Allerdings lassen sich die DGX-Rechner, und zwar mit 640 GB, auch in den „Nvidia DGX SuperPOD“ integrieren. AI-Supercomputer sind in Einheiten von 20 DGX A100-Systemen erhältlich. Die ersten SuperPOD-Systeme, die damit bestückt werden, betreffen „Cambridge-1“, ein Supercomputer, der im Gesundheitswesen eingesetzt wird, sowie „Hipergator“ der University of Florida.

Nvidia DGX Station A100 und Nvidia DGX A100 640 GB Systeme sollen noch in diesem Quartal erhältlich sein.

Vernetzt: Mellanox Infiniband für Exascale AI Supercomputing

Die siebte Generation von Mellanox Infiniband „NDR 400 G“ soll „ultra-kurze“ Latenzzeiten und doppelten Datendurchsatz ermöglichen. Die üblichen Hardwarehersteller - Atos, Dell Technologies, Fujitsu, Inspur, Lenovo und Supermicro - haben bereits angekündigt, die Technik in ihre HPC-Systeme zu integrieren. Außerdem gibt es erste Unterstützungsbekundungen von Partnern aus dem Bereich Storage-Infrastruktur, etwa von DDN und IBM Storage.

Nach Unternehmensangaben bietet NDR 400 G die 3-fache Switch-Port-Dichte und steigert die KI-Beschleunigung beim Einschalten um das 32-fache. Der Datendurchsatz verdoppelt sich auf 400 Gigabit pro Sekunde. Die bidirektionale Switch-Kapazität steigt um das Fünffache auf 1,64 Petabit pro Sekunde bei 2048 NDR Ports.

Microsoft Azure wird der erste Cloud-Provider sein, der mit den „HBv2“-VMs die HDR-Netzwerktechnik unterstützt. Insbesondere will Microsoft MPI-HPC-Anwendungen adressieren und spricht von einer Skalierung, die 80.000 Cores übersteigt.

Mellanox Sharp

Die dritte Generation der Techmik „Mellanox Sharp“ erlaubt es, dass KI-Trainingsoperationen durch Infiniband ausgelagert und beschleunigt werden. Das bringt den Boost von 32facher Beschleunigung. Zudem lässt sich die Technik mit dem „Nvidia Magnum I/O“-Stack kombinieren.

Edge-Switches, die auf der Infiniband-Architektur basieren, bieten so einen aggregierten bidirektionalen Durchsatz von 51,2 Tb/s mit einer Kapazität von mehr als 66,5 Milliarden Paketen pro Sekunde. Die auf Mellanox Infiniband basierenden modularen Switches werden bis zu einem aggregierten bidirektionalen Durchsatz von 1,64 Petabit pro Sekunde übertragen; das ist 5x höher als bei der Vorgängergeneration.

Zugleich sollen sich Kosten sparen lassen. Laut Nvidia fallen bis zu 1,4 x geringere Netzwerkkosten an und die bis zu 1,6 x geringere Energiekosten.

Artikelfiles und Artikellinks

(ID:46992904)

:quality(80)/p7i.vogel.de/wcms/66/3a/663ae529db74f304708a26681d66b273/0131573284v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bf/a9/bfa9522af622dfe0fca8fcf1ae0f157b/0131569943v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9b/71/9b71f0cbf75b2fcdb03b0515f7de85b1/0131546105v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/40/11/4011ec959c9f026bff4c9b26556000b8/0131576135v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/33/aa/33aab4afaa9cbf3b93381e13ba228049/0131602549v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/24/33/2433df5a7766b410cdc2360cd26319df/0131582097v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0a/83/0a8371885d52666e74c9b549a0a6050e/0131542674v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/6b/35/6b3528ecb1548d836b815c159a772d72/0131318428v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e2/31/e231589b0fc5261a4d5174e8efde28d9/0131455263v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e0/98/e09817246d3203a4b491b223997c76dd/0131317840v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/80/6e803451356aedef2f7983857510d019/0131541101v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/94/179447f80cab81cfdbadd85c46cc9b72/0131191448v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ab/da/abda4198eec4667e63121b4038eb9696/0127011549v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c6/2b/c62b87f2a390d03996b4db6e3c51b1ee/0131312711v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/b8/36b8ba441409b46b71455151dfc60538/0131002266v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/3b/0a/3b0a6454f10da767b7bee189834df9b7/0131639288v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/5d/6c/5d6cd85b4158d85fb69241d2a91421fb/0131626686v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/b4/66b480de5d9d98134871015eef2737fe/0131527877v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8f/c0/8fc06e30fbc48da5ff5e068b2a32fc40/0131517134v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/ec/41ecbc8077275d54daf5895ae6f98b6c/0130998245v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/63/e5/63e5f25ac31ef/logo.png)

:fill(fff,0)/p7i.vogel.de/companies/60/de/60ded37a20a00/logo-vertiv.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/66/c3/66c33d1f71ef2/daxten-logo-600-x-600.jpeg)

:quality(80)/images.vogel.de/vogelonline/bdb/1769000/1769043/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1769000/1769046/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1769000/1769047/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1769000/1769048/original.jpg)

:quality(80)/p7i.vogel.de/wcms/33/aa/33aab4afaa9cbf3b93381e13ba228049/0131602549v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/02/1f/021f058a5e5a77b7220e4b0162eaace6/0130189348v2.jpeg)