Neue Chips, neue Player, alte und neue Probleme Supercomputing und KI werden synonym

Die „ISC 2019“ hat deutlich gezeigt, dass Künstliche Intelligenz (KI) allmählich synonym mit High Performance Computing (HPC) wird. Im Wettrennen zu performanter KI-Technologie gibt es Gewinner und Verlierer – sowie ein paar nicht ganz unbedeutende Hürden.

Anbieter zum Thema

Der HPC- und Chip-Markt befindet sich wegen KI in einem tiefgreifenden Wandel. Mario Morales, Analyst bei IDC, sagt, dass die bisherigen großen Spieler im Chip-Markt wie etwa Intel und Nvidia nicht automatisch die Gewinner von morgen sein werden. „Intel befindet in einem internen Umbau, um sich den Workloads, die KI verursacht, besser anzupassen.“

CPUs wie „Xeon“ von Intel, die laut Hyperion Research immerhin einen HPC-Marktanteil von über 94 Prozent innehaben, erledigen am besten den Inferenz-Teil im Deep Learning, während GPUs wie die von Nvidia – oder auch FPGAs – führend beim Training-Teil von KI-Modellen sind. Aber es kommt Konkurrenz auf.

Es geht um die Verteilung eines großen Kuchens: IDC hat für Ende 2019 einen HPC-Marktumfang von fast 35,8 Milliarden Dollar vorausgesagt. Er soll sich bis 2022 verdoppeln. Als am schnellsten wachsendes Segment soll der Markt für HPC-Datenanalyse mit AI laut Hyperion Research bis 2023 um 30,3 Prozent zulegen.

KI-Intelligenz wandert an die Edge

Die Herausforderung für Intel & Co. liege laut Morales nun darin, dass KI erstens an die IT-Peripherie verlegt wird, wo die Daten erzeugt werden, etwa von IoT-Sensoren. Zweitens seien alle diese Endpunkte in Hunderten von unterschiedlichen Branchen platziert, vom Gesundheitswesen über Automobilbau bis zur Transportlogistik. „Es gibt bislang keine Architektur, die alle diese Branchen mit KI-Frameworks versorgen könnte“, so Morales.

Aber diese Frameworks werden bereits entwickelt, beispielsweise „Tensorflow“. Morales: „Es wird wohl ein Jahrzehnt dauern, bis eine solche Architektur alle Branchen mit Intelligenz versorgen kann, aber einige Anbieter arbeiten mit ihren Ökosystemen von Partnern daran.“

Das bedeutet auch, dass Platzhirsche wie Nvidia, AMD und Intel zunehmend Konkurrenz von den Hyperscalern bekommen werden: Google, Amazon und Facebook. „Diese bauen bereits längst ihre eigenen Chips“, oder lassen, wie Amazon, bei Intel bauen.

Weitere Rivalen sind laut Morales Startups, die ASICs und Appliances entwickeln. Graphcore etwa ist ein Chiphersteller, der ähnlich wie Intel und Nvidia Deep- und Machine Learning in eine massiv parallele Intelligence Processing Unit (IPU) packt. Das komplette ML-Modell ist im Prozessor untergebracht.

Intel für KI

Intel hat bereits reagiert. Es stellte auf der ISC zusammen mit Inspur eine KI-Appliance vor, die die Chinesen vermarkten. Eine weitere Kooperation ist der Chipriese mit Baidu eingegangen.

Wie Stefan Gillich, KI-Experte bei Intel, auf der ISC sagte, will Intel „in der zweiten Jahreshälfte“ zwei Nervana Neural Network Prozessoren auf den Markt bringen, je einen für das Training (NNP-T) und einen für die Inferenz (NNP-I). Mit Intel nGraph steht bereits ein quelloffener Modell-Compiler für verteilte Neuronale Netzwerke (DNNs) bereit.

:quality(80)/images.vogel.de/vogelonline/bdb/1593400/1593466/original.jpg)

Denkende Computer hüpfen über einen Meilenstein

Intel stellt ein System mit 64 neuromophen Chips vor

„Mit DL Boost gibt es bereits Optimierungstechnologie in den Xeon-CPUs der zweiten Generation ebenso mit DAOS, Distributed Architecture Object Storage und Optane Data Center Memory“, so Gillich. Zwar seien die aktuellen Xeon-CPUs eine gute Plattform für KI-Prozesse, aber 2020 will Intel, wie verlautete, eigene Xe-GPUs auf den Markt bringen. Sicher ist sicher.

Arms Aufholjagd

„Arm befindet sich aufgrund der wachsenden Konkurrenz in einer Aufholjagd“, so der IDC-Analyst Morales. Das Arm-Projekt „Trillium“ bringt eine Reihe von Chips hervor, die Deep-Learning- und ML-Fähigkeiten auf Edge-Geräte bringen sollen, um etwa Objekterkennung erleichtern.

Weitere Chips mit Namen wie „Cortex“ und „Mali“ sollen die Leistung von Mobilgeräten verbessern, das „Pelion“-Projekt baut Arms Präsenz im IoT-Markt aus. „Die Partnerschaft mit Nvidia soll Arm helfen, auch im Rechenzentrum Fuß zu fassen.“

Achillesferse Energie-Effizienz

Woran Arm bei Trillium sofort gearbeitet hat, ist die Erhöhung der Speicher- und Energie-Effizienz solcher Neural-Prozessoren (NPUs). Denn Energie entwickelt sich nicht nur bei Next-Generation-Rechnern mit Exaflops-Leistung zum bedeutendsten Flaschenhals.

Würden Milliarden von Edge-Geräten Energie beanspruchen, bräche das Stromnetz im Handumdrehen zusammen. Deshalb hat Intel auf der ISC eine umfassende Energieverwaltung namens Global Extensible Open Power Management (GEOPM) angekündigt. Sie soll den Energieverbrauch eines Systems optimieren, indem es sich dynamisch den Anforderungen der wechselnden Workloads anpasst.

„Sie können schon heute einen Exaflops-Rechner bauen – solange die Halle groß genug ist und Sie genügend Energie für Betrieb und Kühlung bereitstellen“, gibt Michael Resch, Leiter des Höchstleistungsrechenzentrums Stuttgart, zu bedenken. Die Raumfrage sei derzeit das größere Problem. „Energie ist aber hinsichtlich der Kosten derjenige Faktor, der jedem am meisten Sorgen bereiten muss. Denn wenn man die Energie extern bezieht, stellen sich die Fragen a) der Bereitstellung und b) der kontinuierlichen Versorgung, die die Kosten für den verbrauchten Strom bestimmt.“

Die Entwicklung beim Energiebedarf

Resch nennt Zahlen, die einem Klimaschützer das Blut in den Adern gefrieren lassen dürften: „Bei der (jährlichen) Energiebereitstellung für ein Exaflops-System bewegen wir uns im zweistelligen Millionenbereich (in Euro). Hinsichtlich des kontinuierlichen Verbrauchs habe ich für Ende 2021 Zahlen gesehen, die sich zwischen 40 und 200 Megawatt pro Exaflops-System bewegen. Will bzw. muss man das machen?“ Exaflops bedeutet: Trillion FLOP/s, Gleitkommaoperationen pro Sekunde.

Als Wissenschaftler sollte man auf diese Antwort parat haben, findet Resch: „Er oder sie sollte sagen können: Wir haben dieses und jenes Problem, können es lösen, und ja, es ist diesen Energiebedarf wert.“ Resch nennt Forschungsbereiche, die mit Exaflops-Systemen erkundet werden: „Wir sehen interessante Ansätze beim Versuch, ganze Systeme in allen Details zu berechnen. Das wird bereits bei Rolls-Royce und bei General Electric vorangetrieben, ein Thema, das in USA und Großbritannien in den Vordergrund gerückt ist.“ Man werde in England demnächst ein Prä-Exaflop-System sehen.

Modular Supercomputing Architecture (MSA)

Wie ein moderne modulare Rechner-Architektur (MSA) aussehen kann, demonstriert nach Abschluss der ersten von drei Ausbaustufen des „Juwels“-Systems das Forschungszentrum Jülich, eines von drei oder vier Höchstleistungsrechenzentren in Deutschland. Das erste Modul von Juwels ist eine Cluster-Komponente (CM) mit über 2500 Rechnerknoten, von denen jeder mit je zwei Xeon-24-Core-Skylake-CPUs und 96 GB an Hauptspeicher ausgestattet ist.

:quality(80)/images.vogel.de/vogelonline/bdb/1558000/1558006/original.jpg)

Das erste JSC-Supercomputing-Modul Deep-Est ist live

Der Prototyp für künftige modulare Supercomputer werkelt

Das ergibt einen Gesamtspeicher von 240 TB. Das zweite Modul soll der „Extreme Scale Booster“ (ESD) sein, das dritte das Data Analytics Module (DAM). Mehr über Extreme Scale Technologie („DeepEST“) und ihre in Europa verteilten Nutzer findet sich auf der FZJ-Webseite. Der Integrationspartner für das Gesamtprojekt ist Megware aus Chemnitz.

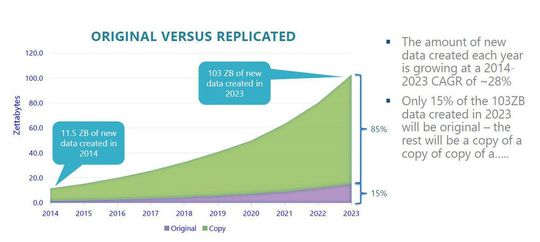

Neuer Storage-Standard

Das Thema Energie-Effizienz setzt auch im Storage-Bereich fort. Angesichts der explodierenden Datenmengen sind nach Ansicht von Hyperion Research Innovationen dringender in der Speichertechnik dringender denn je. Hersteller wie Supermicro bemühen sich, ihre Speichersysteme entsprechend zu gestalten. Supermicro stellte auf der ISC die branchenweit erste Familie von Server- und Storage-Systemen vor, die NVMe-Laufwerke des neuen Branchenstandards EDSFF (Enterprise and Datacenter Storage Form Factor) unterstützt (siehe auch: Enterprise and Datacenter Storage Form Factor, Supermicro-Server- und-Storage-Systeme mit EDSFF-UnterstützungEnterprise and Datacenter Storage Form Factor, Supermicro-Server- und-Storage-Systeme mit EDSFF-Unterstützung.) Das ermöglicht neue JBOF-Systeme (JBOF: Just a Bunch of Flash Drives).

:quality(80)/images.vogel.de/vogelonline/bdb/1584000/1584018/original.jpg)

Enterprise and Datacenter Storage Form Factor

Supermicro-Server- und-Storage-Systeme mit EDSFF-Unterstützung

EDSFF soll als erste All-Flash NVMe-Spezifizierung eine höhere Speicherdichte, eine verbesserte Verwaltung und optimale thermische Effizienz bieten. EDSFF baut auf NVMe-Kapazitäten auf und liefert laut Hersteller den sechsfach höheren Durchsatz sowie eine Reduzierung der Latenz um den Faktor sieben im Vergleich mit herkömmlichem Flash-Speicher.

Darüber hinaus biete EDSFF ein langes (E1.L) und ein kurzes (E1.S) Format. Zahlreiche Hersteller unterstützen laut Supermicro bereits EDSFF. Und Kunden hätten damit mehr Speicheroptionen mit einer Dichte von bis zu einem oder einem halben Petabyte bei 1U.

(ID:46064225)

:quality(80)/p7i.vogel.de/wcms/7c/52/7c5227112fa05f60e21a5880ef9e5b6b/0130929467v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/0c/b6/0cb659b857a730ab94b3641fb3932da5/0130793406v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/cc/65/cc65db9a62526f90292fb2fb1212b524/0130698558v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/23/5a/235a7cc8f0f6ee6992d706dd2422bb1f/0130911332v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/49/7a/497af014bb9c80eb964cbd4b170f1af6/0130709118v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/11/2c11353be10b8aff5cfc4c83246199e9/0130640586v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/30/eb/30eb9324ea3126096eb3a2ef820a8be5/0130704464v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/ec/adec05b770cd908c372d6641faf88fa1/0130765706v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ac/4d/ac4d77a2d88556f01607b93d63a25f3e/0130721386v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/bf/d3/bfd3a10ee878513bdf4c27db38128ed0/0130670809v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/81/b3/81b359118a0e0e395cdebbddcfa03243/0130668020v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/93/91/9391c9624ce4cfd414eaed171c3e50b8/0130668778v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/4b/52/4b528e4b495a537cda6df2ae3eee775e/0130637010v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/73/62/7362883dfa5efc0dcacb2e148a5dd7e0/0130738599v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/8f/52/8f52fcd16c1c96d52b39995b962f135e/0130846855v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8a/ba/8abadeb121d645fdb8fb5a68d6a4c9b8/0130541481v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/0d/ee0d01ec7c94a6030ea13872c3adf768/0130913216v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e1/04/e1043ed6ca566979642a98b7dbadf235/0130912330v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c4/43/c44345288e65c7a41cd5ce0da355ba1f/0130874335v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/00/24/0024808d38d25431ae2719d3f8252908/0130726727v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/21/1c/211c24358dafb0b5433509e917e532b3/0130567036v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/5c/1e/5c1e606e8d54467bc29043a16a344dd7/0130157161v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/63/e5/63e5f25ac31ef/logo.png)

:fill(fff,0)/p7i.vogel.de/companies/60/de/60ded37a20a00/logo-vertiv.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/68/2d/682dd583dcc4c/fsas-afc-horizontal-2-positive-rgb-nov24.png)

:quality(80)/images.vogel.de/vogelonline/bdb/1599800/1599872/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1599800/1599873/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1599800/1599874/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1599800/1599875/original.jpg)

:quality(80)/p7i.vogel.de/wcms/2a/4d/2a4dc3648b0a80ad69faed0697837351/0125749477v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/e8/e7e8b85b5b149134e659fe1e6f6a49c2/0125147881v2.jpeg)