Bestleistung bei KI-Benchmarks Nvidia liegt in der Machine-Learning -Performance sechsmal vorne

Die „MLPerf“ Benchmarks sind neu, sind im Bereich des Maschinellen Lernens und des Deep Learning angesiedelt und werden von Google, Intel, Baidu, Nvidia und Dutzenden weiteren IT-Anbietern unterstützt. Das Ziel dieser Benchmarks ist es, objektive und vergleichbare Leistungskennzahlen für eine Reihe von Workloads in diesem Umfeld zu bekommen: Visualisierung, Sprach- und Bilderkennung, personalisierte Empfehlungen beispielsweise. Nvidia hat sechs Benchmark-Tests gewonnen.

Anbieter zum Thema

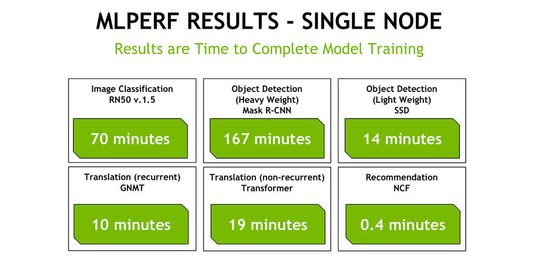

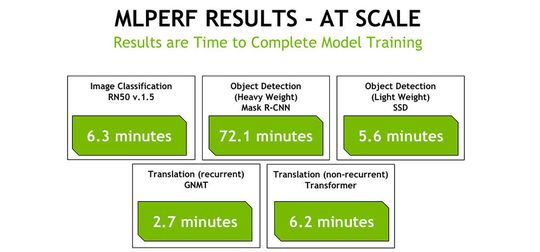

Die neuen Benchmarks decken decken neben einer Vielzahl von Workloads auch verschiedene Infrastrukturgrößen ab - von 16 GPUs auf einem Knoten bis hin zu bis zu 640 GPUs auf 80 Knoten. Die Kategorien, in denen Nvidia überzeugte, gehören Bildklassifizierung, Objektinstanzsegmentierung, Objekterkennung, Einmalübersetzung, Wiederholungsübersetzung und Empfehlungssysteme. Im Bereich „Verstärkungslernen“, der siebten Kategorie, hatte Nvidia keine Ergebnisse eingereicht.

Die Nvidia-Ingenieure schickten die DGX-Systeme des Herstellers ins Rennen, darunter erst kürzlich eingeführte System „DGX-2“, das weltweit leistungsstärkste KI-System mit 16 vollständig angeschlossenen „V100 Tensor Core“ GPUs.

Allerdings reiche es dafür nicht aus, großartige.Einzelkomponeneten einzusetzen, heißt es. Bei dem so genannten Accelerated Computing gehe es um mehr als nur um einen Beschleuniger, sondern um den gesamten Stack, so steht es auf dem Unternehmens-Blog. Der von Nvidia umfasst die „Nvidia Tensor Cores“, „NVLink“, „NVSwitch“, die DGX Systeme, „CUDA“, „cuDNNN“, „NCCL“, optimierte Deep Learning Framework Container und das Nvidia Software Development Kit.

Trotzdem ist die KI-Plattform des Herstellers nach eigenen Angaben auch die zugänglichste und erschwinglichste. Die Tensor Core GPUs sind in jeder Cloud und von jedem Computerhersteller und in jeder Region verfügbar.

Außerdem steht laut Hersteller die gleiche Leistung von Tensor Core Grafikprozessoren auch auf dem Desktop, zur Verfügung, wobei der leistungsstärkste Desktop-Grafikprozessor, „Nividia Titan RTX“, 2.500 Dollar kostet. Bei einer Abschreibung über drei Jahre ergibt sich daraus ein paar Cent pro Stunde.

Der Stack wird immer in der Nvidia GPU Cloud (NGC) Cloud Registry aktualisiert, so dass die rekordträchtige Plattform jetzt zur Verfügung steht. Zudem sind die Software-Innovationen und -Optimierungen kostenlos im den NGC Deep Learning Containern über die NGC-Container-Registry erhältlich.

Die Container enthalten den kompletten Software-Stack und die wichtigsten AI-Frameworks, die von Nvidia optimiert wurden. Das Release 18.11 der NGC Deep Learning Container enthält jetzt die Software, mit der die MLPerf-Ergebnisse erzielt wurden.

Nvidia ist das einzige Unternehmen, das sechs Benchmarks erreicht hat. Nach Interpretation des Unternehmens zeigt das die Vielseitigkeit der V100 Tensor Core GPUs. Der Test, in dem Nvidia besonders gut abschnitt, sind Übersetzungen natürlicher Sprache; das dafür notwendige neuronale Netzwerk war in nur 6,2 Minuten trainiert (mehr Infos dazu im Nvidia Developer News Center).

Artikelfiles und Artikellinks

(ID:45656073)

:quality(80)/p7i.vogel.de/wcms/23/a2/23a22ca2809e9d56ee77adc7ff357565/0131271145v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/db/65/db659edded4ec36a88aa5f13abf4bbf0/0131318711v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/53/61/536101b95adc3b78a7eba0f8de2db47c/0131269746v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/30/8b/308ba98f85f2a8da419e48fe6ea50f64/0131315309v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8b/b7/8bb7448dc0bdd1d46b2ee2f9c6848f9e/0131270790v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/af/21/af21f7761950c841306c223f77f91155/0131423495v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/64/6b/646b6d3886e625484482cb2ad1d2df30/0131318698v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/5c/1f/5c1fd669777e3f56dfd9fdd7d09995f7/0131301166v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/99/0d/990d30e453faf60aa83e0455d609ca55/0131297499v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/81/b3/81b359118a0e0e395cdebbddcfa03243/0130668020v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/94/179447f80cab81cfdbadd85c46cc9b72/0131191448v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/49/7a/497af014bb9c80eb964cbd4b170f1af6/0130709118v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/8a/ba/8abadeb121d645fdb8fb5a68d6a4c9b8/0130541481v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/04/f3/04f34ccd22d33a964e864e5ad0cc9678/0131308317v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b2/b5/b2b53d801176f1a4e6dbb7e80861d738/0131311098v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8b/64/8b64e9369f05a2b07bfa2c76e53819be/0131210510v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0c/ec/0cecbad201eb5d74f1ea8f9ec3a4f7a0/0128040845v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/ec/41ecbc8077275d54daf5895ae6f98b6c/0130998245v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/00/24/0024808d38d25431ae2719d3f8252908/0130726727v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/63/e5/63e5f25ac31ef/logo.png)

:fill(fff,0)/p7i.vogel.de/companies/60/de/60ded37a20a00/logo-vertiv.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/62/0b/620b6080ee47f/dtmlogo.png)

:quality(80)/p7i.vogel.de/wcms/2a/4d/2a4dc3648b0a80ad69faed0697837351/0125749477v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/30/cc/30cc5535e4f76dad6652b7fb41ad5d4f/0124883719v1.jpeg)