GPU-Beschleunigung im Massenmarkt Nvidia-GPUs im Mainstream-Server und High-Performance Workstations für Data Scientists

Nvidia will eine neue Klasse an Workstations einführen - die mit GPUs ausgestattet sind und für so genannte Data Scientists, Analysten und Ingenieure geeignet sind. Die Systeme bieten speziell für Datenanalysen, Maschinelles Lernen und Deep Learning extreme Rechenleistung sowie Werkzeuge, die erforderlich sind, um riesige Datenmengen vorzubereiten, zu verarbeiten und zu analysieren.

Anbieter zum Thema

Das Nvidia-Design soll in rechenintensiven Anwendungen in Bereichen wie Finanzen, Versicherungen, Einzelhandel und professionelle Dienstleistungen verwendet werden. Der GPU-Hersteller macht sich jedoch nicht allein auf den Weg. Das Unternehmen arbeitet mit OEMs und Systemherstellern zusammen, um die leistungsstarke neue Workstations bereitzustellen, darunter BlazingDB, Boxx, Charter Communications, Datalogue, Dell, Graphistry, H2O.ai, HP, Kinetica, Lenovo, MapR, MIT und Omnisci.

Die Nvidia-basierten Workstations basieren somit auf einer leistungsstarken Referenzarchitektur, die aus zwei High-End-Grafikprozessoren „Nvidia Quadro RTX“ und der Sammlung von Bibliotheken „Nividia CUDA-X AI“ besteht. Dazu kommt Spezialsoftware wie „Rapids“, „Tensorflow“, „Pytorch“ und „Caffe“.

Jensen Huang, Gründer und CEO von Nvidia, erläutert die Notwendigkeit einer solchen Workstation: „Data Science ist eines der am schnellsten wachsenden Gebiete der Informatik und betrifft jede Branche. So sind die Unternehmen bestrebt, den Wert ihrer Geschäftsdaten durch maschinelles Lernen zu erschließen und sie stellen deshalb Data Scientists in einer beispiellosen Rate ein.“ Diese benötigten leistungsstarke Workstations.

Die beschleunigte Workstation

„Mit unseren Partnern stellen wir Nvidia-basierte Data-Science-Workstations vor, ertüchtigt durch unsere neuen Turing Tensor Core GPUs und CUDA-X AI-Beschleunigungsbibliotheken. Sie ermöglichen es Datenwissenschaftlern, prädiktive Modelle zu entwickeln, die ihr Geschäft revolutionieren können“, so Huang.

Zu den Vorteilen, die die Nvidia-Workstations mitbringen, zählt der Hersteller:

- Duale Quadro RTX-Grafikprozessoren - Basierend auf der jüngsten Nvidia Turing GPU-Architektur und für den Einsatz in Unternehmen konzipiert, liefern die dualen Quadro RTX 8000 und 6000 GPUs bis zu 260 Teraflops Rechenleistung und 96 Gigabyte Speicherplatz unter Verwendung der „Nvidia NVLink“-Verbindungstechnologie. Damit sollen die Workstations genügend Kapazität und Bandbreite bieten, um die größten Datensätze und rechenintensiven Workloads zu verarbeiten, sowie die Grafikleistung, die für die 3D-Visualisierungen von massigen Datensätzen, einschließlich Virtual Reality (VR), benötigt werden.

- Data Science Software-Stack, basierend auf dem Linux-Betriebssystem und Docker-Containern:

- Nvidia CUDA-X AI ist eine Sammlung von GPU-Bibliotheken zur Beschleunigung von Deep Learning, Machine Learning und Datenanalyse (siehe auch: Kasten). CUDA-X AI enthält cuDNNN zur Beschleunigung von Deep-Learning-Primitiven, cuML zur Beschleunigung von maschinellen Lernalgorithmen, TensorRT zur Optimierung von trainierten Modellen für Inferenz und über 15 weitere Bibliotheken. Zusammen arbeiten sie mit Nvidia Tensor Core GPUs zusammen, um die End-to-End-Workflows für die Entwicklung und Bereitstellung von KI-basierten Anwendungen zu beschleunigen. CUDA-X AI kann in Deep Learning Frameworks wie Tensorflow, Pytorch und MXNet sowie in Cloud-Plattformen wie AWS, „Microsoft Azure“ und „Google Cloud“ integriert werden.

- Nvidia Rapids bietet eine Reihe von GPU-beschleunigten Bibliotheksanalysen für die Datenaufbereitung, für traditionelles Maschinelles Lernen und für Grafikanalysen.

- Eine Anaconda Distribution der Anaconda, Inc. – Sie bietet als Nvidia Anaconda Distribution, eine innovative Möglichkeit Python/R, Data Science, KI und Machine Learning zu nutzen.

- Enterprise ready - Getestet und optimiert in Zusammenarbeit mit Workstation-Herstellern, um den Anforderungen unternehmenskritischer Implementierungen gerecht zu werden.

- Optionaler Software-Support - Bietet Sicherheit durch von Nvidia entwickelte Software und Container, einschließlich Deep Learning und Machine Learning Frameworks.

Mike Koelemay ist leitender Data Scientist bei Lockheed Martin Rotary & Mission Systems. Er zeigt sich angetan von den Workstations: „Die Nvidia-basierte Data-Science-Workstation ermöglicht es uns, End-to-End-Datenverarbeitungs-Pipelines mit großen Datensätzen schneller denn je zu betreiben.“ Insbesondere die Nutzung von Rapids und die Verlagerung von Workloads auf die GPUs reduziere die Entwicklungszeit von Modellen.

Die Nvidia-basierten Workstations sind ab sofort bei globalen Anbietern wie Dell, HP und Lenovo sowie regionalen Systemherstellern erhältlich, darunter AMAX, APY, Azken Muga, Boxx, CADNetwork, Carri, Colfax, Delta, Exxact, Microway, Scan, Sysgen und Thinkmate.

Nidia-GPUs im Mainstream-Server

GPUs, die in Servern rechnen, ist dagegen fast schon normal. Doch „ganz gewöhnliche Enterprise-Server? Nvidia gab gestern auf seiner Hausmesse „GTC“ bekannt, dass Mainstream-Server, die für den Betrieb der „Nvidia Data Science Acceleration“ Software optimiert sind, ab sofort von sieben der weltweit größten Systemhersteller erhältlich sind: Cisco, Dell EMC, Fujitsu, Hewlett Packard Enterprise (HPE), Inspur, Lenovo und Sugon:

- Cisco UCS C240 M5

- Dell EMC Poweredge R740/R740xd

- Fujitsu Primergy RX2540 M5

- HPE Proliant DL380 Gen10

- Inspur NF5280M5

- Lenovo Thinksystem SR670

- Sugon W760-G30

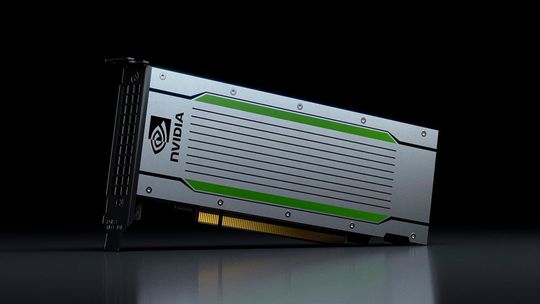

Sie bieten nun Server mit „Nvidia T4“-Grafikprozessoren an, die für den Betrieb von CUDA-X AI Accelerated Data Analytics, Machine Learning und Deep Learning konzipiert sind. Mit einer Leistungsaufnahme von nur 70 Watt und der Integration in bestehende Rechenzentrumsinfrastrukturen kann die GPU T4 sowohl KI-Training und -Inferenz, maschinelles Lernen, Datenanalyse und virtuelle Desktops beschleunigen.

Ian Buck, Vice President und General Manager of Accelerated Computing bei Nvidia sagt: „Die schnelle Einführung von T4 auf den weltweit beliebtesten Business-Servern signalisiert den Beginn einer neuen modernen Ära im Enterprise Computing.“ So profitierten mit T4 Anwender unter anderem von bis zu 33 Prozent mehr VDI-Leistung als mit nur CPU und Grid vPC.

So sagt Susan Nash, Senior Vice President of Strategic Corporate Alliances bei VMware: „Nvidia und VMware arbeiten seit langem zusammen, um Unternehmen zu befähigen, ihre Rechenzentrumsressourcen zu maximieren. Diese sind bestrebt, sowohl die VDI- als auch die Arbeitsbelastung im Machine und Deep Learning zu beschleunigen und gleichzeitig ihren Return on Investment zu maximieren. Die Nvidia T4-basierten Server bieten eine Lösung für diese Unternehmen, verbunden mit mehr Flexibilität, besserer Auslastung und Schutz ihrer VMware-Infrastrukturinvestitionen.“

Die von Cisco, Dell EMC, Fujitsu, HPE, Inspur, Lenovo und Sugon angekündigten Systeme sind „Nvidia NGC-Ready“ validiert. Das im November gestartete Programm bietet eine Reihe ausgewählter Systeme, die auf Nvidia-Grafikprozessoren mit Tensor Cores basieren und für eine Vielzahl von KI-Workloads ideal sind. Die im Rahmen des NGC-Ready-Validierungsprozesses getestete Software ist bei Nvidia NGC erhältlich, einem umfassenden Repository von GPU-beschleunigter Software, vorgeschulten AI-Modellen, Modelltrainings für Datenanalysen, Maschinelles Lernen, Deep Learning und High Performance Computing. Darüber hinaus haben mehrere andere Partner den Validierungsprozess für ihre T4-Server gestartet.

Nvidia-Support ist über die Partner verfügbar, die NGC-Ready-Systeme verkaufen:

- Für Cisco gilt das bereits für eine „Nvidia V100“-System: Cisco UCS C480 ML

- HPE wird den Service für den HPE Proliant DL380 Gen10 Server als validierten NGC-Ready T4 Server im Juni anbieten.

(ID:45810655)

:quality(80)/p7i.vogel.de/wcms/cb/71/cb71e590a7dc308eaba6d56d64b7eb88/0131454836v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/92/69/926957985fcebbb3e065a2faf9c652ea/0131454826v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/23/a2/23a22ca2809e9d56ee77adc7ff357565/0131271145v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/db/65/db659edded4ec36a88aa5f13abf4bbf0/0131318711v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/38/be/38be533948e665f81f8dd40af236f0e7/0131491752v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/b8/36b8ba441409b46b71455151dfc60538/0131002266v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/09/03/09035e7bbac6cadc0b1f21818144194f/0131423113v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e0/98/e09817246d3203a4b491b223997c76dd/0131317840v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a1/dd/a1ddf02ccf707e1002dc9f0b0c41f6cf/0131298906v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/af/21/af21f7761950c841306c223f77f91155/0131423495v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/64/6b/646b6d3886e625484482cb2ad1d2df30/0131318698v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/81/b3/81b359118a0e0e395cdebbddcfa03243/0130668020v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/94/179447f80cab81cfdbadd85c46cc9b72/0131191448v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c6/2b/c62b87f2a390d03996b4db6e3c51b1ee/0131312711v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/49/7a/497af014bb9c80eb964cbd4b170f1af6/0130709118v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/e9/1f/e91fc245c584b6ed72107ab6433bbf9a/0131310055v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/95/6e9529f775612253d132e9002edc3c6f/0131312462v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/04/f3/04f34ccd22d33a964e864e5ad0cc9678/0131308317v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b2/b5/b2b53d801176f1a4e6dbb7e80861d738/0131311098v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/ec/41ecbc8077275d54daf5895ae6f98b6c/0130998245v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/60/de/60ded37a20a00/logo-vertiv.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/66/c3/66c33d1f71ef2/daxten-logo-600-x-600.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/68/2d/682dd583dcc4c/fsas-afc-horizontal-2-positive-rgb-nov24.png)

:quality(80)/p7i.vogel.de/wcms/21/b6/21b692c1d94490b1718c9e14d0592e4d/0125828876v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f5/49/f5498274c07b00bcdc104630b6df47de/0130252727v1.jpeg)