Das ereignisgetriebene Datacenter Was sind Microservices?

Microservices verändern die Art und Weise, wie Unternehmen ihre IT in Betrieb setzen: Das ereignisgetriebene (event-driven) Rechenzentrum nimmt Gestalt an.

Anbieter zum Thema

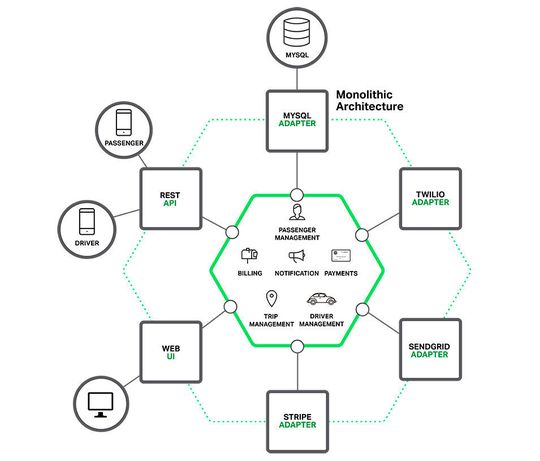

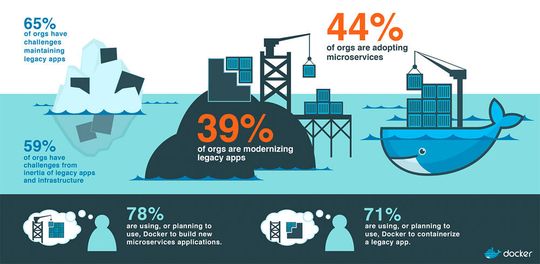

Die Kernidee von Microservices besteht darin, schwer zu wartende, monolithische Anwendungen in leichtgewichtige, skalierbare und fehlertolerante Service-Einheiten aufzubrechen. Microservices haben DevOps (und DevSecOps) zum Erfolg verholfen und eine groß angelegte Containerisierung des Datacenter ausgelöst.

Container erlauben es, die einzelnen Microservices-Komponenten voneinander zu isolieren, zwischen verschiedenen Infrastrukturtypen hin und her zu portieren und in exakt vorhersehbarer Qualität bereitzustellen. Mit dem großflächigen Einzug von Containern in das Datacenter finden Microservices immer mehr Anwendung.

Containerisierte Microservices bieten Datacenter drei wichtige Vorteile im Hinblick auf die Kapazitätsplanung:

- eine weitaus höhere Nutzungsdichte gegenüber monolithischen Anwendungen in VMs und ein niedrigerer Ressourcenverbrauch,

- freie Portabilität auch über verschiedene Infrastrukturtypen hinweg,

- bedarfsgerechte Skalierbarkeit und die damit verbundene höhere Agilität des Rechenzentrums.

Von Microservices zum ereignisgetriebenen Datacenter

Trotz all ihrer Vorteile bringen Microservice-Architekturen eine ganze Menge eigener Herausforderungen mit sich. Spätestens wenn es darum geht, die Abwicklung von Transaktionen in verteilten Anwendungen auf der Basis von Microservices zu implementieren, greifen bisherige Ansätze einfach zu kurz.

RESTful-APIs sind einfach nicht dafür geeignet, robuste, fehlertolerante und elastisch skalierbare Microservices zu implementieren. Aspekte eines Deployments wie die Diensterkennung und die Lastverteilung zustandsloser Komponenten, die mit REST-Aufrufen einhergehen, bieten sich hierzu einfach nicht an.

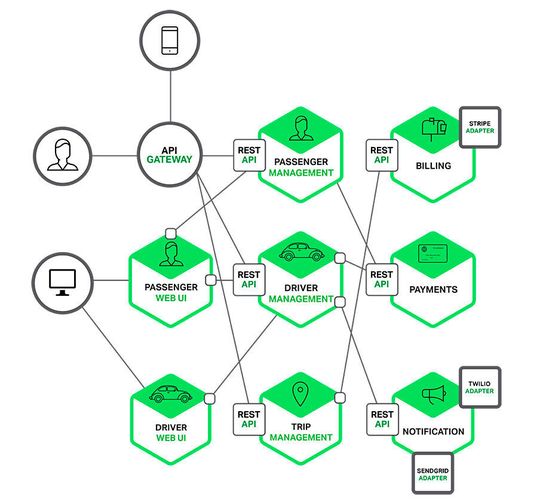

Die abgegrenzten Service-Einheiten in einer Microservices-Architektur (MSA) müssen miteinander effizient kommunizieren können. Dabei soll die Agilität und Elastizität der Anwendung gewahrt bleiben. Die Antwort auf diese Herausforderungen bietet eine Ereignisverarbeitung durch Messaging-Dienste.

Service-Einheiten und Messaging-Dienste

Messaging-Dienste entkoppeln die einzelnen Microservices einer MSA voneinander: Nachrichten wandern stets durch eine Vermittlungsstelle, zum Beispiel eine so genannte Warteschlange oder einen Broker, und zwar asynchron - an einen oder mehrere Empfänger. Die MSA gewinnt dadurch an Widerstandsfähigkeit und Elastizität.

Der Ausfall eines der Microservices führt nicht mehr zum Ausfall der gesamten Anwendung. Die Notwendigkeit der Verfügbarkeit von Diensterkennung (service discovery) entfällt. Die resultierende Softwarelösung arbeitet ereignisgetrieben, autonom und weist eine hohe Anpassungsfähigkeit auf.

Microservices auf der Basis von Messaging-Diensten läuten das Aufkommen ereignisgetriebener IT ein. Für Rechenzentren entstehen hierbei neue Anreize, geeignete Lösungen für die Orchestrierung zu finden, um die Bereitstellung eines geeigneten Infrastrukturunterbaus für elastische Microservices zu gewährleisten.

Virtualisierung, Container und Microservices

Eine private Cloud für hybride Deployments, wie es etwa Mesosphere mit „DC/OS“ vorgemacht hat (siehe dazu: Konventionelle Server-Betriebssysteme versagen, Zeit wird's: Die neuen Betriebssysteme für Rechenzentren), bietet sich hierbei geradezu an. Es mag zwar möglich sein, containerisierte Microservices nach dem reinen Virtualisierungsparadigma aufzusetzen, doch ist dies nicht unbedingt sinnvoll. Der reine Virtualisierungs-Ansatz wird den aktuellen Anforderungen an die Agilität der Enterprise-IT einfach kaum noch gerecht.

:quality(80)/images.vogel.de/vogelonline/bdb/969600/969673/original.jpg)

Mesosphere hat das Datacenter-Betriebssystem

Virtualisierung war gestern. DCOS taugt besser.

Der Cloud-Ansatz verspricht dagegen nicht nur eine höhere Flexibilität dank der elastischen Skalierbarkeit von Microservices-Architekturen, sondern auch eine bessere Ressourcenauslastung und dadurch wiederum niedrigere Betriebskosten.

Stark vernetzt: Änderungen der Datacenter-Architektur

Die Notwendigkeit, ereignisgetriebene, agile Anwendungen bereitzustellen, erzwingt im Datencenter ein umfassendes Umdenken: weg von dem Virtualisierungs-Paradigma hin zur privaten Cloud. Doch wo es Licht gibt, gibt es auch Schatten: Microservices stellen neue Anforderungen an die Infrastruktur eines Datencenters und möchten bei neuen Investitionen vorausschauend berücksichtigt werden.

Ereignisgetriebene IT stellt hohe Ansprüche an die Netzwerkkapazitäten sowohl innerhalb als auch außerhalb des Datencenters. DCI (Datacenter Interconnect) ist für die standortübergreifende Verzahnung von Microservices-Anwendungen unverzichtbar.

In einer repräsentativen Umfrage unter den Praktikern der Datencenter-Branche des vielfach preisgekrönten Cloud- und Virtualisierungsspezialisten Turbonomic von 2015 nannte nahezu jeder zweite Administrator von Microservices-Architekturen (41 Prozent) die Latenz des Speichers als die größte Herausforderung. Weitere 7,69 Prozent beschwerten sich über die Ost-West-Netzwerk-Latenz und 17,95 Prozent beklagten lahmen Anwendungscode. (Die Mehrheit der betreffenden Microservices liefe allerdings noch in VMs.)

Ereignisgetriebene Orchestrierung von Microservices

Mit der Umstellung auf Container und Messaging wird ein System von agilen Microservices geschaffen, welches es auch geschickt zu organisieren gilt. Hier kommen spezialisierte Orchestrierungsanwendungen zum Zuge. Sie entscheiden unter anderem anhand der aktuellen und geplanten Auslastung und des Performance-Profils der Hardware (CPU, Speicher, Datendurchsatz und mehr), auf welchem Server ein Job laufen soll.

Scheduling- und Orchestrierungssoftware fördert eine bessere Hardware-Auslastung und trägt damit zu einem niedrigeren Stromverbrauch bei. Die einzelnen Microservices lassen sich so arrangieren, dass nicht benötigte Ressourcen konsolidiert und frei gewordene Server heruntergefahren werden.

Zu den führenden Frameworks für die Konfigurationsverwaltung und Orchestrierung von Microservices zählen die so genannte Spring Cloud (oft in Kombination mit „Netflix OSS“) und „Google Kubernetes“. Die beiden Lösungen sind sehr unterschiedlich und versuchen zudem, zwei unterschiedliche Probleme zu lösen.

Spring Cloud, Kubernets und Netflix OSS

Eine skalierbare und widerstandsfähige Microservices-Architektur muss sich selbst zentral koordinieren und in der Lage sein, Hunderte oder Tausende von Diensten zu handhaben. Der Aufbau einer solchen MSA bedarf außerdem passender Werkzeuge, welche über umfangreiche Build- und Ablaufumgebungen verfügen müssen.

Mittels der Spring Cloud lassen sich sowohl funktionelle Dienste, wie Web-Statistikdienste, Account- und Benachrichtigungsdienste und zudem auch unterstützende Infrastrukturdienste (etwa: Log-Analyse, Server-Konfiguration, Dienste-Enddeckung und Authentifizierungsdienste) umsetzen.

Die Spring Cloud verfügt über eine umfangreiche Sammlung von integrierten Java-Bibliotheken, um die relevanten Laufzeitaspekte adressieren zu können. Spring-Cloud-basierte Microservices nutzen Java-Bibliotheken und Runtime-Agenten, um Dienste auf der Client-Seite zu entdecken, Load Balancing zu gewährleisten, Konfigurationen zu aktualisieren und Metriken zu erfassen. Auch Muster, zum Beispiel geclusterte Singleton-Dienste und Batch-Jobs ,werden in der JVM (Java Virtual Machine) verwaltet.

Kubernetes, welches Google einst als einen „Borg“-Nachfolger ins Leben rief, ist hier völlig anders. Die früher bei Google übliche Fokussierung auf Java (und C/C++) gibt es hier nicht mehr. Kubernetes ist als ein mehrsprachiges Mikroservices-Framework ausgelegt, das zwar auch Java unterstützt, aber eben auch viele andere Sprachen, darunter C/C++, Python und vor allem Go/golang.

Harte Schule für Uber

Doch Orchestrierung ist keinesfalls ein Allheilmittel. Diese Lektion musste unter anderem der Fahrdienst und aspirierender Taxi-Ersatz Uber auf die harte Tour lernen. Uber hatte seine Plattform auf der Basis von rund 1.300 Microservices aufgezogen. Bald nach der erstmaligen Bereitstellung war das Chaos nicht mehr in den Griff zu bekommen.

Die Orchestrierungssoftware „Puppet“ propagierte jegliche Konfigurationsfehler und Software-Bugs - auch das Zweit-Rechenzentrum ließ sich nicht in den Griff bekommen. Das Team hatte den Durchblick verloren.

Systemausfälle waren bei Uber an der Tagesordnung. Die Uber-Ingenieure haben erst nach und nach Prozesse entwickelt, um die größten Pannen weitgehend auszuschließen. Um den vielen Problemen ihrer MSA auf die Spur zu kommen, haben sie spezielle Tools entwickelt, unter anderem „Hailstorm“ und „uDestroy“.

Das CI/CD-Paradigma (Continuous Integration und Continuous Delivery) wurde auch noch um eine dritte Komponente ergänzt: kontinuierliches Dazulernen, sowohl durch Menschen wie auch - ereignisgetrieben - durch die Microservices selbst. Den nächsten logischen Schritt stellt die automatische Bereitstellung aufeinander abgestimmter Scheduling- und Orchestrierungsdienste dar.

Viele Unternehmen müssen aber noch ein weiteres Problem meistern, nämlich ihre containerisierten Microservices an zustandsbehaftete, konventionelle Anwendungen, beispielsweise relationale Datenbanken und Big Data-Workloads, mehr oder weniger nahtlos anbinden. Für Datencenter eröffnet sich dabei die Möglichkeit oder gar die Notwendigkeit, die Nutzung ihrer Infrastruktur zu vereinfachen. Server-lose Deployments mit Lambda-Ausdrücken versprechen, die administrative Last für die Benutzer - in diesem Fall Software-Ingenieure - zu senken.

Maschinelles Lernen für ein verstärkt autonomes Rechenzentrum

Die Popularität von Microservices und die Containerisierung des Datencenters sind eine Antwort auf die wachsenden Anforderungen an eine höhere Agilität von Unternehmen und deren IT. Mit dem ereignisgetriebenen Ansatz werden Datencenter nicht nur agiler, sondern auch autonomer und erstmals... lernfähig.

Was vielleicht etwas utopisch klingt, ist eigentlich schon gelebte Realität wie beispielsweise im Falle von „Deep Mind AI“, eines neuronalen Netzwerks zur Stromverbrauchoptimierung von Googles Datencentern (siehe dazu: KI und Big Data modellieren Datacenter für mehr Effizienz). Menschliche Eingriffe bei der Bereitstellung und Skalierung von Microservices-Anwendungen sollen künftig gegen Null gehen.

Fazit: Die breite Einführung von Microservices mit Messaging-Systemen ruft das ereignisgetriebene - also verstärkt autonome - Datacenter auf den Plan.

*Das Autorenduo

Filipe Pereira Martins und Anna Kobylinska arbeiten bei der McKinley Denali Inc. (USA).

(ID:44459519)

:quality(80)/p7i.vogel.de/wcms/a0/74/a074b1b682c5af4985ac6db2f521efcd/0131131347v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a5/db/a5db7775305378d9d405e13e60f5e2f8/0130996707v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/59/c1/59c1cf46aaae9b03d58eb5d1711fbef3/0131024819v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/33/de/33de1ab85f5087fdb0ec4413d51d2dcd/0130981881v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2a/c3/2ac3b65699dffc6bc3d44838b4a27223/0131131326v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/89/97/899791db276100161ea76f79dd649245/0131131469v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/03/53/03531922dce111ec6fa5b65684d9ea1c/0131055174v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/fd/a1/fda14c3b1c1b26538a1d36ea06c717e9/0130669567v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/30/eb/30eb9324ea3126096eb3a2ef820a8be5/0130704464v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ac/4d/ac4d77a2d88556f01607b93d63a25f3e/0130721386v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/81/b3/81b359118a0e0e395cdebbddcfa03243/0130668020v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/94/179447f80cab81cfdbadd85c46cc9b72/0131191448v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/ec/41ecbc8077275d54daf5895ae6f98b6c/0130998245v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/49/7a/497af014bb9c80eb964cbd4b170f1af6/0130709118v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/8a/ba/8abadeb121d645fdb8fb5a68d6a4c9b8/0130541481v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/ec/f1ec747ce9d298900249b7e29b123739/0131038591v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/35/ee/35ee684ecf7d82adb1b5360b04801c8d/0131008543v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d8/da/d8da211182a622032f94c6df22a902d0/0131020342v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2d/9b/2d9bcbf76df4db8486e544d0a3b3e3e2/0130992530v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/00/24/0024808d38d25431ae2719d3f8252908/0130726727v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/21/1c/211c24358dafb0b5433509e917e532b3/0130567036v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/60/2a/602a8645d40e9/200226---derz-logo.jpg)

:fill(fff,0)/p7i.vogel.de/companies/65/6d/656def888f484/02-01-eps-logo-4c-rzi.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/69/7a/697a2cbe326a2/penta-infra-logo-fc.png)

:quality(80)/p7i.vogel.de/wcms/75/ad/75ad48f0e5a509b3b4a999de6e44c6b0/0126135181v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b6/45/b645bfbfcbe3ddbfadcc392a33819ede/0124744502v2.jpeg)