Aus Cobol und PL1 sollen Microservices werden Future IT Transformation bietet T-Systems nun auch für Großrechnerdaten und -programme an

Auf der hauseigenen Veranstaltung „Accelerate Digital Now“ in der vergangenen Woche hat T-Systems erstmalig den „FITT“ vorgestellt. Das Kürzel steht für „Future IT Transformation“ und bietet eine Suite an Services, mit denen sich Legacy-Systeme in Richtung Cloud-nativ modernisieren und damit flexibilisieren lassen. Eingeschlossen sind selbst Mainframe-Daten und -Programme.

Anbieter zum Thema

Nicht jedes Legacy-Programm ist monolitisch und starr und nicht alle unflexiblen Applikationen und ihre Umgebungen laufen auf einem IBM-Großrechner. Doch oft sei im Mainframe-Umfeld die „technische Schuld“ unverhältnismäßig groß, erläutert Gundula Folkerts, Co-Founder des „zFuture-Mainframe“-Innovationsprogramms.

Denn viele Entscheider in den Großrechner-nutzenden Unternehmen hätten die Modernisierung über einen langen Zeitraum schleifen lassen. Typischer Denkfehler: Sie sind davon ausgegangen, dass die Plattform längst ausgemustert sei.

Tatsächlich aber leben die Anwendungen und die dazugehörigen Datenstrukturen noch. Auch der Grund dafür ist typisch: Es handelt sich zumeist um Kernapplikationen eines Unternehmens und damit um Jahrzehnte gewachsenes Know-how, das letztlich die entscheidenden Unterschiede zum Geschäft der Wettbewerber ausmacht. Und weil das so ist, sind die Anwendungen mit zahlreichen anderen verbunden; „200 Schnittstellen eines Programms kommen vor“, so Folkerts.

Die zentralen Daten

Noch komplizierter sind die Datengeflechte, die sich etwa in der hierarchischen Datenbank „IMS“ oder in der relationalen Datenbank DB2 sehr eng an Mainframe-Infrastruktur anschmiegen – zumindest entspricht das den Aussagen von Beratern, die sich auf Veranstaltungen tummeln, auf denen LzLabs für eine Ablösung der Plattform durch den „Software Defined Mainframe“ (SDM) wirbt. LzLabs und T-Systems sind im vergangenen Jahr eine Kooperation eingegangen. Doch auch Folkerts bestätigt diesen Umstand.

:quality(80)/images.vogel.de/vogelonline/bdb/1714300/1714301/original.jpg)

Teaming-Agreement vereinbart

LzLabs und T-Systems starten Kooperation

:quality(80)/images.vogel.de/vogelonline/bdb/1680700/1680708/original.jpg)

Software Defined trifft auf große Hardware - LzLabs auf IBM

Wie modernisiert man Mainframe-Applikationen?

Das aber macht Migrationen nicht nur aufwändig und teuer, sondern auch sehr risikobehaftet. Diese Unantastbarkeit aber verlängert wiederum das Leben der Großrechner-Infrastrukturen.

Sie und andere beteuern jedoch, eine Mainframe-Umgebung ist nicht per se verkrustet, auch IBM tue einiges dafür, dass die Systeme offen sein können, für moderne Tool-Chains, für hybride Cloud-Modelle, für DevOps, für die Abwehr von Gefahren aus dem Cyberspace …. nur können geschrumpfte Mainframe-Teams mit den Entwicklungen rund um Container, Kubernetes, Open Source, Microservices inkrementelles Testen und den andauernden Strom von Funktionsänderungen in kürzesten Update-Zyklen nicht mithalten.

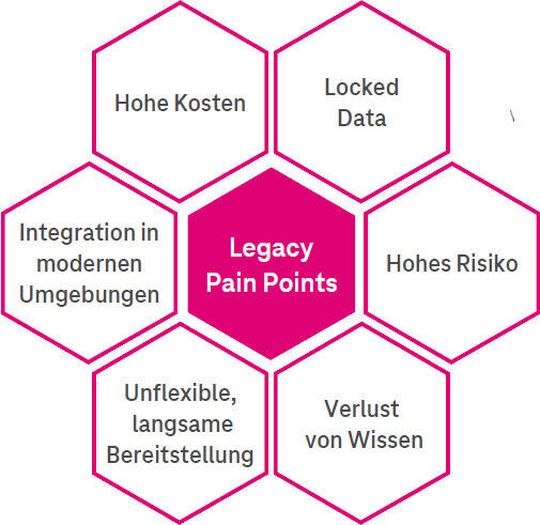

Der Dornröschenschlaf hat mancherorts einfach zu lange gedauert. Die Folge:

- Locked- in Data: kritische Daten sind in Altsystemen gefangen?

- End of Lifecycle: Kritische Systeme haben das Ende ihres Lebenszyklus erreicht und Legacy-Spezialisten verlassen das Unternehmen

- Technology-Gap: Technologien wie KI sind zwar prinzipiell nutz- und anschließbar, aber die Bereitstellung dauert zu lange: Anschluss verpasst. Administratoren von Legacy-IT berichten häufig darüber, dass sie „ Stunden über Stunden “ für die Implementierung benötigen, bevor sich ein System (oder ein Upgrade) überhaupt nutzen lässt“.

Kein Wunder also, dass nach Evaluierungen des Analystenhauses Vanson Bourne 89 Prozent der Unternehmen zwar ihre Legacy IT pflegen, anstatt sie zu ersetzen. Über ein Drittel von ihnen würde sich lieber auf die digitale Transformation als auf die Wartung ihrer Altsysteme konzentrieren.

Ich wünsche mir neues Werkzeug

Doch auch den Wunsch nach Werkzeugen, die up to date sind, die sich off und on premises nutzen lassen, die Microservices, Multicloud und Legacy beherrschen, „kann ich verstehen“, sagt Folkerts. Denn zurzeit gingen die Preise für die proprietären Tools in einem „beträchtlichem Maße“ nach oben.

Zugleich aber bedeute die Nutzung moderner Werkzeuge einen fast kulturellen Umbruch. Die DevOps-Teams lösten ihre Probleme über ihre Communities: Es gebe ja fast kein Problem mehr, dass sich nicht in Google finden lasse, beziehungsweise Menschen, die sich damit befassten, so Folkerts. Da haben klassische Mainframer einen ganz anderen Hintergrund.

Andreas Greis, Leiter Digital Solutions bei T-Systems, fasst die Situation wie folgt zusammen: „Großrechner und Cobol wurden vor über 60 Jahren entwickelt, aber auch vermeintlich neuere Systeme aus dem Jahr 2000 sind nicht mehr zukunftsfähig.“

Monolitische Anwendungen und verknotete Datenströme aufzuweichen oder gar abzulösen dauert – lange. Zudem ist das Risiko nicht zu unterschätzen. Immerhin haben nach Angaben des IEEE seit 2010 Unternehmen und die Öffentliche Hand weltweit 720 Milliarden Dollar für den fehlgeschlagenen Austausch ihrer Legacy-IT ausgegeben.

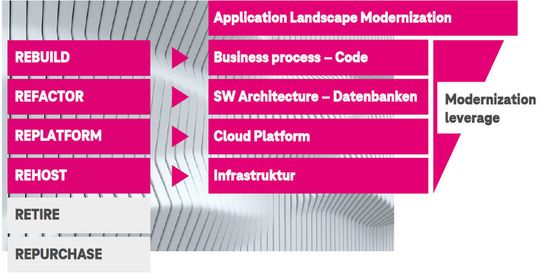

Von einem Big Bang rät Folkerts ohnehin ab. Das T-Systems-Angebot vermeidet einen solchen, sieht stattdessen eine schrittweise Transformation vor, aber mit Quick Wins. So besteht FITT aus sechs Modulen, mit denen etwa unflexible Cobol-Programme geschmeidig werden, Informationen aus alten Datenbanken gerettet und Bestandssysteme in die Cloud gebracht werden sollen.

„zWebConnector“ ermöglicht es, Daten aus Großrechnern plattformübergreifend mit anderer Infrastruktur im Unternehmen zu teilen.

- Damit können andere Systeme aus dem Unternehmen auf geschäftskritische Daten zugreifen und sie nutzen.

- Mainframe-Technologien lassen sich mit modernen Systemen verbinden.

- Die Datenübertragung wird sicher und effektiv.

„zFCI“ könne den Mainframe so flexibel werden lassen wie eine Cloud. Hier werden Cloud-Management-Funktionen und Mainframe-Containerisierung verbunden. Das bedeutet nach T-Systems-Angaben:

- eine hochgradig standardisierte Container Umgebung,

- ein Schnelles Ramp-up der kompletten Umgebung und dass

- DevOps and Microservices genutzt werden können.

„zFuture Rehosting“ erlaubt Applikationen vom Großrechner in eine Cloud-Umgebung zu migrieren – auch direkt in eine Public Cloud. Der Service dient

- der Migration von teurer und ineffizient genutzter Mainframe-Last in die Cloud,

- reibungslosen und erfolgreichen Implementierungsprozessen,

- als Fundament für nachhaltige Transformationspfade auf Applikationsebene

„Data Excavator“ ist das Angebot, veraltete Data Warehouses in Data Lakes zu überführen. Das bedeutet nach T-Systems-Angaben:

- geringer Aufwand für die Vorbereitung,

- Transparenz des Migrationsprozesses,

- vollständige Dokumentation zur Unterstützung der Migration und

- einen hohen Grad an Automation und Standardisierung.

„Monolith 2 Microservices“ ist dafür gedacht, starre Java-Programme in viele Microservices aufzuteilen. Das macht das Programmpaket damit insgesamt flexibler. Dazu gehört:

- eine Priorisierung der fachlichen Domänen im Monolithen,

- eine Tool-basierte Analyse und das Design der Microservice-Architektur mit „vFunction“ und

- das Produktivsetzen der Microservices ohne Codeanpassungen mit dem „Lambda Agent“.

„zFuture Mainframe App Modernization“ hilft dabei Cobol- und PL1-Programme in Cloud-fähige Microservices zu zerlegen. Der Service umfasst:

- ein Tool-basiertes Mapping von technischen und fachlichen Strukturen mit „Explain“,

- das Refactoring oder eine Codetransformation von Cobol und/oder PL1 nach Java auf Linux sowie

- eine schrittweise Modernisierung mit API-Layer.

Diese Module sind voneinander unabhängig und bauen nicht zwangsweise aufeinander auf. So wollten viele Kunden den Mainframe als Hardwareplattform behalten. Allerdings, betont Fachfrau Folkerts, sei der Nutzen bei Anwendung aller Komponenten am größten. Das Vorgehen wäre wie folgt:

Über ein „Application Landscape Assessment“ wird in einem ersten Schritt die Strategie für die Transformation ermittelt – sei es Cloud first oder die Modernisierung auf bestehender Infrastruktur. Die Tools Data Excavator und zWebConnector helfen bei der Datenintegration . Mit zFCI und zFuture Rehosting gelangt die jeweilige Mainframe Applikationen auf eine neue Plattform. Es ist aber auch möglich, die gesamte Architektur mit Microservices abzubilden, die individuell einsetzbar ist – „minimal invasiv“, wie es bei T-Systems heißt.

Vermieden werden nach Anbieterangaben einzelne, risikoreiche Deployments, endlose Zeitpläne für Updates und Changes. Greis sagt: „Kunden brauchen heute IT-Landschaften, die ihr Geschäft flexibler, schneller und effizienter machen. Deshalb haben wir einige unserer Standardlösungen zu FITT zusammengefasst. Damit modernisieren wir Plattformen, Datenbanken und Programme – in kleinen Schritten oder in großen, ganz wie es für die Situation passt.“

(ID:47143356)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b7/51/b7517d2828afce2eed6c60c8f4b15e08/0131193094v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a0/74/a074b1b682c5af4985ac6db2f521efcd/0131131347v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a5/db/a5db7775305378d9d405e13e60f5e2f8/0130996707v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8b/b7/8bb7448dc0bdd1d46b2ee2f9c6848f9e/0131270790v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/00/cc/00cc9d1cff0f4760579380bfccfd6a55/0131241587v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ef/d6/efd67bbf37bf217b7fb376c5b6cea3f2/0131214575v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/05/6e0551963ade522e815e481b0866df59/0131270766v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/fc/91/fc91634cab380f053be693356d88ab11/0131193486v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/89/97/899791db276100161ea76f79dd649245/0131131469v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/81/b3/81b359118a0e0e395cdebbddcfa03243/0130668020v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/94/179447f80cab81cfdbadd85c46cc9b72/0131191448v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/49/7a/497af014bb9c80eb964cbd4b170f1af6/0130709118v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/8a/ba/8abadeb121d645fdb8fb5a68d6a4c9b8/0130541481v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/8b/64/8b64e9369f05a2b07bfa2c76e53819be/0131210510v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0c/ec/0cecbad201eb5d74f1ea8f9ec3a4f7a0/0128040845v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/1f/8e1f9fa0a40402c37826489eb3bff4a6/0131226935v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/04/58/0458d319fcf6c748ac43aef05ffee535/0131244622v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/ec/41ecbc8077275d54daf5895ae6f98b6c/0130998245v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/00/24/0024808d38d25431ae2719d3f8252908/0130726727v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/64/e4/64e4be0db6ddc/rittal-4c-w.png)

:fill(fff,0)/p7i.vogel.de/companies/6a/03/6a032acb3d1c7/kentix-aa-logo-.png)

:fill(fff,0)/p7i.vogel.de/companies/65/65/6565ddb7b8418/dcg-wort-bild-marke-dark-rgb.jpeg)

:quality(80)/p7i.vogel.de/wcms/87/17/87171bcc8fac368f66f6d367123cb70a/0125606680v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/da/44/da44566850868ba0cb33752ed38f5730/0125755760v3.jpeg)