Chancen und Risiken für die Datacenter-Branche im Jahr 2019 Die Top 10 Datacenter-Trends von Uptime Institute Research

Die Bedingungen für und die Einflussfaktoren auf den Bau, die Modernisierung und den Betrieb von Rechenzentren ändern sich massiv – nicht immer zum Positiven; So verursachen Frachkräftemangel aber auch das außerordentliche Wachstum Verzögerungen in der Lieferkette. Zugleich schaffen Innovationen in den Bereichen Vernetzung, Leistung und Belastbarkeit neue Möglichkeiten. Das Uptime-Institut hat sich die Trends für 2019 genauer angeschaut.

Anbieter zum Thema

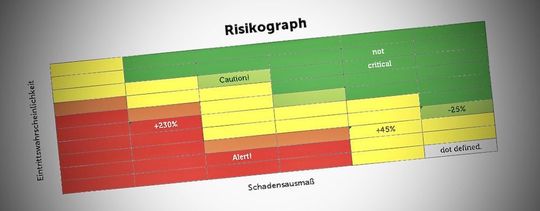

Gesamtleistung, Serviceverfügbarkeit und Sicherheit sind die wichtigsten Anliegen der Datacenter-Betreiber, die sich durch zunehmende Interdependenz und Komplexität der Ökosysteme noch verstärken. Daher sind Strategien zur Abwägung von Risikominderung und Kostenkontrolle entscheidend.

Darüber hinaus hat Uptime Institute Research zehn Schlüsselbereiche identifiziert, die das Potenzial haben, traditionelle Rechenzentrumskonzepte und Betriebsprozesse zu transformieren:

1. Hyperscaler reizen ihre Ökosysteme bis an die Grenzen aus.

Die sich beschleunigenden Anforderungen großer Cloud-Betreiber nach mehr Rechenzentrumskapazität verzerren und belasten das Ökosystem von Lieferanten, Bauherren, Betreibern und Energieversorgern.

2. Regierungen sorgen sich und verstärken Aufsicht sowie Regulierung

Regierungen auf der ganzen Welt sind zunehmend besorgt über die Gewinne und die Macht großer IT-Unternehmen - und über die Abhängigkeit der Gesellschaft von dieser unsichtbarer Infrastruktur.

3. Der Übergang zu größerer Agilität verläuft holprig.

Unterbrechungen und oft schwerwiegende Ausfälle werden anhalten, da die Betreiber mit der Komplexität der Bereitstellung verteilter, hybrider Systeme über mehrere Rechenzentren und Dienste hinweg zu kämpfen haben.

4. Der Hyper um die Edge Rechenzentren entwickelt sich schneller als die Bereitstellung.

Die Nachfrage nach kleinen, hochmodernen Rechenzentren kommt langsamer als prognostiziert. Probleme mit Sicherheit, Kosten, Geschäftsmodellen, Integration, Vernetzung und 5G-Rollout werden die Akzeptanz auch 2019 einschränken.

5. Connectivity is king.

Die Nachfrage nach schnellen und sicheren Netzwerkverbindungen sowohl zu Handelspartnern als auch zu Cloud-Betreibern steigt und steigt, da das Netzwerk zum kritischen Bestandteil der hybriden Infrastruktur wird.

6. Fachkräftemangel erzwingt neue Strategien.

Auch bei Automatisierung und Künstlichen Intelligenz (KI) wird sich der Personalengpass im Rechenzentrumsbereich verschärfen. Um mit der heutigen Nachfrage Schritt zu halten und eine drastische Unterdeckung zu vermeiden, werden die Betreiber von Rechenzentren daran arbeiten müssen, die Skills ihrer Mitarbeiter zu stärken - mit neuen Initiativen, Einstellungsstrategien und Mitarbeiterschulungen.

7. Der Klimawandel zwingt zur Überprüfung der Nachhaltigkeit.

Die mit dem Klimawandel verbundenen Risiken werden drängender, vielfältiger und umfangreicher sein, als es die IT-Planung bisher erwartet hatte. Die Ausfallsicherheit von Rechenzentren ist heute wichtiger denn je – und, so das Uptime-Institut deren Überprüfung und Zertifizierung.

8. Wirtschaftliche Zwänge sorgen für Akzeptanz von KI im Rechenzentrum.... vielleicht.

KI-basierte Ansätze zur Analyse von Risiken und Möglichkeiten der Effizienzsteigerung im Rechenzentrum, auch durch Cloud-Services, werden sich in großen Implementierungen bewähren und so die Akzeptanz im Mainstream fördern - im Laufe der Zeit wid daraus eine hohes Maß an Akzeptanz.

8. Wachsende Bedrohungen erfordern neue „Zero-Trust“-Ansätze.

Mit der noch zunehmenden Bedeutung der Rechenzentren für die Industrie und Gesellschaft treffen Schwachstellen nun auch verstärkt unternehmenskritische Einrichtungen. Unternehmen müssen daher strengere Richtlinien an die Rechenzentrumsausrüstung, Dienstleistungen, Auftragnehmer, Lieferanten und Mitarbeiter stellen.

10. Energieversorgung wird programmierbar.

Eine Kombination aus Lithium-Ionen-Batterien und neuen Formen der Energiespeicherung bietet Rechenzentrumsbetreibern zugleich neue Hebel zur Verbesserung der Rechenzentrumsleistungen, -effizienz und -agilität.

Die Transformation durch Hyperscaler

Die Anforderungen, die Hyperscaler an ihre Rechenzentren stellen, haben die Lieferkette der bereits umgewandelt. So sorgt der Sog durch diese Masse dafür, dass sich die Konkurrenz der Rechenzentrumserbauer und -betreiber etwas überlegen mussten und müssen, um für Neukunden attraktiv zu sein, zum Beispiel durch den Einsatz individuell angepasster IT, Verstärkung im Verkauf und Co-Engineering mit Anlagenherstellern.

Dennoch: Heute schon bestimmen Hyperscale-Kunden die Lieferantenbeziehungen in Bezug auf Kosten, Design und Produktion. Außerdem wächst die Kapazität im Hyperscale-Segment stärker als in den anderen Bereichen der Datacenter-Branche. Die globale Auslastung im Jahr 2018 war etwa doppelt so hoch wie vor zwei Jahren – mit regionalen Unterschieden, versteht sich.

Für das Jahr 2019 erwarten Andy Lawrence, Rhonda Ascierto und Kevin Heslin, vom Uptime-Institut und Macher der Trendstudie, dass sich Betreiber und Lieferanten auf eine stärkere Standardisierung konzentrieren. Das gilt für die Konzeption von Rechenzentren und Anlagen, von Build-Ansätzen bis zu von inkrementellen Leistungsanforderungen.

Die größeren Anbieter unter den Lieferanten indes dringen zudem auf mehr Transparenz hinsichtlich der erwarteten Nachfrage bei den Hyperscaler. Kleinere Lieferanten aber haben es schwer. Wie die Analysten schreiben, werden sie zwar noch wachsen, feststellen, dass ihre Margen sinken. Das aber liege an ihrer eingeschränkten Position in der Lieferkette.

Gesetze und Regularien

Wurde das Aufkommen von Amazon, Facebook, Google …. In den Anfängen als positive Kraft verstanden - die IT fördert Innovation, Produktivität und Handelsfluss (für einige) , schafft Arbeitsplätze, Wohlstand und Investitionen in die Infrastruktur, treten derzeit die Nachteile in den Vordergrund: mangelnde Privatsphäre, Monopolstellungen, Energieverbrauch beziehungsweise CO2-Emissionen, fragwürdige Beschäftigungspraktiken und Steuerschummeleien. Laut den Uptime-Institut-Analysten können sich vor allem die Internet-Giganten in den kommenden Jahren auf ein skeptisches und gelegentlich frostigeres Klima erwarten und müssen mit Widerständen rechnen.

Regierungen auf der ganzen Welt reagiert. Neue Vorschriften und Steuern sollen die Privatsphäre des Einzelnen schützen, die Cyber-Sicherheit verbessern, Infrastrukturinvestitionen erhöhen, Ausfallzeiten mildern und/oder soziale Störungen begrenzen. „Erwarten Sie mehr im Jahr 2019 und darüber hinaus“, heißt es im Report.

Der Wandel zur Nutzung verteilter und unterschiedlicher Ressourcen

Wie die Studienmacher schreiben, befindet sich die IT-Branche inmitten eines großen und schwierigen Übergangs - von einzelnen, sicheren und streng verwalteten Rechenzentren zu einem Netzwerk aus verteilten, dynamisch miteinander verbundenen Systemen, die Clouds, Microservices und softwaredefinierte Netzwerke (SDN) bereitstellen. Die dafür notwendige neue Architektur entsteht erst und wird teils aus neuen Rechenzentren, Netzwerken und Systemen, teils aus bestehenden Infrastruktur bestehen, die ausgebaut werden. Das Ergebnis ist ein kompliziertes verteiltes Grid, das eine Vielzahl von Anwendungen und Diensten unterstützt.

Laut Studie gibt Hinweise darauf, dass der beste - aber nicht unbedingt billigste - Weg, um die Ausfallsicherheit zu gewährleisten, darin besteht, Redundanz auf Standort- und Netzwerkebene mit verteilter IT und robusten Architekturen unter Verwendung von Cloud-Technologien zu kombinieren. Wenn die Branche 2019 in diese Richtung geht, steht ein teilweise schmerzhafter Lernprozess an.

Die Edge-Rechenzentren

Die Nutzung verteilter Ressourcen ist in der IT kein neues Thema. Doch jetzt treiben vor allem das Internet der Dinge (IoT) und das Aufkommen von Mobile Edge Computing (MEC) die Entwicklung an. Internet der Dinge heißt: Sensoren, Messgeräte, Mobiltelefone und medizinische Geräten beispielsweise, die „kommunizieren – untereinander und vor allem mit den Rechenzentrumssystemen. Virtual und Augmented Reality wird parallel dazu eingeführt.

Die erzeugten Daten steigern die Nachfrage nach Rechenzentren aller Art:

- solche in der Nähe („local edge“ oder „edge“) für die erste Verarbeitung vor Ort, Analyse und Weiterleitung;

- solche innerhalb eines lokalen Bereichs, bezeichnet als „near“ oder „regional“ edge, die für die Verbindung, Integration und Weiterleitung von Daten benötigt werden,

- und solche in der Ferne - beispielsweise Hypersclae-Einrichtungen („core“) für die Weiterverarbeitung, Analyse und Archivierung.

Uptime Institute Research hat bereits eine signifikante Nachfrage nach neuen, innovativen Rechenzentren prognostiziert, insbesondere nach Mikrorechenzentren. Dabei handelt es sich um vollständig gekapselte, integrierte, fernverwaltete und kleinflächige Anlagen, die oft an Datennetz gekoppelt sind und typischerweise weniger als 150 Kilowatt IT-Kapazität aufweisen.

Nach wie vor sei anzunehmen, so die Studienmacher, dass Mikrorechenzentren, die mit diskreter Kapazität oder als modulare, inkrementelle Blöcke großer Implementierungen eingesetzt werden können, viele Anwendungsfälle finden werden - für effiziente Upgrades von Netzwerkschränken und für die Unterstützung der Datenanalyse, -speicherung und -resilienz von IoT-Geräten in intelligenten Fabriken, Gebäuden und anderswo.

Diese neue Welle Nachfrage nach Computing in der Edge werde transformativ sein und einen Teil der aktuellen Aufmerksamkeit und des Hype rechtfertigen, so die Studie. Aber, wie es für große neue Märkte typisch sei, brauche die Einführung in großem Maßstab Zeit. „2019 wird nicht das Jahr für den Durchbruch sein, da die geschäftlichen und technischen Probleme noch nicht vollständig gelöst sind.“

Software Defined Networks (SDN)

SDN ermöglicht es Nutzern einer wie immer gearteten Cloud-Plattform, virtuelle private Verbindungen zu anderen bereitzustellen: zu Public Clouds, Service Providern, Partnern und Lieferanten in verschiedenen Rechenzentren und Regionen. Der Datenverkehr wird sicher und vorhersehbar und das hilft letztlich, die Kosten Verbindungskosten zu senken.

2019 werde weitere SDN-Implementierungen, etwa bei den Co-Locator, bringen, so das Uptime Institut. Wie die verschiedenen Anbieter miteinander vernetzt sein werden und miteinander konkurrierten, sei jedoch noch unklar: Die Kunden könnten auf mehr Offenheit drängen.

Die Nachfrage nach Fachpersonal

Die Umfrageergebnisse von Uptime Institute Research (und auch von DataCenter-Insider, siehe eBook: „Fachkräftemangel im Rechenzentrum“) deuten darauf hin, dass Rechenzentren weiterhin mit der Rekrutierung und Bindung von ausreichend qualifiziertem Personal kämpfen werden, um einen zuverlässigen Betrieb aufrechtzuerhalten und auszubauen. In der Umfrage des Uptime Institut gaben 2018 rund 45 Prozent der Befragten an, dass ein Mangel an Mitarbeitern in Rechenzentren das Wachstum der Rechenzentrumsbranche in den kommenden fünf bis sieben Jahren einschränken wird.

Deutschland ist der drittgrößte Rechenzentrumsmarkt weltweit, es mangelt aber an Fachkräften. Die Mehrzahl der RZ-Betreiber findet nicht genügend Personal. In diesem eBook haben wir die Gründe dafür ausgelotet und nach Exit-Strategien gefahndet. (PDF | ET 27.03.2018)

Deutschland ist der drittgrößte Rechenzentrumsmarkt weltweit, es mangelt aber an Fachkräften. Die Mehrzahl der RZ-Betreiber findet nicht genügend Personal. In diesem eBook haben wir die Gründe dafür ausgelotet und nach Exit-Strategien gefahndet. (PDF | ET 27.03.2018)eBook herunterladen »

In einer weiteren Umfrage gaben 38 Prozent der Rechenzentrumsbetreiber an, dass sie Schwierigkeiten haben, qualifizierte Kandidaten für offene Stellen zu finden, und 17 Prozent hatten Schwierigkeiten, Personal zu halten.

Das Uptime Institute weist darauf hin, dass der Fachkräftemangel in der gesamten Branche spürbar sein wird, da Unternehmen mit der Besetzung traditioneller Positionen wie Betrieb und Management, Sicherheit, Netzwerkanbindung, Cloud Provisioning und Maschinenbau zu kämpfen haben, aber auch mit Compliance, Verträgen/SLAs/Vendor Management, Software, Finanz- und Supply-Chain-Management sowie unternehmerischer und sozialer Verantwortung.

Energie-Effizienz, Nachhaltigkeit und Risiko

„Niemand könnte der Rechenzentrumsbranche Selbstgefälligkeit oder straußenähnliches Verhalten vorwerfen“, heißt es im Trendbericht des Uptime Institute, stehe doch eine konservative Risikobewertung steht im Mittelpunkt des Designs und des Betriebs. Doch der Klimawandel und der Bedarf nach höherer Energie-Effzienz, nach neuen Konzepte, die notwendig sind, um der Verschleuderung von Abwärme entgegen- und einer sinnhafteren Bevorratung von Strom zuzuarbeiten, bestimmen viele der Diskussionen auch hierzulande.

Dazu kommt, dass ganz konkret der steigende Meeresspiegel, höhere und häufige Hochwasser, heftigere Stürme und andere Auswirkungen des Klimawandels unerwartete und potenziell große Herausforderung für die Betreiber von Rechenzentren darstellen können. Laut Uptime Institut dürfte das wiederum Risikobewertungen von vor drei oder fünf Jahren veraltet haben lassen.

Hinweis: Am 31.01. 2019 bietet der Eco – Verband der Internetwirtschaft e.V. in Frankfurt am Main ein Diskussionsforum zur Risikodarstellung und Bewertung von Rechenzentren.

KI im Rechenzentrum

Rechenzentrumsbetreiber sind generell vorsichtig gegenüber unerprobten oder riskanten Technologien und Strategien, müssen sie auch sein. Doch so mancher Datacenter-Manager ist etwa beim Machine Learning (ML) weiter, als andere ahnen. Am häufigsten eingesetzt wird ML in Form einer Software zur Optimierung der dynamischen Kühlung, die den Betriebszustand von Kühlgeräten, Frequenzumrichter und Temperatursollwerte automatisiert. Mit der Einführung der ersten DMaaS-Angebote (Datacenter Management as a Service) im Jahr 2016 begann jedoch eine neue Welle der Verbreitung von KI in Rechenzentren.

Künstliche Intelligenz ist im Datacenter-Umfeld neuerdings in aller Munde und Rechenzentren rüsten sich bereits für KI-Workloads auf und um. Das selbstverwaltende Rechenzentrum ist keine Vision mehr. (PDF | ET 27.03.2018)

Künstliche Intelligenz ist im Datacenter-Umfeld neuerdings in aller Munde und Rechenzentren rüsten sich bereits für KI-Workloads auf und um. Das selbstverwaltende Rechenzentrum ist keine Vision mehr. (PDF | ET 27.03.2018)eBook herunterladen »

Mit DMaaS werden große Mengen an überwachten Daten über Geräte und Betriebsumgebungen aus verschiedenen Einrichtungen (und verschiedenen Kunden) verschlüsselt, in Datenpools zusammengefasst und mit ML – beispielsweise zur Erkennung von Anomalien und Strom-Ereignissen - analysiert. ML-getriebene Ergebnisse haben sich weitgehend auf die Verbesserung bestehender Prozesse konzentriert, wie die Verkürzung von Alarmvorlaufzeiten und Ursachenanalysen, die Verbesserung der PUE und die Optimierung des Nutzungsgrades - Anwendungsfälle, die spürbare betriebliche Einsparungen bringen.

Im Jahr 2019 wird der größte Teil von DMaaS mit einer wachsenden Anzahl von Anwendern zum Proof-of-Concepts ausgebaut. Die Analysten des Uptime Institute erwarten auch, dass damit auch der Grundstein für eine weitere Automatisierung gelegt wird.

Kontrolle ist besser

Für viele Datacenter-Betreiber ist die angemessene Überwachung von Personen und RZ-Equipment ein anhaltendes und lästiges Problem. Doch mit der zunehmenden Intelligenz und Vernetzung von Rechenzentren über IP-basierte Steuerungen und Geräte wächst die Art und Weise, wie sie gefährdet werden können.

Unternehmen verbinden sich oft über private Netzwerke mit Kontrollen und gewähren Zugang zur Außenwelt für die Unterstützung der Hersteller von Gebäude-Management-/Automatisierungssystemen und -anlagen. Während IT-Abteilungen sich für Sicherheitsansätze wie Zero-Trust interessieren, bei denen alle Zugriffsversuche auf IT-Systeme, sowohl interne als auch externe, überprüft werden, gibt es relativ wenige Rechenzentrumsabteilungen, die ähnlich ausgestattet sind.

Im Jahr 2019 aber werden wahrscheinlich mehr Rechenzentren ihre Bemühungen intensivieren und sich auf Richtlinien zubewegen, bei denen etwa der Zugang zu Netzwerkressourcen nur gewährt wird, wenn die dafür vorgesehenen Bedingungen erfüllt sind, einschließlich Tageszeit und Zugangsort. Die Sicherheit von softwaregesteuerten Geräten - Sicherheitsinvestitionen und Fokussierung muss mit zunehmenden Bedrohungen Schritt halten.

Strom kostet

Da Rechenzentren immer größer werden, steigen auch die Kosten für Strom und Stromverteilungsanlagen. Die Stromkosten sollen sinken ohne das Risiko zu erhöhen. Das Uptime Institute sieht drei wesentliche Tätigkeitfelder, in denen sich die Kosten reduzieren lassen:

- Im Betrieb: Hier kann der Energie-Aufwand (zum Beispiel durch Minderung des PUE-Werts) gesenkt werden.

- Bei der IT-Last: Die Auslastung erhöhen oder der Stromverbrauch der Systeme senken.

- Beim Stromlieferanten: Verhandeln der Nebenkosten, Lager- und Serviceverpflichtungen

Seit fast zwei Jahrzehnten ist das Bemühen um Kostensenkung, insbesondere in der IT zu beobachten, so die Studienmacher, doch die Fortschritte seien begrenzt. Uptime Institute Research gehe davon aus, dass sich dies bald ändern könnte – durch die Verlangsamung von Moore's Law, der Aufstieg der Cloud, verbesserte Management-Tools, die Integration von IT die Gewerke und Gebäude sowie durch eine schnelle Einführung von Li-Ionen-Akkus.

Artikelfiles und Artikellinks

(ID:45664387)

:quality(80)/p7i.vogel.de/wcms/92/69/926957985fcebbb3e065a2faf9c652ea/0131454826v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/23/a2/23a22ca2809e9d56ee77adc7ff357565/0131271145v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/db/65/db659edded4ec36a88aa5f13abf4bbf0/0131318711v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/53/61/536101b95adc3b78a7eba0f8de2db47c/0131269746v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/b8/36b8ba441409b46b71455151dfc60538/0131002266v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/09/03/09035e7bbac6cadc0b1f21818144194f/0131423113v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a1/dd/a1ddf02ccf707e1002dc9f0b0c41f6cf/0131298906v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/af/21/af21f7761950c841306c223f77f91155/0131423495v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/64/6b/646b6d3886e625484482cb2ad1d2df30/0131318698v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/5c/1f/5c1fd669777e3f56dfd9fdd7d09995f7/0131301166v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/81/b3/81b359118a0e0e395cdebbddcfa03243/0130668020v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/94/179447f80cab81cfdbadd85c46cc9b72/0131191448v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/30/8b/308ba98f85f2a8da419e48fe6ea50f64/0131315309v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/49/7a/497af014bb9c80eb964cbd4b170f1af6/0130709118v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/95/6e9529f775612253d132e9002edc3c6f/0131312462v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/04/f3/04f34ccd22d33a964e864e5ad0cc9678/0131308317v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b2/b5/b2b53d801176f1a4e6dbb7e80861d738/0131311098v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8b/64/8b64e9369f05a2b07bfa2c76e53819be/0131210510v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/ec/41ecbc8077275d54daf5895ae6f98b6c/0130998245v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/00/24/0024808d38d25431ae2719d3f8252908/0130726727v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/60/de/60ded37a20a00/logo-vertiv.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/66/c3/66c33d1f71ef2/daxten-logo-600-x-600.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/65/6d/656def888f484/02-01-eps-logo-4c-rzi.jpeg)

:quality(80)/p7i.vogel.de/wcms/89/97/899791db276100161ea76f79dd649245/0131131469v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0b/42/0b422077efa45763a40232b51ce86854/0128902727v1.jpeg)