Supercomputing neu gedacht 100mal effizienter bei 1018 Operationen pro Sekunde

Die Idee hinter „DEEP“ ist so einfach wie genial. Das Akronym steht für „Dynamical Exascale Entry Platform“. Das ist ist ein europäisches Supercomputing-Projekt unter der Leitung des Forschungszentrums Jülich. Es kombiniert intelligent und flexibel traditionelle Cluster mit einem „Booster“, einem Cluster von Beschleunigern, in einem einzigen Rechner.

Anbieter zum Thema

Es liegt in der Natur der Sache, dass die Supercomputing Community von einem beständigen Streben nach „Höher! Schneller! Weiter!“ geprägt ist. Der nächste große Meilenstein der Branche sind so genannte ExaFLOP Systeme – Computer, die 1018 Rechenoperationen pro Sekunde ausführen können und somit um den Faktor zehn leistungsfähiger sind, als die derzeit schnellsten Höchstleistungsrechner weltweit.

Erst kürzlich erklärte Günther Öttinger, EU Kommissar für Digitale Wirtschaft und Gesellschaft, dass Europa bis 2025 genau so einen Rechner haben und damit mindestens in den weltweiten Top 5 der Supercomputer landen soll.

Aber so spannend die technologische Herausforderung an sich ist, einen immer größeren und schnelleren Rechner zu bauen, liegt die eigentliche Motivation darin, mit Hilfe von Höchstleistungsrechnern ein Maximum an wissenschaftlicher Erkenntnis zu erzielen. Hier stellt sich die spannende und zentrale Frage: Wie viele HPC-Anwendungen können tatsächlich von einem ExaFLOP Computer profitieren?

Keine Chance für "Weitermachen wie bisher"

Den Bau eines solchen Systems zu fordern ist leicht – ihn umzusetzen deutlich komplizierter: Verschiedene technologische Herausforderungen erlauben es nicht, einfach so weiterzumachen, wie bisher: Würde man heutige Systeme zu einer Leistung von einem ExaFLOP aufrüsten, müsste man daneben ein eigenes Kraftwerk bauen.

Die Community hat sich allerdings eine Obergrenze von 20 Megawatt für einen Exascale-Rechner gesetzt. Daher müssen Technologien entwickelt werden, die im elektrischen Leistungsbedarf 100-mal effizienter sind als heute. Da zudem die Ausfallwahrscheinlichkeit proportional zur Größe der Systeme anwächst, sind neue Konzepte zur Steigerung der Ausfallsicherheit der Maschinen unabdingbar.

Für die meisten Anwendungen wird es hingegen am problematischsten sein, dass sich die Programmierbarkeit von Supercomputern mit vielen Millionen Rechenkernen sehr schwierig gestalten wird. Und nicht zuletzt ist die Skalierbarkeit der Simulationsanwendungen auf Höchstleistungsrechnern ein limitierender Faktor. Hier kämpft die Community mit dem so genannten Amdahlschen Gesetz. Dieses besagt, dass sich parallele Algorithmen nur soweit beschleunigen lassen, wie der Teil der Anwendung, der sich am wenigsten gut parallelisieren lässt.

Der Kampf gegen das Amdahlsche Gesetz

Eine Vielzahl heutiger HPC-Anwendungen koppelt Modelle, die unterschiedlich gut parallelisierbar sind und damit unterschiedliche Anforderungen an die zu nutzende Hardware stellen. Ein Beispiel ist die Simulation einer Gasturbine, bei der sowohl die Strukturmechanik der Turbine als auch die Verbrennungsdynamik der Treibstoffe simuliert werden sollen.

Heutige, homogene HPC-Systeme können diese Anwendungen nur unzureichend bedienen. Stattdessen besteht hier der Bedarf an Rechnern, die unterschiedliche Prozessortechnologien integrieren.

Genau hier setzt das europäische Forschungsprojekt DEEP (Dynamical Exascale Entry Platform) an, das vom Forschungszentrum Jülich geleitet wird und ein Konsortium von 16 Partnern aus acht europäischen Ländern vereint. Die Wissenschaftler wollen eine Brücke in die neue Ära bauen. Diese soll es ermöglichen, dass bestehende und zukünftige Simulationsanwendungen von immer leistungsfähigeren, heterogeneren HPC-Systemen profitieren können.

Das geniale Konzept

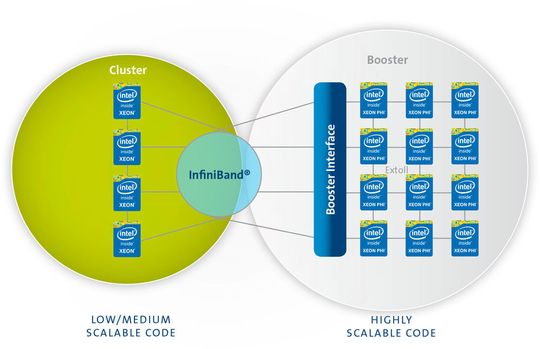

Heutzutage wird das Supercomputing von zwei Architekturansätzen dominiert. Auf der einen Seite findet man große Cluster, die leistungsfähige Server-Prozessoren verwenden und für Anwendungen gedacht sind, die eine große so genannte ‚single-thread performance’ benötigen. Auf der anderen Seite befinden sich Maschinen, die relativ leistungsschwache Prozessoren in extrem großer Zahl nutzen. Diese eignen sich besonders für sehr reguläre und damit gut skalierbare Codes.

Die grundlegende Idee von DEEP ist so einfach wie genial: Man verheiratet diese beiden Arten von HPC-Systemen und kombiniert ein traditionelles Cluster mit einem so genannten Booster – einem Cluster von Beschleunigern – in einem einzigen Rechner.

Damit lassen sich die unterschiedlichen Parallelisierungsgrade abbilden, die heutige Simluationscodes oft aufweisen: Solche Code-Teile, die nur begrenzt skalieren, laufen auf dem Cluster, Code-Teile, die hochskalierbar sind, auf dem Booster.

Die Umsetzung

So geradlinig die Idee, so komplex gestaltete sich allerdings die Umsetzung: Im Verlauf des DEEP Projekts haben mehrere Entwicklerteams daran gearbeitet, das Konzept in einem realen Prototyp umzusetzen – und zwar inklusive des dafür benötigten Systemsoftware Stacks.

Co-Design lautete hierbei das Zauberwort: Nur durch engste Zusammenarbeit zwischen den Hardware- und Software-Experten ließ sich sicherstellen, dass das System den Anforderungen der unterschiedlichsten Nutzergruppen gerecht wird. Das Ergebnis, der DEEP Supercomputer mit einer Peak Performance von 500 TFLOP/s verteilt auf nur 1,5 Racks, steht seit Herbst 2015 am Jülich Supercomputing Centre.

Bei dem Cluster-Teil der Maschine handelt es sich um eine serienmäßige Lösung – ein Warmwasser-gekühltes „Aurora“ Cluster des italienischen Herstellers Eurotech mit 128 Rechenknoten (jeder mit zwei „Intel Xeon E5“-CPUs), verbunden über ein Infiniband (QDR)-Netzwerk. Den Booster hingegen mussten die Entwickler der Partner Eurotech, Intel, Jülich Supercomputing Centre, Universität Heidelberg und des Leibniz-Rechenzentrums komplett neu entwerfen und bauen. Das System basiert ebenfalls auf der Eurotech Aurora-Technologie – allerdings mit speziell angepasstem Board-Design – und verfügt über 384 „Intel Xeon Phi“ (7120x) Co-Prozessoren, verbunden über ein Extoll-Netzwerk auf FPGA-Basis.

Die jüngste DEEP-Variante

Seit Anfang 2016 gibt es den Booster zusätzlich noch in einer alternativen Variante: Hierbei ist die Anbindung an das Extoll-Netzwerk über die neuen, leistungsfähigeren ASIC-basierten „Tourmalet“-Karten anstatt der FPGA-Implementierung realisiert.

Ein weiterer Unterschied beim „GreenICE Booster“ ist die Kühltechnik. Die Forscher nutzten die Gelegenheit, beim zweiten Prototypen eine weitere Kühlmethode zu testen: Eine innovative Tauch-Siede Kühlung, bei der die Komponenten in einer High-Tech-Flüssigkeit („Novec“) gebadet werden und der Kühleffekt durch einen Phasenübergang – letzten Endes das Sieden der Flüssigkeit – entsteht (‚Immersion Cooling’, siehe auch: Kühlen durch Kochen, 3M und Boston schicken Supermicro-Server zum Tauchen).

Die zentrale Herausforderung bei der Entwicklung bestand darin, den Booster – ein Cluster von Beschleunigern – so zu entwerfen, dass die Xeon-Phi-Prozessoren selbständig Booten können, also ohne den bisher (noch) notwendigen Umweg über Host-CPUs. Denn nur mit den selbst-bootenden Beschleunigern lässt sich die Flexibilität des Systems garantieren.

Selbst-bootende Beschleuniger

Sind in aktuellen, heterogenen Supercomputing-Architekturen gewisse Kombinationen von CPU und Beschleunigerkarten starr vorgegeben (je nach Bauart in der Regel 1:1 oder 1:2, seltener 1:4 oder in Ausnahmefällen 1:8), können Nutzer des DEEP-Systems die für sie optimale Zusammensetzung von Cluster- und Booster-Knoten vollständig flexibel wählen (n:m).

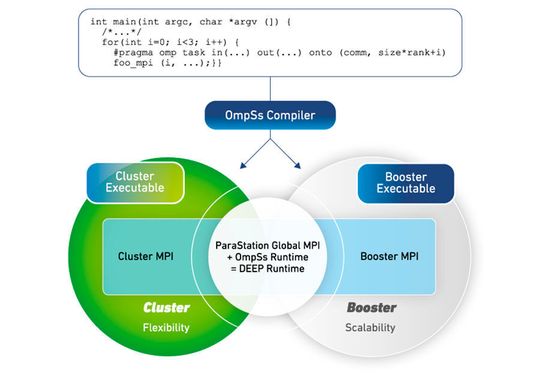

Der eigens für die DEEP Maschine entwickelte Software-Stack ermöglicht es Anwendern, diese Aufteilung auf Cluster und Booster unkompliziert vorzunehmen. Die Systemsoftware basiert auf den im HPC-Bereich weit verbreiteten Programmiermodellen „OpenMP“ und „MPI“ und verbirgt die komplexe Hardware-Architektur für den Nutzer. Dieser muss sich lediglich überlegen, welche Teile seines Codes sich besser für das Cluster eignen, und welche idealerweise auf dem Booster laufen und wie viele der jeweiligen Prozessortypen benötigt werden.

Das globale MPI sorgt für eine hochperformante Kommunikation zwischen den verschiedenen Teilen des Systems. Die Aufteilung des Simulationscodes in hoch- und weniger skalierbar und die weiteren Optimierungen sind im Übrigen von Vorteil auf allen heterogenen Supercomputerarchitekturen.

Wer profitiert davon?

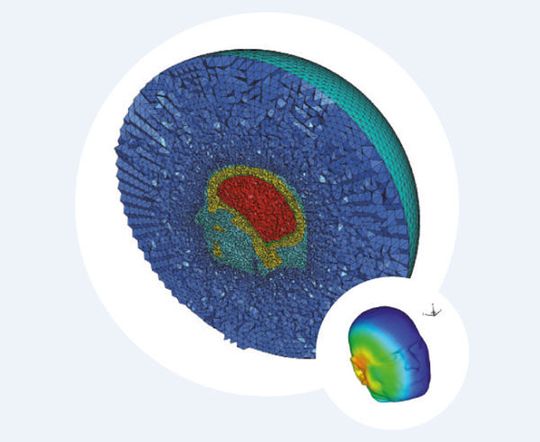

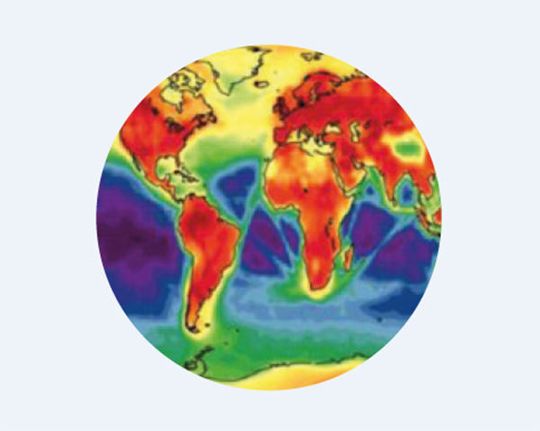

Im Projekt DEEP und seinem Nachfolger „DEEP-ER“, in dem vorrangig Lösungen für datenintensive Codes und die Steigerung der Ausfallsicherheit erarbeitet werden, sind insgesamt elf HPC-Codes aus verschiedensten Bereichen integraler Bestandteil der Forschungs- und Entwicklungsarbeiten: Von Astro- über Plasma- bis hin zu Geophysik, von Erdbeben- und Klima- bis hin zu Hirnforschung oder Radioastronomie.

Das Spektrum an Anwendungen aus Wissenschaft und Industrie wurde bewusst breit angelegt. Bei der Entwicklung der Prototypen sollten schließlich Anforderungen möglichst unterschiedlicher Simulationscodes berücksichtigt werden. Und Tests auf dem bereits laufenden DEEP Prototypen zeigen: Egal welche Anwendungen, egal wie deren Eigenschaften sind - aufgrund der hohen Flexibilität des Systems profitieren ausnahmslos alle Codes vom DEEP Cluster-Booster Ansatz.

Multiphysik und mutliskalen Anwendungen, die von Haus aus unterschiedliche Skalierungsmuster aufweisen, profitieren von einem perfekten „Mapping“ ihres Codes auf der System-Hardware. Hochskalierende Anwendungen laufen direkt auf dem Booster und greifen in manchen Fällen auf das Cluster zurück, um Input-Output-Vorgänge zu beschleunigen. Wieder andere Nutzer, integrieren zum beispiel Pre- und Post-Processing enger und erhöhen damit ihre „time-to-solution“, da in DEEP die vorhandene Hardware- und Software-Infrastruktur komplexere Workflows erlaubt.

Tauglich für viele Anwendungen, auch aus der Industrie

Genau deswegen ist diese Architektur besonders interessant für wissenschaftliche Rechenzentren, die typischerweise ein sehr breites Spektrum an Anwendern haben. Vor allem, weil die dynamische Reservierung von Rechnen-Ressourcen, die DEEP ermöglicht, die Nutzung des Systems deutlich erhöht und dadurch den Return on Investment (ROI) maximiert.

Nichtsdestotrotz ist der Cluster-Booster Ansatz auch eine spannende Alternative für Rechenzentren oder Anwender aus der Industrie, die hauptsächlich ähnliche Codes auf ihren Maschinen laufen lassen. Denn genau wie bei anderen Systemen auch, sollte man sich vor der Anschaffung intensiv Gedanken zu den Anforderungen an den Rechner machen. Da sich die Zusammensetzung aus klassischen Prozessoren im Cluster und Co-Prozessoren oder anderen Beschleunigern im Booster beliebig gestalten lässt, kann das System perfekt auf unterschiedliche Anforderungen maßgeschneidert werden.

Da die Entwicklungszyklen im HPC sehr kurz sind, mag die Hardware des aktuellen Prototyps bereits bald veraltet sein. Die DEEP Systemsoftware und die Programmierumgebung bleiben jedoch auch für zukünftige Systeme aktuell und erlauben es Nutzern, auch andere heterogene Systeme effizient zu verwenden, da die Anwendungen portabel sind. Zudem ist das grundlegende Cluster-Booster-Konzept zukunftsweisend und wird die Entwicklung künftiger Systeme maßgeblich beeinflussen, nicht zuletzt, weil es den Trend zu heterogenen Systemen aufgreift, dabei aber ganz klar den Fokus auf die Anforderungen von unterschiedlichsten Nutzergruppen legt.

Eine erste Installation im Regelbetrieb ist bereits geplant: Das Jülich Supercomputing Centre beabsichtigt demnächst seine „JURECA“-Maschine um einen 10 PFLOP/s Booster erweitern.

Hinweise:Ausführliche Informationen zum Forschungsprojekt DEEP und seinem Nachfolger DEEP-ER finden sich auf den Webseiten:

Das DEEP Projekt wurde von der Europäischen Kommission gefördert unter der Fördernummer: ICT-287530.

Bei Interesse an Tests mit dem Prototypen wenden sich Interessanten gerne an pmt@deep-project.eu.

(ID:44155927)

:quality(80)/p7i.vogel.de/wcms/9b/71/9b71f0cbf75b2fcdb03b0515f7de85b1/0131546105v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/40/11/4011ec959c9f026bff4c9b26556000b8/0131576135v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ab/da/abda4198eec4667e63121b4038eb9696/0127011549v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/cb/71/cb71e590a7dc308eaba6d56d64b7eb88/0131454836v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8a/e5/8ae5e6328c2f85c5f9e73dab50830070/0131318362v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/6a/d9/6ad97677dbd05d030c274d5da2ac55fa/0131318196v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e2/31/e231589b0fc5261a4d5174e8efde28d9/0131455263v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e0/98/e09817246d3203a4b491b223997c76dd/0131317840v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a1/dd/a1ddf02ccf707e1002dc9f0b0c41f6cf/0131298906v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/af/21/af21f7761950c841306c223f77f91155/0131423495v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/80/6e803451356aedef2f7983857510d019/0131541101v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/94/179447f80cab81cfdbadd85c46cc9b72/0131191448v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c6/2b/c62b87f2a390d03996b4db6e3c51b1ee/0131312711v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/b8/36b8ba441409b46b71455151dfc60538/0131002266v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/49/7a/497af014bb9c80eb964cbd4b170f1af6/0130709118v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/b4/66b480de5d9d98134871015eef2737fe/0131527877v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8f/c0/8fc06e30fbc48da5ff5e068b2a32fc40/0131517134v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e9/1f/e91fc245c584b6ed72107ab6433bbf9a/0131310055v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/95/6e9529f775612253d132e9002edc3c6f/0131312462v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/ec/41ecbc8077275d54daf5895ae6f98b6c/0130998245v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/64/e4/64e4be0db6ddc/rittal-4c-w.png)

:fill(fff,0)/p7i.vogel.de/companies/60/de/60ded37a20a00/logo-vertiv.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/68/df/68dfe5154f605/consystech-logo-dci.jpeg)

:quality(80)/p7i.vogel.de/wcms/7f/39/7f3904c8e34848303d65dcb8fa84bef0/0126326548v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/30/8b/308ba98f85f2a8da419e48fe6ea50f64/0131315309v1.jpeg)