Gartner-Report „Exploring the Edge: 12 Frontiers of Edge Computing“ Vom Daten-Center zu Daten-Tröpfchen

Der Gartner-Report zum Edge-Computing „Exploring the Edge: 12 Frontiers of Edge Computing“ arbeitet gemeinsame Elemente verschiedener Anwendungsszenarien heraus und diskutiert die geänderte Datacenter-Welt, die durch die neuen Workloads mit ihren riesigen Datenvolumina erforderlich wird. Hier die wichtigsten Punkte.

Anbieter zum Thema

Anwendungen im IoT-Bereich (selbstfahrende Autos, Digitale Fabrik, Smart Home und viels mehr) benötigen aufgrund der dabei generierten gigantischen Daten-Mengen Verarbeitungs-Kapazitäten nahe an den Sensoren (Edge). Edge Computing ergänzt die Verarbeitungskapazitäten der Rechenzentren (heute normalerweise in der Cloud) direkt an den Devices.

In der Regel wird noch eine weitere Computing-Stufe benötigt, die die Kommunikation zwischen Cloud und Edge strukturiert und steuert: Wo wird was verarbeitet? Wo wird was gespeichert? Wann müssen welche Daten in welcher Form aggregiert werden? Für diese Vermittlungsstufe wird mittlerweile der Begriff Fog-Computing verwendet.

Der Analyst Thomas Bittman geht in dem Report davon aus, dass im Jahr 2021 mehr als 50 Prozent der Großunternehmen - gegenüber 5 Prozent im Jahr 2019 - wenigstens einen Anwendungsfall haben, um eine IoT-nahe Workload oder eine Workload, in der virtuellen und reale Elemente zusammenspielen („immersive experiences“) zu betreiben. Und noch zwei Jahre später prognostiziert der Gartner-Mann, dass 50 Prozent der Großunternehmen wenigstens sechs Edge-Computing-Use Cases für IoT- und „Immersions-Szenarien“ am Laufen haben.

Die Gemeinsamkeiten der Use Cases benötigen die Aufmerksamkeit

Angesichts dieses bevorstehenden Entwicklungsschubs beim Edge-Computing plädiert Gartner für eine Abkehr vom derzeit vorherrschenden Ad-hoc-Ansatz - „90 Prozent der Unternehmen fokussieren sich zu sehr auf die spezifischen Rahmenbedingungen des Edge-Use-Case, den sie gerade umsetzen“, sagt er - und stattdessen für einen über mehrere Jahre angelegten proaktiven Ansatz, der die Gemeinsamkeiten verschiedener Anwendungsszenarien In den Blick nimmt.

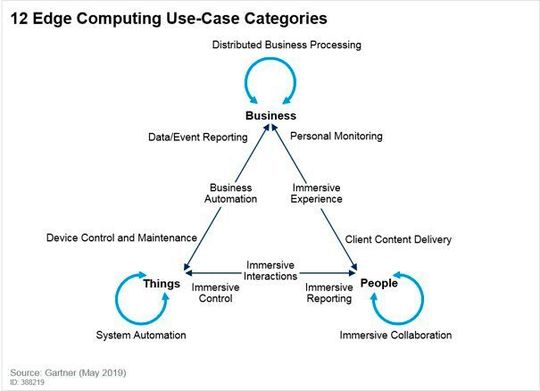

Gartner leistet dafür Hilfestellung, indem man die möglichen Anwendungsszenarien für Edge-Computing in zwölf Kategorien unterteilt, die in einem Dreieck situiert sind, das ein Interaktionsschema von Menschen, Geschäften und Dingen abbildet (siehe: Abbildung). Die Analysten sind der Meinung, dass dieses Schema den IT-Verantwortlichen für IT-Infrastruktur und IT-Betrieb dabei hilft, geschäftliche Chancen systematisch zu erkennen und dabei eine sinnvolle Edge-Computing-Architektur aufzubauen, die deutlich mehr Wert hat als eine Vorgehensweise, die mit jedem neuen Use Case ständig das Rad neu erfindet.

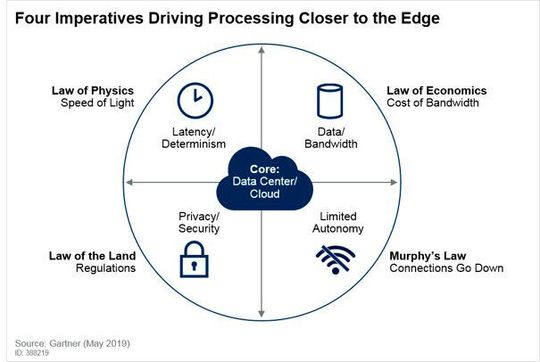

Das Analystenhaus hat auf der Basis seiner Kundenbefragungen vier Parameter („Imperative“) identifiziert, die Unternehmen in Richtung Edge-Computing zwingen (siehe: Abbildung unten):

- Latenz /deterministische Umgebungsbedingen,

- Vermeidung von Bandbreiten-Engpässen

- Autonome Entscheidungsmöglichkeiten vor Ort, wenn

die Verbindung zum Rechenzentrum nicht zur Verfügung steht

Etablierung von speziellen Datenschutz- und Sicherheitsmaßnahmen, da die Daten am Edge zunehmend kritischer in puncto Sicherheit und

- Schutz der Privatsphäre werden (Gesundheitsdaten, biometrische Daten, kritische Maschinendaten in der digitalen Fabrik)

Innerhalb der genannten Kategorien sind die verschiedenen Anwendungsfälle durch jeweils verschiedene „Imperative“ definiert. So mag es beispielsweise eine Automatisierungslösung geben, bei der eine riesige Flut von Kamera- und Sensordaten vor Ort gefiltert und vorverarbeitet werden muss, um Bandbreite zu sparen, während eine andere Automatisierungslösung mehr Autonomie direkt am Sensor und superschnelle Echtzeitreaktionen benötigt.

Edge-Computing erweitert User-Optionen

Der Report stellt eine große Menge an Anwendungsszenarien für Edge-Computing und die darin jeweils enthaltenen Mensch-Maschine-Business-Interaktionen recht anschaulich dar und macht deutlich, inwiefern Edge-Computing auch die Steuerungs- und Einflussnahme-Möglichkeiten der einzelnen Nutzer erweitert. So erhalten Nutzer mit Edge-Computing beispielsweise oft die Möglichkeit, selbst zu entscheiden, wo bestimmte Daten gespeichert werden und wie diese genutzt werden.

Freilich können mit diesen erweiterten Möglichkeiten auch neue Sicherheitsprobleme entstehen, die ihrerseits wieder eingehegt werden müssen. Gartner-Analyst Bittman sieht Edge-Computing auch in der Tradition der „Content Delivery Networks“. Diese würden dadurch „dreidimensionaler“: Inhalte könnten direkt von den zentralen Rechenzentren, Content Delivery Networks oder auch Mikrorechenzentren an die Nutzer vor Ort geliefert und nutzten dann lokale Signale, die anzeigen, wann und wo diese Inhalte verwendet werden.

Effizientes Daten-Management entscheidend für den Erfolg von Edge-Computing

Der Report hat zwar nicht in der Hauptsache den Zusammenhang von Datacenter-Architektur und Edge-Computing zum Thema, aber erwähnt an verschiedenen Punkten immer wieder diesen Konnex. Schließlich liegt es auf der Hand, dass es sich bei dem Zusammenwirken von klassischen Rechenzentren, Fog-Steuerungszentren (Minirechenzentren??) und Edge-Verarbeitung nicht um eine lose Aneinanderreihung von verschiedenen Einheiten handeln kann, sondern dass jedes Element jeweils auf das andere auch einwirkt und es sukzessive verändert, sozusagen: Wandel durch Annäherung.

Je softwarebasierter die einzelnen Einheiten dabei sind, desto besser dürften sie für diesen Wandel jeweils geeignet sein. „In vielerlei Hinsicht kombiniert Edge-Computing-Management die Data-Center-Verwaltung mit den Skalierungsmöglichkeiten, die Mobile Device Management bietet“, schreibt Gartner-Analyst Bittman und zieht folgendes Resümee: „Edge-Computing wird Datenzentren und Datenseen in viele einzelne Daten-Tröpfchen verwandeln, die jeweils verwaltet, archiviert, aggregiert, weiter analysiert und nach Gebrauch unter Umständen auch gelöscht werden. Insofern ist effizientes Daten-Management ganz entscheidend für den Erfolg oder auch den Misserfolg für den Aufbau von Edge-Computing.“

Hinweis: Den Gartner-Report „Exploring the Edge: 12 Frontiers of Edge Computing“ bietet Equinix zum Download an.

* Jürgen Höfling ist freier Autor und lebt in München.

Artikelfiles und Artikellinks

(ID:46337124)

:quality(80)/p7i.vogel.de/wcms/c7/54/c754757c7446742d9caf5d77bef3a31d/0131655757v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f8/9f/f89fc5b3ceb14b7ab5e18dc27342229e/0131606788v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/0e/03/0e032c8ef5c1fbf81895e76d1d030977/0131669954v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f0/55/f05563d06ec1adfe9418965c8198361e/0131573273v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/86/15/86152540923c089f2f69da6b62f2f0a5/0131647678v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a2/de/a2de7cb23cfbecebc9d41861fcd04b3b/0131646536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f8/90f8635e66eeec5e1585ce3a269d5316/0131650168v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/48/a0/48a062512b997888422d6fd83a7552f0/0131634933v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0a/83/0a8371885d52666e74c9b549a0a6050e/0131542674v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/6b/35/6b3528ecb1548d836b815c159a772d72/0131318428v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/80/6e803451356aedef2f7983857510d019/0131541101v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/97/ae97c2dc5b160060993cc8c12d2c6760/0131604900v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ab/da/abda4198eec4667e63121b4038eb9696/0127011549v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bf/a9/bfa9522af622dfe0fca8fcf1ae0f157b/0131569943v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/b8/36b8ba441409b46b71455151dfc60538/0131002266v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/34/dd/34ddaf5cb8a24ace5f71306deedef377/0131704455v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3b/44/3b44e1fd4831cf41de1aa672ad19bcdd/0131703269v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0c/20/0c2056ff1bf1bcb98586ca6c68d037f6/0131658852v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b4/35/b435d8950fd8d2a2c9c257aebce9f901/0131650764v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/64/e4/64e4be0db6ddc/rittal-4c-w.png)

:fill(fff,0)/p7i.vogel.de/companies/60/de/60ded37a20a00/logo-vertiv.jpeg)

:fill(fff,0)/images.vogel.de/vogelonline/companyimg/125000/125044/65.jpg)

:quality(80)/p7i.vogel.de/wcms/b6/b8/b6b861346b607b7ecc0b60dc45c46012/0129449658v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8d/17/8d17dc752d9c5c556a59a1635cdde230/0127608748v2.jpeg)