Wachsende Nachfrage nach containerisierter KI-Entwicklung Nvidia zertifiziert AI-Enterprise für VMware, Cisco und Hitachi Vantara

Die jüngste Nvidia-Version 1.1 von „AI Enterprise Software Suite“ bietet Unterstützung für „VMware vSphere“ mit „Tanzu“ für die KI-Entwicklung mit Kubernetes-Containern und virtuellen Maschinen. Sie wird zeitgleich mit dem Debüt der vom Hersteller zertifizierten Systeme von Cisco und Hitachi Vantara eingeführt.

Anbieter zum Thema

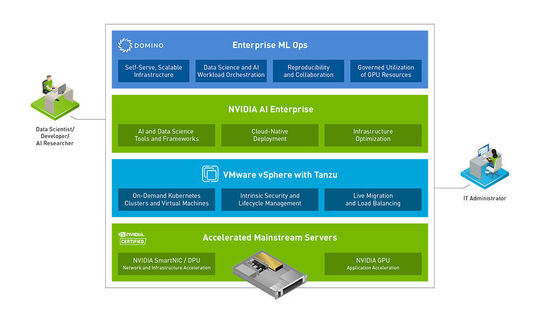

Bisher hat die VMware-Unterstützung und die Validierung für die 'MLOps Enterprise'-Plattform mit VMware vSphere/Tanzu von Domino Data Lab nur auf Testbasis zur Verfügung gestanden. Jetzt können Unternehmen mit Nvidia-Technik beschleunigte KI-Workloads auf mithilfe von der AI Enterprise Software Suite vSphere ausführen, und zwar sowohl in Kubernetes-Containern als auch in virtuellen Maschinen. Diese Integration ermöglicht es mehr Unternehmen, Data Science kosteneffizient zu skalieren, indem Forschung, Modellentwicklung und Modellbereitstellung auf beschleunigten Mainstream-Servern beschleunigt werden.

Nach Angaben von Nvidia gehören zu den von Kunden am häufigsten nachgefragten Funktionen von der Software-Suite die Produktionsunterstützung für die Ausführung auf VMware vSphere mit Tanzu, die es Entwicklern ermöglicht, KI-Workloads sowohl auf Containern als auch auf virtuellen Maschinen innerhalb ihrer vSphere-Umgebungen auszuführen. Jetzt biete die von Nvidia und VMware kuratierte KI-Plattform einen integrierten, vollständigen Stack aus containerisierter Software und Hardware, die für KI optimiert sind und vollständig von der IT verwaltet werden.

Außerdem kündigt Nvidia an, in Kürze VMware vSphere mit Tanzu-Unterstützung in das eigene „Launchpad“-Programm für AI Enterprise aufzunehmen, das an neun Equinix-Standorten auf der Welt verfügbar ist. Qualifizierte Unternehmen können KI-Workloads kostenlos in den Labs testen und prototypisieren, die für KI-Praktiker und IT-Administratoren entwickelt wurden. Die Labs zeigen, wie man gängige KI-Workloads wie Chatbots und Empfehlungssysteme mit der Nvidia-Suite und VMware vSphere sowie bald auch mit Tanzu entwickelt und verwaltet.

Das Verwalten containerisierter, virtueller KI

Vor allem Letzteres ist zumeist noch Neuland. Während Unternehmen containerisierte Entwicklung für KI gerne nutzen, erfordert die Komplexität dieser Workloads eine Orchestrierung über viele Infrastrukturebenen hinweg. Nach Herstellerangaben soll AI Enterprise 1.1 dabei helfen, diese Probleme zu lösen

Das spiegelt auch die Aussage von Gary Chen, Research Director, Software Defined Compute bei IDC, wider: „KI ist ein sehr beliebter moderner Workload, der zunehmend in Containern eingesetzt wird. Die Bereitstellung von KI-Funktionen in großem Umfang im Unternehmen kann jedoch äußerst komplex sein und erfordert eine Aktivierung auf mehreren Ebenen des Stacks, von KI-Software-Frameworks, Betriebssystemen, Containern, VMs und bis hin zur Hardware. Schlüsselfertige KI-Komplettlösungen können die Bereitstellung erheblich vereinfachen und KI im Unternehmen zugänglicher machen."

Mehr Hardware, mehr Partner

Vier neue Systemintegrationspartner schließen sich dem Ökosystem der Systemintegratoren an, die Nvidia AI Enterprise anbieten. Amax, Colfax International, Exxact Corporation und Lambda schließen sich damit einem globalen Ökosystem von Vertriebspartnern an, zu dem auch Axians, Carahsoft Technology Corp., Computacenter, Insight Enterprises, NTT, Presidio, Sirius, Softserve, SVA System Vertrieb Alexander GmbH, TD Synnex, Trace3 und World Wide Technology gehören. Zudem gibt es neue Hardware für die AI-Software-Suite.

Das erste Cisco-System mit entsprechender Zertifizierung ist der Rack-Server „UCS C240 M6“ mit „A100 Tensor Core“-GPUs. Der 2RU-Formfaktor mit zwei Sockeln eignet sich für eine Vielzahl von speicher- und I/O-intensiven Anwendungen wie Big-Data-Analysen, Datenbanken, Zusammenarbeit, Virtualisierung, Konsolidierung und High-Performance-Computing.

Siva Sivakumar, Vice President of Product Management bei Cisco, ergänzt die Information: „Nvidia-zertifizierte Cisco UCS Server, die von `Cisco Intersight´ angetrieben werden, bieten die besten KI-Workload-Erfahrungen auf dem Markt. Die Zertifizierung des Cisco UCS C240 M6 Rack-Servers für AI Enterprise ermöglicht es Kunden, KI mit der gleichen Infrastruktur und Management-Software zu implementieren, die sie in ihrem Rechenzentrum einsetzen.“

Das erste System von Hitachi Vantara, das durch ein Zertifikat bestätigt mit AI Enterprise kompatibel ist, ist der „Advanced Server DS220 G2“ mit A100 Tensor Core GPUs. Der Allzweck-Server mit zwei Prozessoren ist für Leistung und Kapazität optimiert und bietet nach Herstellerangaben ein ausgewogenes Verhältnis von Rechen- und Speicherkapazität mit der Flexibilität, eine breite Palette von Lösungen und Anwendungen zu betreiben.

Dan McConnell, Senior Vice President, Product Management bei Hitachi Vantara, erläutert: „Für viele Unternehmen sind die Kosten ein wichtiger Faktor beim Einsatz neuer Technologien wie KI-gestützte Qualitätskontrolle, Empfehlungssysteme, Chatbots und mehr.“ Die GPU-beschleunigten und zertifizierten „Unified Compute Platform“ (UCP) mit dem Hitachi Server sei ein guter Weg, um kostengünstig eine leistungsstarke KI-fähige Infrastruktur ins Rechenzentren zu integrieren.

On premises oder bare metal

Zu den weiteren Hardware-Anbietern, die die AI-Enterprise Suite von Nvidia unterstützen, gehören Atos, Dell Technologies, Gigabyte, H3C, Hewlett Packard Enterprise, Inspur, Lenovo und Supermicro. Ihre Systeme sind ebenfalls mit A100, „A30“ oder anderen Nividia-GPUs ausgestattet. Kunden können NVIDIA AI Enterprise auch auf ihren eigenen Servern oder auf einer As-a-Service-Bare-Metal-Infrastruktur von Equinix Metal in neun Regionen weltweit einsetzen.

(ID:47948884)

:quality(80)/p7i.vogel.de/wcms/cb/71/cb71e590a7dc308eaba6d56d64b7eb88/0131454836v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/92/69/926957985fcebbb3e065a2faf9c652ea/0131454826v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/23/a2/23a22ca2809e9d56ee77adc7ff357565/0131271145v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/db/65/db659edded4ec36a88aa5f13abf4bbf0/0131318711v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6a/d9/6ad97677dbd05d030c274d5da2ac55fa/0131318196v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/38/be/38be533948e665f81f8dd40af236f0e7/0131491752v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/b8/36b8ba441409b46b71455151dfc60538/0131002266v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e0/98/e09817246d3203a4b491b223997c76dd/0131317840v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a1/dd/a1ddf02ccf707e1002dc9f0b0c41f6cf/0131298906v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/af/21/af21f7761950c841306c223f77f91155/0131423495v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/64/6b/646b6d3886e625484482cb2ad1d2df30/0131318698v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/81/b3/81b359118a0e0e395cdebbddcfa03243/0130668020v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/94/179447f80cab81cfdbadd85c46cc9b72/0131191448v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c6/2b/c62b87f2a390d03996b4db6e3c51b1ee/0131312711v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/49/7a/497af014bb9c80eb964cbd4b170f1af6/0130709118v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/e9/1f/e91fc245c584b6ed72107ab6433bbf9a/0131310055v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/95/6e9529f775612253d132e9002edc3c6f/0131312462v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/04/f3/04f34ccd22d33a964e864e5ad0cc9678/0131308317v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b2/b5/b2b53d801176f1a4e6dbb7e80861d738/0131311098v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/ec/41ecbc8077275d54daf5895ae6f98b6c/0130998245v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/64/e4/64e4be0db6ddc/rittal-4c-w.png)

:fill(fff,0)/p7i.vogel.de/companies/60/de/60ded37a20a00/logo-vertiv.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/66/c3/66c33d1f71ef2/daxten-logo-600-x-600.jpeg)

:quality(80)/p7i.vogel.de/wcms/44/be/44be45ddf15b5beab42c59d0d9356e53/0126385041v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/fc/25/fc2559bf2bf6e27fd6337e354892c4cf/0125255516v1.jpeg)