Vergleichbarkeit in Gefahr oder unsinnige Rangliste? Kritik an Linpack-basiertem Ranking der Top500

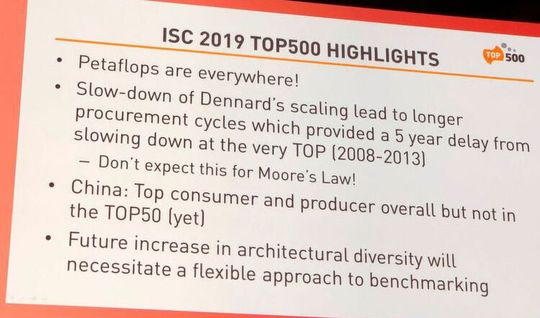

Beim jüngsten „Top500“-Ranking der Supercomputer ist die Messlatte ein nach Ansicht von Experten völlig überholter Benchmark-Test namens Linpack beziehungsweise HPLinpack. Er wird nur noch aus historischen Gründen beibehalten, hat sich aber zuletzt weiterentwickelt. Eine moderne Alternative ist der HPCG-Benchmark-Test.

Anbieter zum Thema

Die jüngste Top500-Rangliste der Supercomputer beruht auf einem Benchmark-Test, dessen Grundlagen schon seit Jahren kritisiert werden. Der Linpack-Test, entwickelt von Jack Dongarra, einem der Macher der Top500-Liste, stammt aus dem Jahr 1979.

Das LINear System PACKage ist eine Fortran-Library zur Lösung linearer Gleichungssysteme. Das Ergebnis wird in Gleitkommaoperationen pro Sekunde (FLOPS, Floating Point Operations per Second) angegeben.

„Der Linpack-Benchmark misst etwas, das man in der heutigen Praxis nicht mehr verwendet, etwas, das man in den achtziger Jahren des vorigen Jahrhunderts verwendete“, merkt Michael Resch, Leiter des Höchstleistungsrechenzentrums Stuttgart (HLRS) an.

Sinnentleerte Rechnerei

Resch weiter: „Bei Linpack hat man gesagt: 'Wir nehmen so ein kleines Gleichungssystem, das voll besetzt ist, und versuchen, auf einfache Weise eine Gleichung durch Vorwärts- und Rückwärts-Elimination zu lösen, bis x ein Ergebnis liefert.' Das ist eine sehr ineffiziente Methode", kritisiert Resch. „Das ist ungefähr so, als würden Sie im Straßenbau sagen: 'Der Benchmark besteht darin, dass zehn Arbeiter mit dem Spaten in der Hand einen Graben von x Metern Länge in der Zeit Y ausheben.'“

Er schimpft weiter: „Das ist super, aber das tut heute keiner mehr; denn heute geht das mit dem kleinen Bagger. Wenn man heute zu den zehn Arbeitern sagen würde: 'Macht das mal mit einer neuen Schaufel', um zu sehen, ob das nicht doch etwas schneller geht, dann spielt das überhaupt keine Rolle mehr.“

Wovon ist die Rede? Der Linpack Benchmark besteht aus drei Teilen:

- 1. Fortran n = 100 Benchmark. Hier wird die Zeit gemessen, die ein Rechner benötigt, um eine voll besetzte 100x100-Matrix zu faktorisieren und ein Gleichungssystem mit Hilfe der Zerlegung zu lösen.

- 2. Linpack n = 1000 Benchmark (TPP/ Toward Peak Performance, Best effort): Hier ist eine 1000x1000 Matrix zu lösen. Der Lösungsalgorithmus (()) kann frei gewählt und in einer beliebigen Sprache implementiert werden

- 3. Linpack’s Highly Parallel Computing (HPC) Benchmark: Die Dimension des voll besetzten Gleichungssystems ist beliebig. Bedingung ist nur, dass eine gültige Lösung mit der vorgegebenen Genauigkeit ermittelt wird, die Rahmenbedingungen sind die gleichen wie in Test 2.

„Man misst immer noch mit Linpack, weil er den Standard in der Top500-Liste darstellt, damit die Messergebnisse vergleichbar bleiben", erläutert Michael Resch. „Man kann dann sagen, dass ein System im Jahr 2019 eine Leistung aufweist, die um den Faktor X höher ist als beispielsweise im Jahr 1995.“ Das sei zwar ein sinnvoller Ansatz, aber für die Fragen 'Ist ein System produktiv?' oder 'Ist ein System im Hinblick auf die Anforderungen leistungsfähig, die wir heute haben?' sollte man seiner Einsachätzung zufolge den Linpack auf keinen Fall heranziehen.

Lapack

Mittlerweile gilt der Linpack-Benchmark als überholt, als Nachfolger gilt LAPACK (Linear Algebra Package), das vor allem für Shared-Memory- und Vektor-Supercomputer geeignet ist und auf diesen auch performanter läuft. Lapack ist eine Programmbibliothek, die Algorithmen aus der numerischen linearen Algebra enthält. Die Bibliothek umfasst effiziente Routinen zur Lösung linearer Gleichungssysteme, linearer Ausgleichsprobleme und von Eigenwertproblemen.

Als Hilfsbibliothek nutzen die Routinen in Lapack für elementare Operationen der linearen Algebra das Softwarepaket Basic Linear Algebra Subprograms (BLAS). In BLAS werden beispielsweise moderne Cache-Techniken effektiv umgesetzt. Portierungen von BLAS können auf neuere oder speziellere Architekturen zugeschnitten werden, deren Vorteile so sofort in Lapack nutzbar werden.

High-Performance Linpack (HPL)

Doch im Hinblick auf die Vergleichbarkeit der Benchmark-Ergebnisse wurde der Linpack-Test gegenüber Lapack bevorzugt, allerdings in einer speziell modifizierten Ausformung als High-Performance Linpack (HPL). Dies ist die moderne Grundlage der Top500-Liste.

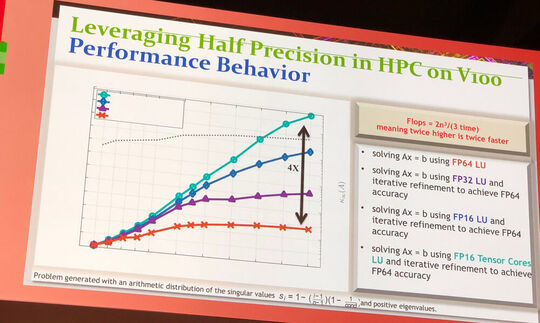

HPL erzeugt, wie gewohnt, ein lineares Gleichungssystem der Ordnung N und lässt damit ein paar trickreiche Dinge anstellen. Der Knackpunkt: Dabei wird relative aufwändige Double-Precision-Mathematik genutzt.

Wer sich aber schon einmal die Leistungsmerkmale einer heutigen GPU angesehen hat, weiß, dass dort auf Single- und sogar Half-Precision-Mathematik umgeschaltet werden kann. Der Vorteil besteht in einer vielfach höheren Ausführungsgeschwindigkeit für die mathematischen Aufgaben. Weil aber in fast allen modernen Supercomputern GPUs verbaut sind, insbesondere bei den führenden Hybridsystemen Summit und Sierra, erscheint Double-Precision mittlerweile als wenig sinnvoll.

„In der Zwischenzeit werden in der klassischen Simulation – wie etwa für Strömungsmechanik - andere Methoden verwendet, die erheblich schneller sind und die auf dem Rechner dann eine andere Effizienz aufweisen“, gibt Resch zu bedenken. „Bei der Teilchensimulation – die stark im Kommen ist - gehen wir sowieso weg vom klassischen Prozessor (CPU) in Richtung Beschleuniger, typischerweise Grafikkarten (GPU).“ Also sind auch FPGAs als Beschleuniger keineswegs aus dem Rennen.

HPL-AI Linpack

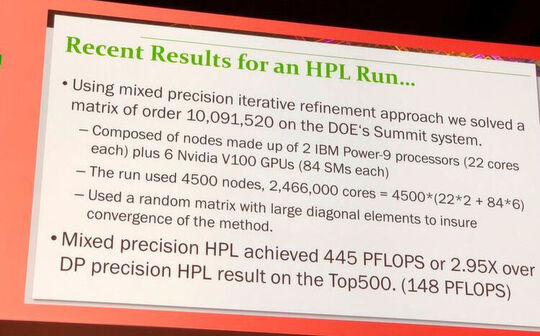

Aufgrund dieser Entwicklung wird in der jüngsten Rangliste vom Juni 2019 ein Benchmark namens HPL-AI angewandt, der auf Mixed-Precision-Mathematik basiert, die in KI-Modellen zur Geltung kommt. Die Ergebnisse: „Summit“ und „Sierra“ sowie ähnliche hybride Systeme schlagen den Rest des Feldes um Längen.

„Mixed-Precision-Techniken", sagte Jack Dongarra, „sind bedeutsamer geworden, was die Verbesserung der Berechnungseffizienz von Supercomputern anbelangt, sowohl im Hinblick auf traditionelle Simulationen mit iterativer Verfeinerung, als auch für KI-Anwendungen.“

Nvidia und die Oak Ridge National Laboratories (ORNL) haben den HPL-AI-Benchmark auf Summit, der Top500-Nummer-eins, getestet. Die 9.216 „IBM Power9“-CPUs und 2.7648 „Nvidia-Volta“-GPUs (die auf ihre Mixed-Precision-Tensor-Core-Fähigkeit zurückgreifen) absolvierten die Testaufgabe in nur einer halben Stunde statt in den 90 Minuten, die sie für den HPL-Test mit Double-Precision gebraucht hatten. Gemessen wurden 445 Petaflops statt bisher 148 Petaflops unter HPL, eine Verdreifachung der Leistung. Nvidia hofft, dass der HPC-AI-Benchmark einen neuen, ergänzenden Standard für das HPC-Feld bilden wird.

HPCG

„Seit den neunziger Jahren gibt es Methoden, die erheblich besser arbeiten“, erläutert Resch. „Inzwischen gibt es etwas Besseres als Linpack, nämlich HPCG.“ Mit dieser komme man dem Ideal sehr nahe, doch sei die Methode noch immer nicht optimal, weil jedes System seine eigene Charakteristik besitze.

Der High Performance Conjugate Gradient-Benchmark (HPCG) wurde von Michael Heroux von den Sandia National Laboratories sowie von Jack Dongarra und Piotr Luszczek von der Universität von Tennessee vorgeschlagen, um die Linpack-Tests zu ergänzen. HPCG ist dafür ausgelegt, die Datenzugriffsmuster realer Anwendungen zu modellieren und auf diese Weise die einschränkenden Effekte des Speichersubsystems und der systeminternen Datenleitungen (Interconnect) eines HPC-Rechners auf seine Rechenleistung zu prüfen.

Weil sich der Datendurchsatz (I/O) wie ein Hemmschuh beziehungsweise Flaschenhals auswirkt, liefern HPCG-Tests im Allgemeinen nur einen Bruchteil der Spitzen-Flop/s-Leistung des jeweiligen Rechners. Seit Juni 2018 hat Summit die Spitzenposition in der HPCG-Rangliste inne, gefolgt von „Sierra“ und dem „K“-Computer (Japan).

(ID:46032489)

:quality(80)/p7i.vogel.de/wcms/9b/71/9b71f0cbf75b2fcdb03b0515f7de85b1/0131546105v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/40/11/4011ec959c9f026bff4c9b26556000b8/0131576135v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ab/da/abda4198eec4667e63121b4038eb9696/0127011549v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/cb/71/cb71e590a7dc308eaba6d56d64b7eb88/0131454836v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8a/e5/8ae5e6328c2f85c5f9e73dab50830070/0131318362v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/6a/d9/6ad97677dbd05d030c274d5da2ac55fa/0131318196v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e2/31/e231589b0fc5261a4d5174e8efde28d9/0131455263v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e0/98/e09817246d3203a4b491b223997c76dd/0131317840v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a1/dd/a1ddf02ccf707e1002dc9f0b0c41f6cf/0131298906v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/af/21/af21f7761950c841306c223f77f91155/0131423495v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/80/6e803451356aedef2f7983857510d019/0131541101v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/94/179447f80cab81cfdbadd85c46cc9b72/0131191448v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c6/2b/c62b87f2a390d03996b4db6e3c51b1ee/0131312711v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/b8/36b8ba441409b46b71455151dfc60538/0131002266v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/49/7a/497af014bb9c80eb964cbd4b170f1af6/0130709118v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/b4/66b480de5d9d98134871015eef2737fe/0131527877v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8f/c0/8fc06e30fbc48da5ff5e068b2a32fc40/0131517134v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e9/1f/e91fc245c584b6ed72107ab6433bbf9a/0131310055v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/95/6e9529f775612253d132e9002edc3c6f/0131312462v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/ec/41ecbc8077275d54daf5895ae6f98b6c/0130998245v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/63/e5/63e5f25ac31ef/logo.png)

:fill(fff,0)/p7i.vogel.de/companies/66/c3/66c33d1f71ef2/daxten-logo-600-x-600.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/6a/03/6a032acb3d1c7/kentix-aa-logo-.png)

:quality(80)/p7i.vogel.de/wcms/05/9b/059bebc5a069f0d28a1e0687adedbbcc/0126955948v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/e8/e7e8b85b5b149134e659fe1e6f6a49c2/0125147881v2.jpeg)