All-Flash ändert alles Erbarmungslos nahe - Der Verzicht auf RAID-Arrays

Die Datenexplosion hält an, der Druck der Echtzeit-Verfügbarkeit wächst. Zum rund 30-jährigen Jubiläum ist bei RAID die Luft raus. Und jetzt?

Anbieter zum Thema

RAID ist tot. Umständliche Einrichtung, starre Konfiguration, teure Upgrades, überlange Rebuild-Zeiten: Der Verzicht auf RAID war jahrelang in der Mache. Jetzt ist es endlich soweit.

Das jähe Ende von RAID wurde von Branchen-Insidern bis zur Ermüdung gepredigt. Es hieß, die immer komplexeren RAID-Level —RAID-5, RAID-6, bald auch RAID-7.N — würden das Ableben der Technologie besiegeln. Denn die HDDs würden immer größer, die Rebuild-Times immer länger und so müssten die betroffenen RAID-Arrays im Ernstfall viel zu lange quasi mit angezogener Handbremse im „Degraded Mode“ unproduktiv vor sich hin werkeln.

Doch Totgesagte leben offenbar länger. Mit dem Einzug von All-Flash-Storage ins Rechenzentrum entfiel auf einmal die einst wichtigste Begründung für die trüben Unkenrufe zum Untergang von RAID: die lahme Schreib- und Lese-Performance von HDDs. Mit Flash-Storage sollte auf einmal alles besser werden.

Herkömmliches RAID versagt

Doch die Inflexibilität konventioneller RAID-Arrays lässt sich durch den bloßen Austausch von HDDs zugunsten von SSDs nicht aufheben. Ganz im Gegenteil: Bei der Umsetzung von hochperformanten und langlebigen All-Flash-Arrays versagt herkömmliche RAID-Technologie kläglich. Eine der wichtigsten Ursachen dafür liegt in der beschränkten Lebensdauer von NAND-Speicher, die sich in einer festen maximalen Anzahl von physischen Schreibvorgängen reflektiert.

Es gilt, die Anzahl von Schreibzugriffen zu minimieren und eine ausgewogene Verteilung der Schreiblast über alle Medien hinweg sicherzustellen, um eine gleichmäßige Abnutzung zu gewährleisten. Gängige Verfahren beinhalten Nullblockerkennung, Datendeduplikation und -Kompression, Thin Provisioning und den Abnutzungsausgleich auf NAND-Ebene.

Software definiertes Storage verträgt sich nicht mit der relativ starren Unveränderlichkeit konventioneller RAID-Arrays. Und doch liefern noble Anbieter wie Fujitsu (in „Eternus“), Dell EMC (in Produkten der „VMAX“-, „Unity“- und „SC“-Reihe) oder „Hitachi Vantara“ (mit der „F“-Serie und einer Garantie auf 100 Prozent Datenverfügbarkeit) konventionelle RAID-Arrays für gutes Geld.

Gibt’s denn nichts Besseres?

Softwaregesteuerte Flash-Arrays mit NVMe

In der Vergangenheit basierten die meisten Storage-Systeme der Enterprise-Klasse auf einem Scale-up-Modell mit zwei Controllern (so hat seinerzeit auch Pure Storage angefangen). In den letzten Jahren sind neue Architekturen entstanden, darunter Scale-Out, Software-Defined, konvergente und hyperkonvergente Infrastrukturen usw. Diese neuen Storage-Konzepte bieten Vorteile für hochskalierbare NGA-Workloads (Next-Generation Applications), die bei Dual-Controller-Designs schnell ins Stottern geraten würden.

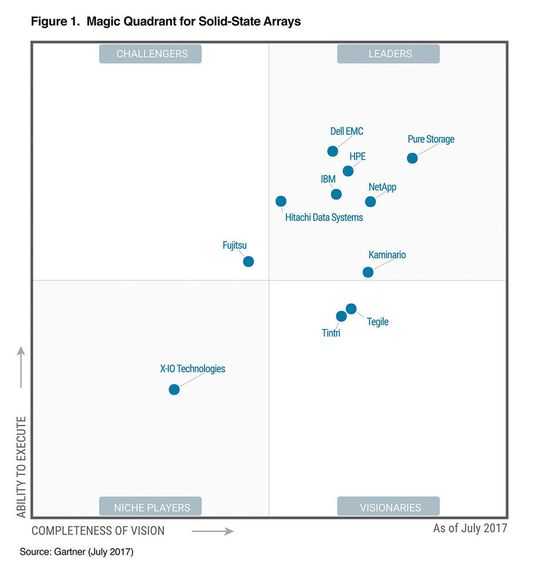

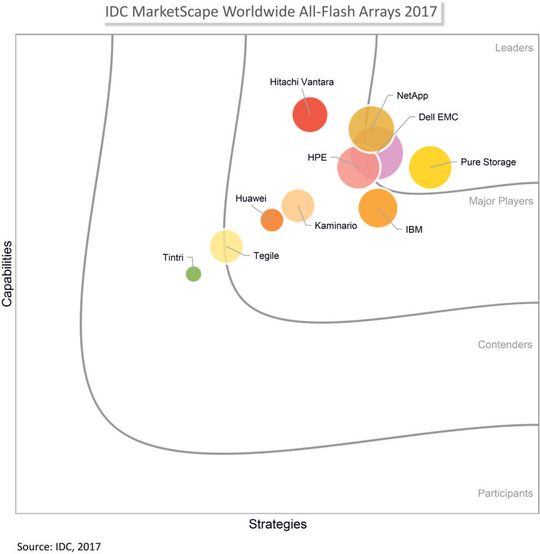

Im Magic Quadrant for Solid-State Arrays listet das Gartner-Institut als aktuelle Marktführer in erster Linie die Anbieter Pure Storage, Dell EMC, HPE und NetApp, gefolgt von IBM, Hitachi Data Systems und Kaminario. Auch IDC hat Pure Storage im Dezember 2017 die Technologieführerschaft bescheinigt („IDC Market Scape: Worldwide All-Flash Array 2017 Vendor Assessment“).

Bei Pure Storage

Pure Storage bietet mit „Flash Array“ eine Produktlinie für den Blockspeicher latenzsensitiver Anwendungen wie VM-Volumes. Die eigene Lösung für den Datei- und Objektspeicher taufte der Anbieter auf den Namen „Flash Blade“ und schrieb sich dabei massive Parallelisierbarkeit auf die Fahnen.

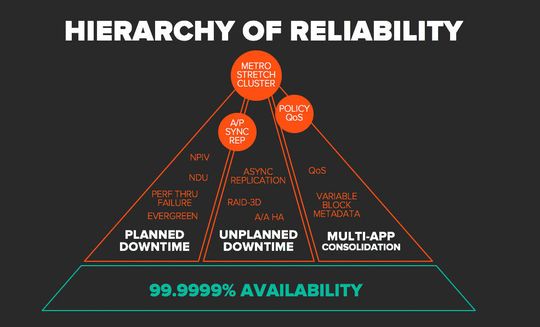

Die Flash-Array-Produktfamilie nutzt ein proprietäres RAID namens Raid 3D mit „Direct Flash“ auf NVMe-Basis oder Flash-SAS. Bei NVMe (NVM Express oder Non-Volatile Memory Host Controller Interface Specification, kurz: NVMHCIS) handelt es sich um eine offene logische Geräteschnittstellenspezifikation für den direkten Zugriff auf nichtflüchtige Speichermedien über PCIe (einen PCI Express-Bus).

„Flash Array //X“, die High-End-Edition der Produktfamilie, stellt das weltweit erste Storage-System mit direktem Zugriff auf Flash-Arrays (Direct Flash) dar.

„Purity“ (kurz POE für Purity Operating Environment), die Betriebsumgebung von Pure Storage, hebt sich durch ihre native Unterstützung von NVMe hervor. Direkter Speicherzugriff der CPU auf Flash-Speicher via NVMe fördert durch den Verzicht auf Altlasten-Protokolle mit latenzlastigem Overhead und durch die native Parallelisierung von Zugriffen auf Flash eine präzedenzlose Leistung zu Tage.

HDD-Emulation ist ineffizient

Konventioneller SSD-Speicher erfordert nach wie vor serielle Altlasten-Technologien wie den NFS-Stack, SAS und SATA; SSDs werden hierbei mit Hilfe einer HDD-Emulation angesteuert. Wer diesen Ballast noch mit schleppt darf sich auch über Latenz nicht wundern.

Die HDD-Emulation erzwingt nämlich nicht nur eine ineffiziente Blockspeichernutzung, sondern auch noch teure Überprovisionierung auf Grund von zusätzlichen Platzanforderungen für Garbage Collection. Flash Array //M unterstützt neben Direct Flash im Übrigen aus Gründen der Kompatibilität unter anderem auch SAS- und SATA-Medien im HDD-Emulationsmodus.

„Flash Array //M“, die Upgrade-fähige Einstiegslösung der Flash-Array-Serie, basiert auf dem üblichen Zwei-Knoten-Controller-Modell mit einem signifikanten Unterschied gegenüber Lösungen der Mitbewerber. Der NVRAM, welcher die Schreibvorgänge mit geringer Latenz bestätigen und Dienste wie die adaptive Datenreduktion ermöglichen soll, befindet sich in den ersten beiden Speicherschachteln und nicht in den Speicher-Kontrollern. Durch die Verlagerung von NVRAM in die persistente Speicherschicht (Flash-SSD) gelang es Pure Storage, eine zustandslose Speicher-Controller-Architektur zu konstruieren.

Im Evergreen Storage-Upgradeprogramm von Pure Storage lässt sich FlashArray //M nicht-disruptiv auf //X aufrüsten: durch den bloßen Austausch der Controller, ein kostenfreies Upgrade von Purity und den Einschub der Direct-Flash-Module. Mit dem Upgrade entfällt die HDD-Emulation und damit erübrigt sich wiederum die latenzlastige Flash-Translation, da Purity jetzt den Speicher von Direct Flash über die neuen Kontroller nativ ansteuert.

Die Blockzuordnung

Sämtliche Garbage-Collection, den Abnutzungsausgleich (wear leveling), die Blockzuordnung (block allocation), die Flash-Translation (beim Einsatz von SAS- und SATA-Medien im HDD-Emulationsmodus) und dergleichen andere Aufgaben handhabt Purity global in Software statt auf Geräte-Ebene. Die hohe Effizienz dieser Implementierung ermöglicht niedrige Latenzen in stark konsolidierten Umgebungen. Als Resultat eines Upgrades auf Direct Flash mit NVMe halbiert sich die Latenz, verdoppelt sich die Bandbreite und vervierfacht sich die Gesamtleistungsdichte eines FlashArrays (beim Einsatz von 10 Modulen).

Im vergangenen Dezember hat Purity Storage ein aktiv/aktiv Metro-Stretched-Cluster namens „Active Cluster“ auf der Basis von Flash Array vorgestellt. Anwender von FlashArray //M kommen in den Genuss dieser Lösung mit einem kostenlosen Upgrade.

Der Flash- Stack

Flash Blade nutzt CFM-Speicher (Cooperative Flash Management, die so genannten DirectFlash Modules). Avisierte Anwendungen beinhalten Big Data-Analytics, unter anderem für unstrukturierte Daten aus IoT- und Web-Anwendungen, HPC und Backups. Laut IDC stelle das Produkt „die erste wirklich flash-optimierte Big-Data-Analyseplattform der Branche“ dar.

Pure Storage hat außerdem in Zusammenarbeit mit Cisco eine konvergente Infrastruktur namens „Flash Stack“ entwickelt.

Die Plattform von Pure Storage verwaltet sich mit prädiktiver Intelligenz auf der Basis der hauseigenen KI-Engine Pure1 Meta für „selbstfahrenden Speicher“. Intelligente Software ist offenbar das Geheimrezept für robusten und flotten Flash-Speicher ohne eine HDD-Emulation und ohne RAID-Controller.

Nachholbedarf bei All-Flash-Arrays und alternative Ansätze

Dell EMC stellte die erste Generation der eigenen SC-Storage-Arrays für All-Flash gerade mal im Herbst des vergangenen Jahres vor. Zuvor war die Reihe (das Resultat der Übernahme von Compellent) für hybride Medien ausgelegt.

In der All-Flash-Ausführung liefern die Arrays bis zu 399,000 Eingabe-/Ausgabeoperationen pro Sekunde (IOPS) und bis zu 10fach mehr pro 10x-Cluster. „SC5020F“ skaliert auf 222-Drives und 2 Petabyte (PB), „SC7020F“ auf 500-Drives und 3 PB. Beide diese Lösungen haben jedoch einen entscheidenden Nachteil: das völlige Fehlen von NVMe-Unterstützung in jeglicher Form. Auch Dells Unity-Storage-Arrays kommen in einer hybriden und in einer All-Flash-Ausführung daher — ebenfalls ohne eine NVMe-Option.

„XtremIO X2 Data Protection“ (XDP) von Dell EMC ist nichts anderes als eine modifizierte RAID-6-Variante mit diagonaler Parität.

Auch HPE hat versucht, das eigene Storage-Portfolio im Zuge von mehreren Akquisitionen zu modernisieren. Mit Simplivity erwarb der Anbieter eine Technologieplattform für hyperkonvergente Infrastrukturen in der preislichen Mittelklasse. Mit der Übernahme von Nimble Storage stockte HPE das eigene Portfolio mit einer Alternative zur 3PAR-Reihe auf und bietet nun auch Storage-Lösungen der Mittelklasse mit einem Fokus auf All-Flash-Arrays an.

Die HPE-Simplivity-Plattform nutzt FPGA-Beschleuniger (Field Programmable Gate Arrays) zur Gewährleistung einer vorhersehbaren Leistung bei kontinuierlicher Deduplikation und Datenkompression auf Flash. Bei Nimble Storage handelt es sich um prädiktive All-Flash-Arrays auf der Basis von „Infosight“, einer prädiktiven Analytics-Plattform von HPE. Infosight kann laut dem Anbieter bis zu 86 Prozent der auftretenden Probleme automatisch erkennen und beseitigen.

Netapp arbeitet sich durch die Übergangsphase von RAID zu softwaregetriebenen Arrays auch vorsichtig durch. Die All-Flash-Arrays der „AFF-A-Serie“ von Netapp (All-Flash FAS mit SAN über FC oder iSCSI) basieren noch auf RAID DP, einer hauseigenen Implementierung von RAID 6, und auf RAID TEC, einem Feature von Netapps proprietärer Betriebsumgebung „Data Ontap“.

RAID TEC (kurz für Triple Erasure Coding) stellt eine dritte Paritätsdisk bereit. In den Flash-Arrays der EF-Serie verwendet der Anbieter die Raid-Level 0, 1, 5, 6 und 10 mit dynamischer RAID-Level-Migration. In SolidFire-Arrays kommt bereits Netapps eigene, „RAID-lose“ selbstheilende Datenschutztechnologie „Helix“ für verteilte Datenreplikation zum Zuge. Der Helix-Algorithmus sichert mehrere Kopien der Daten über die Knoten des Cluster hinweg.

Softwaregetrieben, aber in Hardware beschleunigt

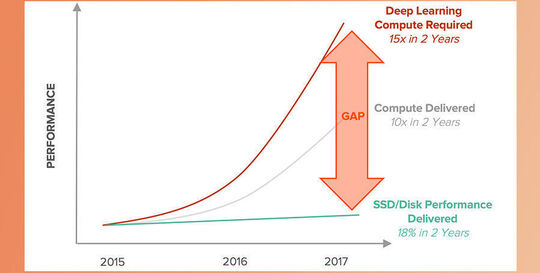

Eine Zeitlang wurde Flash für die Verwendung mit unternehmenskritischen, latenzempfindlichen Primärsystemen verwendet und zwar in Workloads, bei denen eine bessere Leistung direkt zu einem besseren Geschäftsergebnis führte. Da jedoch die Kosten für Flash-Storage weiter gesunken sind, ist nun sogar die Verwendung von Flash mit weniger latenzempfindlichen Arbeitslasten aufgrund der sekundären wirtschaftlichen Vorteile von Flash ökonomisch sinnvoll.

Der geringere Energieverbrauch und Platzbedarf erlauben eine höhere Infrastrukturdichte. Die Verwendung von Flash für unstrukturierte Daten erweitert das Spektrum der möglichen Workloads, denn diese waren traditionell (auf Grund technischer Beschränkungen der HDD-Emulation) auf blockbasierte Workloads beschränkt.

Die Verwirrung rund um den Untergang von RAID ist durch eine Inflation von unpräzisen und oft übermäßig vereinfachten Buzzwords verursacht, die von Marketing-Fachleuten in den Markt gepusht und dann von Fachkräften in Datencentern ausgebadet werden müssen. So unterscheiden sich die beiden Begriffe „Storage Virtualization“ und softwaredefinierter Speicher (Software Defined Storage, kurz: SDS) in nur so wenigen Feinheiten, dass sie Missverständnisse verursachen.

Bei SDS ist von einem Software-Layer der Rede, der auf existierende Datacenter-Storage-Ressourcen aufgebracht wird und eine erweiterte Storage-Funktionalität ermöglicht. Der Begriff Storage Virtualization bezieht sich hingegen auf ein Pool von physikalischen und/oder virtuellen Storage-Ressourcen, die sich wie ein größeres Gerät verwenden lassen.

Die Zukunft

Wer die Storage abstrahieren möchte, kann entweder Software Defined Storage oder Storage Virtualization nutzen — mit unterschiedlichen Konsequenzen.

Bei der Storage Virtualization geht es primär darum, größere Datenmengen handhaben zu können. Das Hauptziel der SDS ist die Integration von Storage-Ressourcen mit gleichzeitiger Performancesteigerung. Daten-Redundanz ist durch SDS nicht explizit abgedeckt.

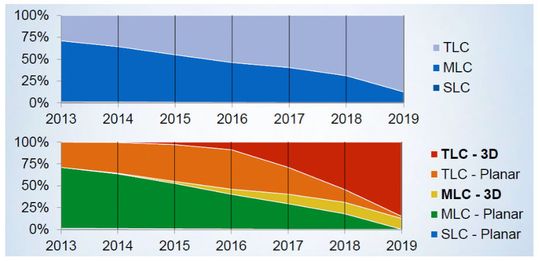

Laut einem aktuellen Bericht von Gartner soll bis zum Jahre 2021 jedes zweite Datencenter (50 Proznt) für HPC- und Big-Data-Workloads Solid-State-Arrays (SSAs) einsetzen. Letztes Jahr (2017) war es laut Gartner lediglich jedes zehnte Datencenter (10 Prozent). SSD-Anbieter wie Samsung haben bereits angedeutet, dass sowohl die Kapazität von Medien in 3D TLC NAND-Technologie als auch die Kosten für Speicher in aktiver Nutzung (im Gegensatz zum Archiv-Speicher) bald mit HDDs gleichziehen sollen.

*Das Autorenduo

Die Autoren des Artikels, Anna Kobylinska und Filipe Pereira Martins arbeiten für McKinley Denali Inc. (USA).

(ID:45618534)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b7/51/b7517d2828afce2eed6c60c8f4b15e08/0131193094v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a0/74/a074b1b682c5af4985ac6db2f521efcd/0131131347v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a5/db/a5db7775305378d9d405e13e60f5e2f8/0130996707v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ef/d6/efd67bbf37bf217b7fb376c5b6cea3f2/0131214575v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9d/3d/9d3db3d58b3a3b6b1a07a4b5eae428d5/0131238283v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b0/20/b020a96ad0479586bce92b4e0be8c5b1/0131172866v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/05/6e0551963ade522e815e481b0866df59/0131270766v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/fc/91/fc91634cab380f053be693356d88ab11/0131193486v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/89/97/899791db276100161ea76f79dd649245/0131131469v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/03/53/03531922dce111ec6fa5b65684d9ea1c/0131055174v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/81/b3/81b359118a0e0e395cdebbddcfa03243/0130668020v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/94/179447f80cab81cfdbadd85c46cc9b72/0131191448v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/49/7a/497af014bb9c80eb964cbd4b170f1af6/0130709118v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/8a/ba/8abadeb121d645fdb8fb5a68d6a4c9b8/0130541481v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/8b/64/8b64e9369f05a2b07bfa2c76e53819be/0131210510v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0c/ec/0cecbad201eb5d74f1ea8f9ec3a4f7a0/0128040845v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8e/1f/8e1f9fa0a40402c37826489eb3bff4a6/0131226935v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/04/58/0458d319fcf6c748ac43aef05ffee535/0131244622v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/ec/41ecbc8077275d54daf5895ae6f98b6c/0130998245v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/00/24/0024808d38d25431ae2719d3f8252908/0130726727v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/6a/03/6a032acb3d1c7/kentix-aa-logo-.png)

:fill(fff,0)/p7i.vogel.de/companies/67/92/67921e1a932db/logo-pqplus---rgb.jpeg)

:quality(80)/p7i.vogel.de/wcms/4a/99/4a99d1e657e57f8d586cc19e60b1824f/0130060276v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b6/b8/b6b861346b607b7ecc0b60dc45c46012/0129449658v1.jpeg)