Beschleunigung mit mehr Leistung und mehr Sicherheit Nvidia-GPUs überzeugen Hardware-Anbieter und HPC-User

Nvidia nutzt die seit gestern virtuell stattfindende Internationale Supercomputing-Konferenz „ISC 20“ für drei Ankündigungen: Partner-Hardware, die mit der „Ampere-100“-Technik ausgestattet werden soll, die Sicherheitssoftware „Mellanox UFM Cyber-AI“, die insbesondere die Security in HPC-Umgebungen beziehungsweise Supercomputern erhöht, und den Rekord bei einem bedeutenden Big-Data-Analytics-Benchmark.

Anbieter zum Thema

Im vergangenen Monat hatte Nvidia mit „Ampere“ eine neue Architektur für Graphics Processing Units (GPUs) vorgestellt. Jetzt haben mehr als 50 HardwarepartnerSysteme mit dem Prozessor „A100“ angekündigt, darunter Asus, Atos, Cisco, Dell Technologies, Fujitsu, Gigabyte, Hewlett Packard Enterprise, Inspur, Lenovo, One Stop Systems, Quanta/QCT und Supermicro. Davon sollen 30 Systeme bereits in diesem Sommer zur Verfügung stehen, 20 weitere werden bis zum Endes dieses Jahres erwartet.

Ian Buck, Vice President und General Manager für Accelerated Computing bei Nvidia, zeigt sich begeistert: „Die Aufnahme von A100-GPUs in die Angebote führender Serverhersteller übertrifft alles, was wir bisher gesehen haben. Die schiere Vielfalt der Nvidia A100 Server unserer Partner stellt sicher, dass Kunden die besten Optionen zur Beschleunigung ihrer Rechenzentren wählen können, um eine hohe Auslastung und niedrige Gesamtbetriebskosten zu erzielen.“

Die Server lassen allesamt große Leistungssprünge erwarten: So kann der Prozessor A100 die Leistung im Vergleich zum Vorgängermodell „Volta“ um bis zu 20x steigern. Darüber hinaus punktet er mit weiteren technischen Neuerungen, darunter eine Multi-Instanz-Grafikprozessortechnologie, die es ermöglicht, einen einzelnen A100 in bis zu sieben separate Grafikprozessoren zu partitionieren, um unterschiedliche Rechenaufgaben zu bewältigen. Die dritte Generation der Nvidia-Technik „NVLink“ ermöglicht es zudem, mehrere Grafikprozessoren zu einem einzigen Grafikprozessor zusammenzufügen, und die neue strukturelle Sparsamkeitsfunktionen kann die Leistung eines Grafikprozessors verdoppeln (siehe: „Trennung von Intel-CPUs in den KI-Computern und massive Leistungssteigerung, Das technisch Machbare - Nvidia stellt Ampere-GPU vor“).

:quality(80)/images.vogel.de/vogelonline/bdb/1706300/1706388/original.jpg)

Trennung von Intel-CPUs in den KI-Computern und massive Leistungssteigerung

Das technisch Machbare - Nvidia stellt Ampere-GPU vor

Erleichtert wird die Vielfalt der zu erwartenden Serversysteme durch den PCIe-Formfaktor für den A100, den NVIDIA jetzt vorgestellt. Er ergänzt die im Mai eingeführten Vier- und Achtwege-Konfigurationen des „Nvidia HGX A100“.

Die PCIe-Version ermöglicht es Serverherstellern, Rechner anzubieten, die mit einem einzelnen A100-Grafikprozessor ausgestattet sind, aber auch Servern mit 10 oder mehr Grafikprozessoren. Diese Systeme beschleunigen eine breite Palette rechenintensiver Arbeitslasten, von der Simulation des molekularen Verhaltens für die Arzneimittelentdeckung bis hin zur Erstellung besserer Finanzmodelle für Hypothekengenehmigungen.

Mehr Sicherheit für Supercomputer

Es geschah am 11. Mai 2020: Mindestens ein Dutzend Supercomputer in ganz Europa wurden abgeschaltet, nachdem versucht worden war, die Maschinen durch Cyber-Angriffe unter Kontrolle zu bringen, um sie für Krypto-Mining, speziell „Monero“, zu nutzen. Einen der Angriffe traf das System „Archer“ von der Universität Edinburgh, die Kurz vorher hatten die Mitarbeiter offenbar ein Pandemie-Modellierungs-Tool installiert.

Ebenfalls am 11. Mai legte ein weiterer Anschlag fünf Supercomputer in Deutschland lahm. Betroffen war das Baden-Württembergische Höchstleistungsrechenzentrum und sah sich veranlasst, fünf seiner Cluster offline zu schalten. Am darauffolgenden Donnerstag gab das Leibniz-Rechenzentrum bekannt, dass es den Zugang vorübergehend sperren werde. Das Jülicher Supercomputing Centre schloss sich dem an und nahm seine Systeme „Jureca“, „Judac“ und „Juwels“ vom Netz. Insgesamt sollen neun deutsche Supercomputer den Angriffen zum Opfer gefallen sein

Betroffen waren auch das Schweizerische Nationale Höchstleistungsrechenzentrum in der Schweiz (CSCS) und in Barcelona. Darüber hinaus berichtete das Computer Security Incident Response Team (EGI-CSIRT), der Organisation European Grid Infrastructure (EGI), dass es auch in China und Nordamerika Opfer gegeben habe. Die Angreifer nutzten eine Secure Shell (SSH)-Verbindung aus, über die sich akademische Forscher per Fernzugriff in das System einloggen können.

Hilfe für Infiniband-Cluster

Der Kern des Problems für die HPC-Cluster ist klar. Die Forschungsinstitute benötigen Rechen-Power ohne Ende, an Online-Transaktionen wie ein Web-Shop mit einem erhöhten Malware-Abwehr ist der Betrieb nicht angepasst. Doch Forschungsnetze wie die durch COVID19-geschaffenen, zeigen, dass die Cluster anfällig sein können.

Das will Nvidia mit seiner Security-Software „Mellanox UFM Cyber-AI“ angehen. Sie ist gedacht für Inifinband-Rechenzentren und nutzt Künstliche Intelligenz um Bedrohungen zu erkennen und um Netzwerkausfällen vorzubeugen. Die Algorithmen erfassen Betriebskadenz und Netzwerkauslastungsmuster und ziehen dabei Echtzeit- sowie historische Telemetrie- und Auslastungsdaten heran.

Es ergibt sich ein „Normalzustand“. Abweichungen, die sich aus dem Monitoring des Systemzustands und anhand von Netzwerkmodifikationen dokumentieren, lassen Leistungseinbußen, Auslastung und Profiländerungen erkennen. Die Software gibt Warnmeldungen bei anormalem System- und Anwendungsverhalten sowie bei potenziellen Systemausfällen und Bedrohungen aus und führt Korrekturmaßnahmen durch.

Sie ist auch darauf ausgerichtet, Sicherheitswarnungen bei versuchtem System-Hacking zu liefern, um unerwünschte Anwendungen, wie das berichtetet Cryptocurrency Mining, zu erkennen. Das Ergebnis ist eine verringerte Ausfallzeit des Rechenzentrums, die laut Untersuchungen des ITIC in der Regel mehr als 300.000 Dollar pro Stunde kostet.

Benchmark-Rekord

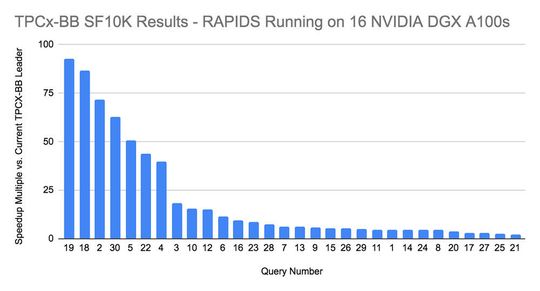

Nvidia hat den bisherigen Rekord für die Durchführung des Standard-Benchmarks für große Datenanalysen, bekannt als TPCx-BB, um fast das 20-fache übertroffen. Eine solche Messung ist in der Vergangenheit nur auf CPU-Systemen erfolgt. Der Daten-Benchmark bildet reale ETL-Funktionen ab: Extrahieren, Transformieren, Laden sowie Machine-Learning-Workflows. Die 30 Abfragen des Benchmarks umfassen große Anwendungsfälle der Datenanalyse wie Bestands-Management, Preis- und Verkaufsanalyse, Empfehlungssysteme, Kundensegmentierung sowie Stimmungsanalyse.

Zur Anwendung für die Datenverarbeitung und das maschinelle Lernen sind die „Rapids-Suite“, „Dask“ für die horizontale Skalierung und „UCX“ Open-Source-Bibliotheken für die ultraschnelle Kommunikation gekommen. Die Software läuft auf 16 „DGX“-Systemen, die mit A100-GPUs ausgestattet sind.

Die DGX A100-Systeme können auf einer einzigen, Software-definierten Plattform Analysen, KI-Schulungen und Schlussfolgerungen rechnen. Sie sind mit A100 Tensor Core-Grafikprozessoren und Mellanox-Netzwerken ausgestattet.

Den Benchmark hat Nvidia in 14,5 Minuten durchgezogen, verglichen mit dem derzeit führenden Ergebnis von 4,7 Stunden auf einem CPU-System ist das schnell. Die Nvidia-Rechner hatten insgesamt 128 A100-GPUs an Bord und nutzten Mellanox-Netzwerke.

Artikelfiles und Artikellinks

(ID:46664702)

:quality(80)/p7i.vogel.de/wcms/cb/71/cb71e590a7dc308eaba6d56d64b7eb88/0131454836v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/92/69/926957985fcebbb3e065a2faf9c652ea/0131454826v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/23/a2/23a22ca2809e9d56ee77adc7ff357565/0131271145v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/db/65/db659edded4ec36a88aa5f13abf4bbf0/0131318711v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/38/be/38be533948e665f81f8dd40af236f0e7/0131491752v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/b8/36b8ba441409b46b71455151dfc60538/0131002266v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/09/03/09035e7bbac6cadc0b1f21818144194f/0131423113v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e0/98/e09817246d3203a4b491b223997c76dd/0131317840v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a1/dd/a1ddf02ccf707e1002dc9f0b0c41f6cf/0131298906v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/af/21/af21f7761950c841306c223f77f91155/0131423495v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/64/6b/646b6d3886e625484482cb2ad1d2df30/0131318698v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/81/b3/81b359118a0e0e395cdebbddcfa03243/0130668020v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/94/179447f80cab81cfdbadd85c46cc9b72/0131191448v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c6/2b/c62b87f2a390d03996b4db6e3c51b1ee/0131312711v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/49/7a/497af014bb9c80eb964cbd4b170f1af6/0130709118v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/e9/1f/e91fc245c584b6ed72107ab6433bbf9a/0131310055v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/95/6e9529f775612253d132e9002edc3c6f/0131312462v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/04/f3/04f34ccd22d33a964e864e5ad0cc9678/0131308317v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b2/b5/b2b53d801176f1a4e6dbb7e80861d738/0131311098v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/ec/41ecbc8077275d54daf5895ae6f98b6c/0130998245v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/64/e4/64e4be0db6ddc/rittal-4c-w.png)

:fill(fff,0)/p7i.vogel.de/companies/60/de/60ded37a20a00/logo-vertiv.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/66/c3/66c33d1f71ef2/daxten-logo-600-x-600.jpeg)

:quality(80)/p7i.vogel.de/wcms/4b/6f/4b6f8cc555057a3956ca108724ce750d/0125785083v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/a3/e7a33a9e3bfaf75c312f941bbb0e481d/0129831734v1.jpeg)