Wasser auf Intel-CPUs und Nvidia-GPUs Lenovo liefert HPC-Cluster an die Max-Planck-Gesellschaft und das KIT

Gestern hat Nividia (s.u.) seine jüngste Generation von Graphical Processing Units (GPUs) vorgestellt und zahlreiche Hardwaresteller kündigen nun Systeme mit den leistungsfähigen Akzeleratoren an. Lenovo kann darüber hinaus auf Kunden dafür verweisen und auf eine Zusammenarbeit mit Nvidia, die es ermöglicht, nicht nur die CPUs in den künftigen Hochleistungs-Cluster im Karlsruher Institut of Technology (KIT) und der Max-Planck-Gesellschaft per Wasser zu kühlen, sondern auch die GPUs.

Anbieter zum Thema

Die Max-Planck-Gesellschaft hat quasi vor Augen, welche Vorteile ein wassergekühlter Supercomputer bietet: Das Leibniz-Rechenzentrum (LRZ) der Bayerischen Akademie der Wissenschaften in Garching betreibt in Sichtweite das Cluster „SuperMUC-NG“, das auf „Lenovo-Neptune“-Technik basiert.

Mitte Februar haben die Lenovo Datacenter Group und die Max-Planck-Gesellschaft zur Förderung der Wissenschaften e.V. einen Vertrag zur Lieferung eines neuen Hochleistungsrechners für die Max-Planck-Gesellschaft unterzeichnet. Der Supercomputer wird in Garching installiert und von der Max Planck Computing and Data Facility (MPCDF) betrieben.

Das Projekt umfasst neben der Lieferung der Kühlungsinfrastruktur, der Hardware und der Software auch die Unterstützung des Betriebs sowie umfangreiche Serviceleistungen, auch vor Ort, durch Lenovo-Mitarbeiter. Dazu gehört etwa die Unterstützung beim Betrieb und bei der Instandhaltung, einschließlich Applikations-Unterstützung. Die Umsetzung des 20 Millionen Euro Projekts beginnt noch im Mai 2020. Die Inbetriebnahme des finalen Systems ist für Anfang des kommenden Jahres geplant.

Das Gesamtpaket

Hermann Lederer von der MPCDF, sagt: „Beeindruckend ist die Kombination aus hoher Leistungsfähigkeit des Gesamtsystems bei hoher Energie-Effizienz und hoher Kompaktheit, direkter Wasserkühlung, geringen Stellplatz- und Infrastrukturanforderungen und attraktiven Serviceleistungen sowohl bei der Systembetreuung wie bei der Anwendungsunterstützung.“

Der Kunde zählt zu den bedeutendsten Forschungseinrichtungen weltweit. An 86 Max-Planck-Instituten und Einrichtungen wird Grundlagenforschung in den Bereichen Natur-, Bio-, Geistes- und Sozialwissenschaften im Dienst der Allgemeinheit betrieben. Die Max Planck Computing and Data Facility (MPCDF) ist ein institutsübergreifendes Kompetenzzentrum der Max-Planck-Gesellschaft zur Unterstützung der Computer- und Datenwissenschaften.

Der geplante Supercomputer von Lenovo soll seine Rechenleistung für verschiedene Max-Planck-Institute zur Verfügung stellen. Er soll die vorhandene Rechenkapazität des seit 2018 installierten Hochleistungsrechnerkomplexes mit einer aggregierten Peak-Leistung von 12 PetaFlop pro Sekunde deutlich erhöhen. Das Lenovo-System wird mit seinen mehr als 100.000 Rechenkernen und Akzeleratoren die Spitzenforschung unterstützen und beschleunigen.

Dicht gepackt und heiß gekühlt

Geplant ist rund 10 Prozent der Knoten mit GPUs auszustatten, und zwar vom gestern angekündigten Typ „Nvidia Tesla A100“. Laut Andreas Thomasch, Director HPC and AI DACH der Lenovo Datacenter Group, erläutert man könne allerdings die Knoten noch dichter bestücken als Nvidia selbst es mit seinem „GDX“-System könne. „Wir packen 4 GPUs in einen unserer Knoten plus einen mit zwei CPUs.“

Das gilt zumindest für ein wassergekühltes System; denn grundsätzlich gibt es die HPC-Rechner des Herstellers auch luftgekühlt. Doch die Max-Planck-Gesellschaft hat sich für ihren neuen HPC-Cluster, anders als beim Vorgängermodell für Wasserkühlung entschieden, und zwar zweistufig.

In der ersten Stufe werden alle wesentlichen Komponenten der Boards über Kupferleitungen direkt gekühlt. Die zweite Stufe kühlt zusätzlich die gesamten Racks über den „Lenovo Rear Door Heat Exchanger“ also über wassergekühlte Türen, um die so genannte Konvektionsabwärme zu 100 Prozent in Wasser abzuführen. Die Prozessoren können in dem für sie optimalen Betriebspunkt arbeiten.

Das zweistufige Kühlkonzept steigert die Energie-Effizienz deutlich. Denn es wird keine Wärme in die Umgebungsluft des Rechenzentrums abgegeben, was wiederum zu geringeren Aufwänden bei der Kühlung des Rechenzentrums führt.

Es besteht aus vier Komponenten:

- Eine Kontrollsoftware sorgt für eine dynamische Anpassung an die beziehungsweise der CPU und das sorgt für eine Minimierung des Stromverbrauchs.

- Das eigentliche Thermal Transfer Module erlaubt eine 24prozentige Erhöhung der Prozessleistung gegenüber luftgekühlten Systemen. Lenovo kommt bei Berechnungen auf einen Betrag von rund 2.100 Dollar pro Jahr und Rack, die sich einsparen lassen.

- Die Direktkühlung von CPU und GPU ermöglicht noch einmal eine Steigerung der Prozess- beziehungsweise Prozessorleistung um 45 Prozent im Vergleich zu luftgekühlten Systemen, was Einsparungen von 40 Prozent bei den Stromkosten bedeute.

- Nach Lenovo-Angaben sorgen die Rückkühler in den Rack-Türen noch einmal für die 3.5fache Effizienz gegenüber ausschließlich luftgekühlten Systemen. Mit der Hitze, die entzogen wird, könnte umgewandelt in Strom rund 4.000 LED-Lichter erstrahlen lassen.

Nach Lenovo-Angaben hat die Installation des HPC-Cluster bei der Max Planck Gesellschaft nach ersten Vorarbeiten im März mit der Installation der Kühlungsinfrastruktur bereits begonnen. Im Juli dieses Jahres soll das erste Teilsystem in Betrieb gehen. Anfang 2021 wird das System mit aktuellen Intel-CPUs und den A100-GPUs ausgestattet.

Manager Thomasch zeigt sich erfreut: „Eine so bedeutsame und international anerkannte Einrichtung wie die MPCDF mit einem Lenovo-System auszustatten, ist etwas Besonderes.“

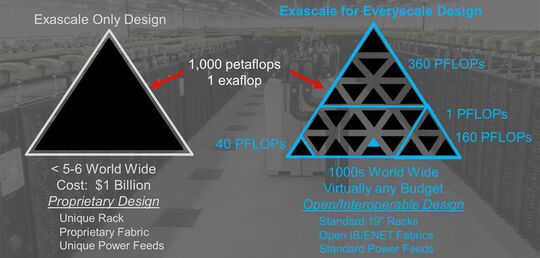

From Exascale to Everyscale

Scott Tease, General Manager HPC &AI der Lenovo Datacenter Group, hebt in einem Blog-Beitrag hervor, dass die Neptune-Flüssigkeitskühlungstechnologie schon auf mehr als ein Jahrzehnt der Konstruktion und gemeinsamen Entwicklung mit unseren Kunden zurückblickt. Dabei hat der Hersteller hat die Technik kaskadiert und dabei neue Wege beschritten, um deren Vorteile nicht nur großen HPC-Clustern anbieten zu können. Kunden sollen auch ohne zusätzliche Rohrleitungen auskommen. Mit vollständig geschlossenen, flüssigkeitsgekühlten Systemen können sie auch in luftgekühlten Rechenzentrum eine höhere Dichte und Effizienz erreichen.

Er sagt: „Wir haben auch Pionierarbeit bei der Server-Entwicklung geleistet, die als `Integrierte Modularität´ bezeichnet wird. In der Vergangenheit war die Entwicklung eines Servers dem Bau eines Schweizer Taschenmessers sehr ähnlich: Ein Server musste auf alles und jedes Ereignis vorbereitet sein, was zwangsläufig zusätzliche Funktionen, die Sie nicht nutzen würden, unnötige Kosten und mangelnde Optimierung mit sich brachte. Mit der integrierten Modularität haben wir bei unserem Serverdesign ein Baukasten-Prinzip gewählt, so dass Sie die für ihre Workloads richtigen, optimierten Komponenten auswählen können, und diese bei Bedarf während des Betriebs auch austauschen können, ohne den Server demontieren zu müssen.“ Lenovo bezeichnet das Prinzip „from Exascale to Everyscale“.

Eine neue Technikära

Nun läute Nvidia mit der „Ampere“-Architektur und der dritten Generation von „Nvidia NVLink“ die nächste Generation ein. „In Verbindung mit der Wärmetechnik und Systemdesign werden wir skalierbare Rechenleistung für Unternehmen jeder Größe liefern“, kündigt Tease an. 2008 habe es es fast 300 Serverschränke und 3.000 Server zum Preis von 100 Millionen Dollar gebraucht, um die PetaFlop-Grenze zu erreichen. „In Zukunft braucht es dafür nur noch die Hälfte eines einzigen Racks“, wenn Lenovo-Technik mitsamt Neptune, der Mellanox-Netzwerktechnik und A100 Tensor Core GPUs eingesetzt würden.

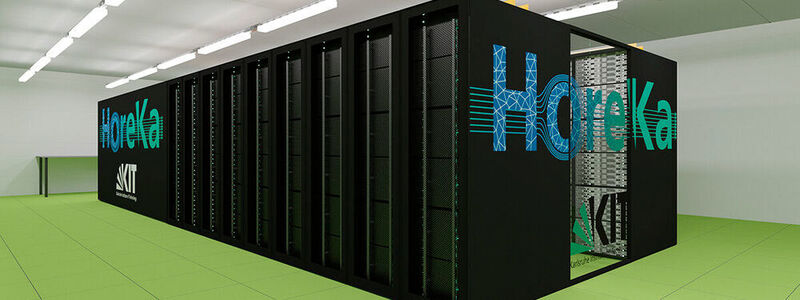

Das neue KIT-System

Zu den Kunden zählt auch das Karlsruher Institut of Technology, kurz KIT. Hier geht es um 17 PetaFlops Spitzenlast, die mithilfe von 785 Servern bereitgestellt werden. Diese sind wiederum mit 59.356 CPU-Kernen bestückt, die von 740 A100 GPUs unterstützt werden, und rund 240 Terabyte Memory-Kapazität bieten.

Als Kommunikationsnetzwerk kommt ein non-blocking Nvidia Mellanox Infiniband-HDR-Netzwerk mit 200 Gigabit pro Sekunde pro Port zum Einsatz, als Datenablage dienen zwei parallele Spectrum-Scale-Dateisysteme mit einer Gesamtkapazität von mehr als 15 Petabyte. Das Unternehmen Pro-com Datensysteme GmbH aus Eislingen bei Stuttgart übernimmt als Generalunternehmer die Projektkoordination, Systemintegration, Lieferung und Kundenbetreuung.

Ab Herbst 2020 stellt das KIT die erste Aufbaustufe eines neuen Supercomputers für viele Fachgebiete bereit. Das Gesamtsystem wird im Sommer 2021 der Wissenschaft übergeben. Der nun unterzeichnete Liefervertrag hat eine Größenordnung von 15 Millionen Euro. Der neue „Hochleistungsrechner Karlsruhe“, kurz: HoreKa wird dann voraussichtlich zu den zehn leistungsfähigsten Rechnern Europas gehören mit etwa 17 Billiarden Rechenoperationen in der Sekunde, was der Leistung von mehr als 150.000 Laptops entspricht.

Rechnen und Speichern gehen Hand in Hand

Ein zentraler Gesichtspunkt bei der Auslegung des Systems waren auch die enormen Datenmengen, welche bei wissenschaftlichen Forschungsprojekten anfallen. Je nach Anwendung können von einer einzigen Simulation mehrere Hundert Terabyte an Daten erzeugt werden. Um mit den wachsenden Datenmengen Schritt zu halten, liefern die Rechenknoten, das Infiniband-Netzwerk und die parallelen Dateisysteme von HoreKa im Vergleich zum Vorgängersystem „ForHLR“ jeweils einen bis zu vier Mal höheren Speicherdurchsatz.

Eine mehrstufige Datenhaltung soll zusätzlich die Weiterverarbeitung auf externen Speichersystemen mit hohem Durchsatz garantieren. HoreKa ist auch mit bis zu 45 Gigabyte pro Sekunde Datenrate an die „Large Scale Data Facility“ (LSDF) des SCC angebunden, die seit 2010 die Infrastruktur für die Speicherung, Verwaltung, Archivierung und Analyse von Forschungsdaten beritstellt.

Das System wird Wissenschaftlerinnen und Wissenschaftlern aus ganz Deutschland zur Verfügung stehen. Vor allem in den Materialwissenschaften, den Erdsystemwissenschaften, der Energie- und Mobilitätsforschung im Ingenieurwesen, den Lebenswissenschaften, sowie der Teilchen- und Astroteilchenphysik werden Forschende dank des neuen Supercomputers ein detaillierteres Verständnis hochkomplexer natürlicher und technischer Vorgänge erlangen können. „Selbstverständlich“ könne HoreKa bei Bedarf auch von Wissenschaftlern genutzt werden, die zum Verständnis des Virus SARS-CoV-2 forschen und damit zur Bekämpfung der Krankheit COVID-19 beitragen, teilt das Institut mit.

So erläutert Professor Martin Frank, Direktor des Steinbuch Centre for Computing (SCC) des KIT, dass mit HoreKa Forschende mehr Details in größeren Systemen betrachten, normale Simulationen also zu so genannten Multiskalen-Simulationen ausweiten können. „Klimasimulationen und Erdsystemmodelle etwa werden immer feinere Auflösungen und damit einen höheren Detailgrad erreichen. Doch neben der reinen Rechenleistung steigen auch die Anforderungen an die Dateisysteme immer weiter, sowohl was Kapazität als auch Latenz angeht. Mit einem datenhungrigen System wie HoreKa setzen wir konsequent die strategische Ausrichtung des SCC auf datenintensives Rechnen fort.“

HoreKa wird vollständig im 2015 für den Vorgänger ForHLR neu errichteten Rechnergebäude auf dem Campus Nord des KIT untergrebracht. Auch hier kommt Neptune zum Einsatz, so dass Lenovo und das KIT deshalb mit einem gesamten Strombedarf rechnen, der unter 1 Megawatt liegt.

Wofür wird HPC gebraucht?

Aktuell hat das Kit einen neuen Forschungsschwerpunkt geschaffen: „Nachhaltige Produktion“. Hier geht es etwa darum wie die Unternehmen mithilfe autonomer Produktionssteuerung, der Reduktion von Verschleißteilen oder den Prinzipien einer ressourcenschonenden Fertigung den Produktionsprozess verbessern können. Angesiedelt ist die Forschung beim WBK Institut für Produktionstechnik.

Letztlich sollen Unternehmen weg von einem linearen Wirtschaftsansatz zu zirkulären Ansätzen einer Kreislaufwirtschaft. Diese beinhalten das Remanufacturing, also die Wiederaufbereitung gebrauchter Produkte, mit modularen Anlagen zur De- und Remontage, autonomer Produktionssteuerung und integrierter Qualitätssicherung sowie Produktionsnetzwerke und Geschäftsmodelle.

Ein anderes Thema der aktuellen Forschung am KIT sind mikrobielle Cyborgs“ in Brennstoffzellen, Biosensoren oder Bioreaktoren. Noch bestehen elektronische Geräte aus unbelebten Materialien, doch eines Tages können diese nützlich sein. Wissenschaftlerinnen und Wissenschaftler haben hierzu die Voraussetzung geschaffen, indem sie ein programmierbares, biohybrides System entwickelten, das aus einem Nanokomposit-Material und dem Elektronen produzierenden Bakterium Shewanella oneidensis besteht. Das Material dient als Stützgerüst für die Bakterien und leitet zugleich den mikrobiell erzeugten Strom.

Artikelfiles und Artikellinks

(ID:46583262)

:quality(80)/p7i.vogel.de/wcms/f0/55/f05563d06ec1adfe9418965c8198361e/0131573273v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/97/ae97c2dc5b160060993cc8c12d2c6760/0131604900v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/3a/663ae529db74f304708a26681d66b273/0131573284v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bf/a9/bfa9522af622dfe0fca8fcf1ae0f157b/0131569943v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/86/15/86152540923c089f2f69da6b62f2f0a5/0131647678v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/3b/163bc234d4d71264517ebbeffaf9910b/0131633516v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f8/90f8635e66eeec5e1585ce3a269d5316/0131650168v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/48/a0/48a062512b997888422d6fd83a7552f0/0131634933v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0a/83/0a8371885d52666e74c9b549a0a6050e/0131542674v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/6b/35/6b3528ecb1548d836b815c159a772d72/0131318428v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/80/6e803451356aedef2f7983857510d019/0131541101v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ab/da/abda4198eec4667e63121b4038eb9696/0127011549v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e0/98/e09817246d3203a4b491b223997c76dd/0131317840v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/b8/36b8ba441409b46b71455151dfc60538/0131002266v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/0c/20/0c2056ff1bf1bcb98586ca6c68d037f6/0131658852v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b4/35/b435d8950fd8d2a2c9c257aebce9f901/0131650764v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3b/0a/3b0a6454f10da767b7bee189834df9b7/0131639288v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/5d/6c/5d6cd85b4158d85fb69241d2a91421fb/0131626686v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/63/e5/63e5f25ac31ef/logo.png)

:fill(fff,0)/p7i.vogel.de/companies/68/2d/682dd583dcc4c/fsas-afc-horizontal-2-positive-rgb-nov24.png)

:fill(fff,0)/p7i.vogel.de/companies/65/65/6565ddb7b8418/dcg-wort-bild-marke-dark-rgb.jpeg)

:quality(80)/p7i.vogel.de/wcms/4b/6f/4b6f8cc555057a3956ca108724ce750d/0125785083v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b1/e8/b1e8e3f62dfd4dfc9a0fb1174e592c9d/0125456120v1.jpeg)