Die Datacenter-Ausfallstatistik des Uptime Institute Software ist das Risikomonster für Rechenzentrums-Outages und SLAs die Fabelwesen

In seiner jährlichen Analyse geht das Uptime Institute Rechenzentrumsausfällen weltweit nach. Besseres IT-Management und COVID-19 scheinen dazu beigetragen zu haben, dass weniger passiert ist als im vorangegangenen Berichtszeitraum.

Anbieter zum Thema

Fällt ein Rechenzentrum teils oder vollständig aus, ist das für den Betreiber der Super-GAU. Die in solchen Situationen entstehenden Schäden sind seit jeher hoch und nehmen weiter zu.

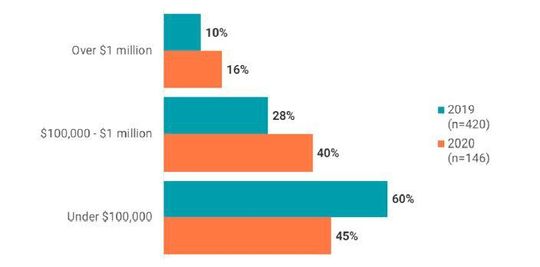

Obwohl die Datenlage zu den Kosten von Ausfällen eher schlecht ist, liefert Uptime in seiner Ausfallanalyse 2021 hierzu mit diesen Unsicherheiten behaftete Zahlen. So lag der Schaden im Jahr 2020, über das der 2021er Report berichtet, bei 56 Prozent der Ausfälle über 100.000 Dollar. Im vorherigen Bericht, dem Daten aus 2019 zugrunde lagen, befanden sich noch 60 Prozent der Ausfall-Fälle unter dieser Schwelle.

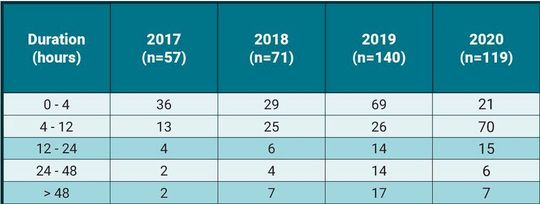

Die Dauer von Datacenter-Ausfällen entwickelt sich uneinheitlich. Während sich die Menge der Ausfälle, die bereits nach vier Stunden behoben waren, gegenüber dem Vorbericht um mehr als zwei Drittel verringerte (2019: 69, 2020:21) , gilt das Gegenteil für Störungen, deren Behebung vier bis zwölf Stunden dauerte (2019:26, 2020: 70). Sehr lange Störungen (über 24 Stunden) dagegen nahmen um die Hälfte ab, allerdings gehörten 2020 nur 13 Ausfälle zu diesem Typ.

Insgesamt steigt die Zuverlässigkeit von Rechenzentren

Die Zuverlässigkeit ist trotzdem gestiegen: Es gibt zwar mehr Ausfälle, sie nehmen aber langsamer zu als die rasant wachsende Zahl der Rechenzentren. Verteilte Resilienz und die dafür nötigen Softwaretechnologien befinden sich nach Auffassung des Uptime Institute „noch in den Kinderschuhen“. Das ist ein Grund dafür, warum Fehlkonfigurationen, Softwarefehler und Netzwerkprobleme einen größeren Anteil der Ausfälle verursachen als früher.

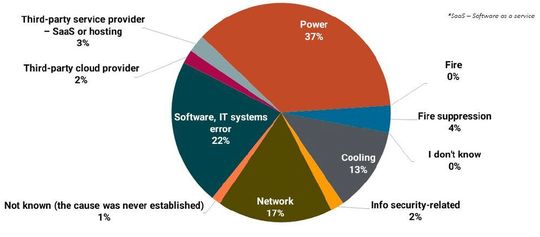

Der wichtigste Grund für Rechenzentrumsausfälle ist aber nach wie vor der Stromausfall mit 37 Prozent, danach folgen allerdings Software, IT-Systemfehler (22 Prozent), das Netzwerk (17 Prozent) und die Kühlung (17 Prozent). Erstaunlicherweise werden nur 2 Prozent der Ausfälle auf IT-Security-Ursachen zurückgeführt.

Uptime gewinnt seine Daten aus unterschiedlichen Quellen: aus einer internen, vertraulichen Datenbank, aus selbst durchgeführten, globalen Umfragen unter Datacenter-Managern und aus den Medien, die inzwischen oft über größere Rechenzentrumsausfälle berichten. Außerdem werden ab dem aktuellen Jahrgang unwesentliche Ereignisse, die kaum oder keine Auswirkungen haben, nicht mehr in die Datensammlung einbezogen. Legt man die Berichte in Medien zugrunde, sind es sogar 42 Prozent der Ausfälle, an denen Software- oder Konfigurationsfehler schuld sein sollen.

Provider-Probleme nehmen stark zu

Trotz der Vorkehrungen, die kommerzielle Rechenzentrums- und as-a-Service-Anbieter treffen, entfallen fast drei Viertel (72 Prozent) aller für die Studie berücksichtigten Ausfälle 2020 auf diese Art von Rechenzentren. Das ist gegenüber dem Fünf-Jahres-Durchschnitt ein Anstieg um 19 Prozent. Das Uptime Institute erklärt ihn damit, dass Provider heute einen höheren Marktanteil hätten, wobei der Datenverkehr durch COVID-19 nochmals gesteigert wurde.

Nach Angaben des Uptime Institute haben 56 Prozent aller Organisationen, die Rechenzentren von Drittparteien nutzen, in den vergangenen Jahren ein durch diese Drittpartei verursachtes mittleres oder großes Problem erlebt. Überproportional auch im Vergleich zu den Vorjahren waren hier Cloud/Service- und Telekom-Provider von Ausfällen ihrer Rechenzentren betroffen, was auch auf die vermehrte Nutzung ihrer Services während der Pandemie zurückgeführt werden kann.

Provider-Ausfälle: Oft Software- und Konfigurationsfehler schuld

Bei Providern waren – anders als in der übergreifenden Analyse - Software- und Konfigurationsfehler die wichtigste Ursache von Ausfällen. Das deutet darauf hin, dass die sich derzeit rasant verändernden Softwaretechnologien, zum Beispiel in puncto Software-Container, entweder in sich noch instabil sind oder aber noch nicht sicher gehandhabt werden.

Meist lässt ausgerechnet die Unterbrechungsfreie Stromversorgung (USV) die Energieversorgung zusammenbrechen. USV-Fehler wiederum werden besonders gern von ausfallenden Lüftern, altersschwachen Kondensatoren und gealterten Batterien sowie selten von überlasteten Wechselrichtern verursacht.

Auch das Alter der Uninterruptible Power Supply spielt eine Rolle. Weitere wichtige Ursachen von Stromproblemen sind Transformatoren und Generatoren.

Netze werden gerne fehlkonfiguriert

Bei den Netzwerkfehlern liegen Konfigurationsfehler und Probleme, die bei Veränderungen an der Infrastruktur entstehen, vorn. Oft genug versagen auch die Verbindungen von Netzprovidern, Firmware- und Softwarefehler sind sehr verbreitet. Weitere Fehlerquellen: Unwetter und Naturkatastrophen, Netzüberlastung, korrupte Firewalls und Cyber-Angriffe. Besonders kritisch sind naturgemäß Kreuzungspunkte zwischen Netzverbindungen.

Da Uptime Institute empfiehlt zur Vermeidung solcher Fehler vor allem Investitionen in Systeme und das Training der Mitarbeiter. Gern vernachlässigt werden Redundanz, ständige Überwachung, Diagnose von Fehlern und Investitionen in die schnelle Wiederherstellbarkeit.

Niemals unterschätzen: Human Error

Fehler, die Menschen machen, sind noch immer eine extrem häufige Ursache von Ausfällen. So legt die Analyse der Daten aus der internen Störungsdatenbank des Uptime Institute nahe, dass 63 Prozent der dort gespeicherten Fälle auf menschliche Fehler zurückgehen. Die aktuelle Analyse kommt quellenübergreifend darauf, dass an 42 Prozent der Ausfälle in den vergangenen drei Jahren Menschen maßgeblich beteiligt waren.

Dass Menschen Fehler machen, liegt gemäß den Analysen des Uptime Institute zumeist daran, dass sie vorgeschriebenen Prozessen nicht folgen oder dass diese Prozesse selbst falsch beschrieben oder konzipiert sind. Auch hier sollten Aus- und Weiterbildung sowie Übung das Schlimmste verhindern.

Gegen falsch designte Prozesse hilft nur mehr Sorgfalt bei ihrer Entwicklung. So sollten Prozesse unter realistischen Bedingungen getestet werden, ehe man sich auf sie verlässt. Das scheint häufig zu unterbleiben.

Märchen und Fabelkennzahlen

Warum auch immer es zu Ausfällen kommt – und drei von vier Befragten gaben an, dass sie in den vergangenen Jahren mindestens einen Datacenter-Ausfall erlebten – das Thema nimmt im Denken von Rechenzentrumsbetreibern breiteren Raum ein als bisher. 44 Prozent der befragten Rechenzentrumsbetrieber und sogar 59 Prozent der Hersteller und Lieferanten denken, dass die Beschäftigung mit Resilienzfragen in den vergangenen zwölf Monaten zugenommen hat. Das könnte beispielsweise auf gesetzlich verschärfte Zuverlässigkeitsanforderungen an Datacenter-Betreiber, in Europa etwa durch die DSGVO oder das nunmehr novellierte IT-Sicherheitsgesetz, zurückzuführen sein.

Es wird auch höchste Zeit, mehr über Resilienz nachzudenken. Denn die Uptime-Institute-Daten legen, so das Institut, auch noch einen anderen Schluss nahe: Gern veröffentlichen Rechenzentrums- und aaS-Provider Verfügbarkeitsdaten und SLAs, die zum Beispiel „drei bis vier Neunen“ versprechen. Das Institut kommt beim Abgleich der vorliegenden Informationen zu Zahl und Dauer der registrierten Datacenter-Ausfälle mit den SLA-Bedingungen zu dem Schluss, dass es sich hier oft genug um fromme Märchen handelt.

SLA-Illusionen

Das fängt schon damit an, dass der Zeitbezug von SLAs oft nicht klar ist: Wenn eine Verfügbarkeit von „x Neunen“ zugesichert wird, ist dies in der Regel ein Durchschnittswert. Ob die im Rahmen der Prozentzahl zu tolerierenden Ausfallstunden in Fünf-Minuten-Portionen übers Jahr verteilt oder auf einmal anfallen, steht oft nirgends.

Das ist aber entscheidend dafür, welche Auswirkungen Ausfälle (oder der eine große Ausfall) auf die Kunden haben. Das Uptime Institute rät Anwendern daher, sich lieber nicht allzu sehr auf derartige SLA-Angaben zu verlassen, sondern beispielsweise eigene Messungen zur Verfügbarkeit eines bestimmten Service vorzunehmen. Das gelte unabhängig davon, ob es sich um einen internen, einen externen oder einen Co-Location-Service-Provider handele.

Das ist ärgerlich. Die Branche sollte sich in ihrem eigenen Sinne überlegen, wie SLA-Vereinbarungen so ausgehandelt werden können, dass sie tatsächlich die im Normalfall zu erreichende Dienstgüte und -verfügbarkeit beschreiben.

(ID:47406011)

:quality(80)/p7i.vogel.de/wcms/f8/9f/f89fc5b3ceb14b7ab5e18dc27342229e/0131606788v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/0e/03/0e032c8ef5c1fbf81895e76d1d030977/0131669954v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f0/55/f05563d06ec1adfe9418965c8198361e/0131573273v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/97/ae97c2dc5b160060993cc8c12d2c6760/0131604900v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/86/15/86152540923c089f2f69da6b62f2f0a5/0131647678v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a2/de/a2de7cb23cfbecebc9d41861fcd04b3b/0131646536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f8/90f8635e66eeec5e1585ce3a269d5316/0131650168v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/48/a0/48a062512b997888422d6fd83a7552f0/0131634933v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0a/83/0a8371885d52666e74c9b549a0a6050e/0131542674v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/6b/35/6b3528ecb1548d836b815c159a772d72/0131318428v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/80/6e803451356aedef2f7983857510d019/0131541101v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ab/da/abda4198eec4667e63121b4038eb9696/0127011549v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bf/a9/bfa9522af622dfe0fca8fcf1ae0f157b/0131569943v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/b8/36b8ba441409b46b71455151dfc60538/0131002266v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/0c/20/0c2056ff1bf1bcb98586ca6c68d037f6/0131658852v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b4/35/b435d8950fd8d2a2c9c257aebce9f901/0131650764v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3b/0a/3b0a6454f10da767b7bee189834df9b7/0131639288v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/5d/6c/5d6cd85b4158d85fb69241d2a91421fb/0131626686v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/60/de/60ded37a20a00/logo-vertiv.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/66/c3/66c33d1f71ef2/daxten-logo-600-x-600.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/60/2a/602a8645d40e9/200226---derz-logo.jpg)

:quality(80)/p7i.vogel.de/wcms/77/a6/77a6f7fe98582eb0601098576ff045d6/0125506032v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/1b/3a/1b3a7720cd028ee584f168d27fa7d539/0126590894v3.jpeg)