Prognose des Uptime Institute für 2022 Mehr Regulierung, mehr Prozessorvielfalt, mehr Druck auf Nachhaltigkeit

Die Datacenter-Branche muss sich im kommenden Jahr auf mehr Regulierung und Verantwortlichkeit sowie erhöhten Nachhaltigkeitsdruck einstellen. Die Intel-Monokultur kehrt wohl nicht zurück.

Anbieter zum Thema

Das Uptime Institut hat wie jedes Jahr fünf wichtige Trends für die kommenden zwölf beziehungsweise mittlerweile noch gut elf Monate geliefert. Die Autoren der Studie sind Andy Lawrence, Rhonda Asciertò, Daniel Bizo und Tomas Rahkonen.

Das Uptime Insitute betont, dass man sich in diesem Jahr weniger sicher sei als üblich, in welchem Umfang sich die eigenen Prognosen bewahrheiten werden. Sie betreffen unterschiedliche Bereiche, versprechen aber vor allen Dingen eines: Trotz des hoffentlich abklingenden COVID-19-Drucks wird das Rechenzentrumsjahr 2022 alles andere als langweilig.

Mehr Diversifizierung beim Chipangebot

Die vergangenen Jahre waren gekennzeichnet von steigender Serverleistung bei sinkender IT-Energie-Effizienz. Das bedeutet: Kosten, Energieverbrauch und Kohendioxidausstoß der Rechenzentren erhöhten sich trotz sinkender PUEs.

Obwohl Intel mit seiner neuen, im Frühjahr 2022 zu erwartenden 10-Nanometer-Serverprozessorgeneration „Intel 7“ Leistungsdichte und Effizienz erhöhen wird, bringt das den Chipgiganten, so meint Uptime, nicht zurück zum alten Grad seiner Marktdominanz. Gewinner dieses Trends ist AMD mit seinem laufend ausgebauten Portfolio sehr leistungsfähiger und effizienter Produkte. Profitieren könnten auch Grafikchip-Spezialist Nvidia und einige Hyperscaler sein. So haben AWS und auch der chinesische Hyperscaler Alibaba mit dem Aufbau eigener Cloud-Server-Plattformen begonnen.

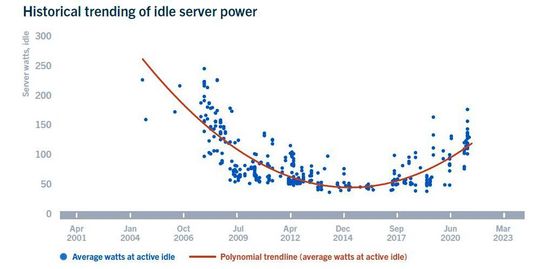

Server mit mehr als 100 Kernen werden bald nichts Besonderes sein, was mehr Workload-Konsolidierung ermöglicht. Besonders wichtig ist dies laut Uptime Institute angesichts der Tatasache, dass der Leerlaufstrom der Server wieder ansteigt. Nur wer Server bestmöglich auslastet, entgeht dieser Effizienzfalle.

Die Software muss besser auf die Hardware zugeschnitten werden, um deren technische Möglichkeiten auszunutzen. Das erfordert teilweise substantielle Veränderungen der Applikationen. Wer über die nötigen Fähigkeiten und Ressourcen verfügt, kann so Leistung und Effizienz seiner Infrastruktur deutlich erhöhen.

Nachhaltigkeit als Branchen-Topziel bleibt umstritten

Die Handlungs- und Dokumentationspflichten für mehr Klimaschutz sind komplex und wachsen. Sie verlangen größere Anstrengungen und Umstellungen von den DC-Managern. Deshalb darf man diesbezüglich nicht auf deren Begeisterung zählen. Ein Tauziehen zwischen Klimaschutz-Stakeholdern und der Datacenter-Branche ist vorhersehbar, zumal die Rechenzentrumsmanager der Datacenter-Fachkompetenz von Regulierungsbehörden misstrauen.

Die bisherigen freiwilligen Verpflichtungen waren allerdings meist nicht strikt genug und werden wohl durch Pflichtberichterstattung und Vorgaben samt Sanktionen ergänzt oder ersetzt werden. Vorreiter ist hier die EU, die schon Rechenzentren ab 300 bis 400 Kilowatt Last unter Energie-Effizienz-Auditierungspflicht stellen will.

:quality(80)/images.vogel.de/vogelonline/bdb/1918900/1918989/original.jpg)

PeerDC - der Aufbau eines Datacenter-Registers zur Bewertung der Energie-Effizienz

Die Intention: Ein Bewertungssystem für Rechenzentren

:quality(80)/images.vogel.de/vogelonline/bdb/1918000/1918057/original.jpg)

Blaue Engel für Rechenzentren und Datacenter-Services bekommen frisches Grün

UBA-Frau Marina Köhn: „Am Ende soll eine Energiekennzeichnung für Rechenzentren stehen.“

Zwist in der Datacenter-Branche ist vorgezeichnet

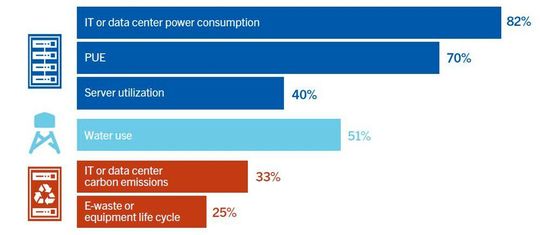

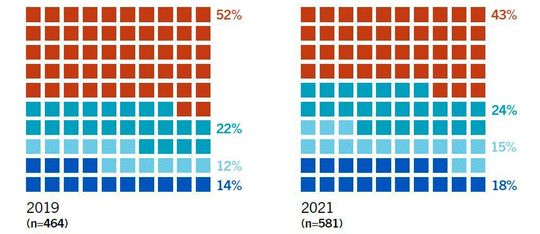

Da die Nachhaltigkeitsbemühungen sich zwischen den unterschiedlichen Datacenter-Größenordnungen -Geschäftsmodellen signifikant unterscheiden, wird dies zu Uneinigkeit in der Branche führen. Deren Wille zur Informationsbereitstellung lässt teils zu wünschen übrig.

Besonderen Problemen sehen sich Co-Location-Anbieter gegenüber, da sie nicht beeinflussen können, welche IT in ihren Räumen genutzt wird. Diese Kunden müssen daher stärker für ihren Stromverbrauch verantwortlich gemacht werden. Auch das ist aber problematisch, da sie den genutzten Strom nicht selbst einkaufen.

Zudem fehlen noch immer zweckdienliche und praxistaugliche Maße für die Energie-Effizienz etwa von Servern in Bezug auf ihre Anwendungsleistung. Diese sei, so die Uptime-Institute-Vorhersagen, auch kaum schnell zu finden, da es sich um einen anwendungsspezifischen Wert handelt, den Anwender zudem am liebsten nicht publik machen wollen.

Datacenter-Betreiber forcieren Kernkraft als Energie-Option

Mit steigendem Druck in Richtung einer kohlendioxidfreien und wassersparsamen Energie-Erzeugung und gleichzeitig weiter wachsendem Strombedarf werde, so Uptime, auch die Bereitschaft steigen, nukleare Optionen wieder in Betracht zu ziehen. Dies betrifft sowohl die Industrie als auch politische Institutionen. Erste Manifestationen sind bereits auf europäischer Ebene zu besichtigen, wo Atomkraft zukünftig, wenn auch nur vorübergehend, als „grüne Energie“ gelten soll.

Viele Rechenzentrumsbetreiber könnten angesichts der Bezeichnung von Nuklearenergie als akzeptable Nullemissionsenergie im Rahmen des „EU Carbon Neutral Data Centre Pakt“ (siehe: „Nachhaltiges Bewirtschaften der Rechenzentren Klimapakt der europäischen Datacenter-Betreiber“ ihre individuelle Ausrichtung auf erneuerbare Energien überdenken. Dies scheint bei AWS, Google und Microsoft bereits der Fall zu sein, die auf ihren Webseiten Kernkraft als kohlenstoffarme Energie-Alternative erwähnen.

So könnte Atomstrom via Power Purchase Agreement (PPA), also Direktkauf ab Erzeuger, vermehrt zum Einsatz kommen – auch, um Preisschwankungen bei Erneuerbaren durch erhöhte Nachfrage zu entgehen.

Betreiben Provider zukünftig nukleare Kleinanlagen?

Allerdings müssten dafür neue Nuklearanlagen errichtet werden. Doch werden bereits Entwicklungsanstrengungen für kleinere, modulare und mit passiven Sicherheitsanlagen ausgerüstete nukleare Energie-Erzeugungsanlagen mit 10 bis 100 Megawatt von verschiedenen Staaten wie USA, Korea und Frankreich finanziert.

:quality(80)/images.vogel.de/vogelonline/bdb/1893900/1893919/original.jpg)

Und? Was halten Sie von Atomkraft für Rechenzentren?

Rolls Royce plant nukleare Reaktoren für Rechenzentren

Solche Kleinanlagen könnten dann von großen Providern direkt betrieben werden. Die Wahrscheinlichkeit für solche Entwicklungen erhöht sich durch den stetig steigenden Strombedarf der IT – die ungelöste Frage der Entsorgung wird dadurch aber wieder einmal hintangestellt.

Kritische Lasten: Noch ist die Cloud kein sicherer Ort dafür

Anwender misstrauen zusehends der Konzentration ihrer Applikationen bei einem Cloud-Provider. Wegen der oft fehlenden Transparenz in Bezug auf Daten zur Betriebssicherheit und Resilienz wird die Cloud teils als Single Point of Failure betrachtet, über die der Inhaber der Applikation wenig bis keine Kontrolle hat. Gleichzeitig zwingt die Komplexität des Multicloud-Betriebs viele Anwender zur Auswahl nur eines Cloud-Betreibers.

Resilienz bedeutet dabei, dass selbst bei Ausfall von Services oder Rechenzentren eine Fortführung oder sehr schnelle Wiederaufnahme des Betriebs garantiert ist. Angebotene Resilienzmechanismen wie Verfügbarkeitszonen oder komplexe Backup-Mechanismen helfen nur teilweise. 2020 registrierte das Uptime Institute 21 Ausfälle von Cloud- oder Internet-Giganten mit signifikanten negativen Konsequenzen. Das führt teils zum Eingreifen des Regulierers wie beispielsweise in der EU.

Als Konsequenz versuchen diverse Anbieter, den Multicloud-Betrieb zu vereinfachen. Allerdings ist das Internet so komplex miteinander vernetzt, dass kaum vorhersehbare Wechselwirkungen zwischen Services unterschiedlicher Provider vorkommen können. Zudem konzentriert sich die Kontrolle der Gesamtstruktur sich auf zu wenige Anbieter, deren Services nicht interoperieren.

:quality(80)/images.vogel.de/vogelonline/bdb/1922000/1922033/original.jpg)

Ausfallbilanz Rechenzentren 2021

Uptime Institute: Weniger Ausfälle, höhere Schäden im Datacenter

Anwender fordern daher mehr Infrastruktur- und Risikotransparenz, so dass noch mehr Regulierung in diesem Bereich zu erwarten ist. Ein Beispiel ist der von der EU vorgeschlagene DORA (Digital Operational Resiliency Act), das Finanz-Regulierungsbehörden zur Aufsicht über Cloud-Provider berechtigt. Kaum zu erwarten, dass Datacenter-Manager das erfreut.

Lieferkettenprobleme erzwingen Standardisierung und Skalierung

Viele Lieferketten wurden während der COVID-19-Pandemie löchrig und langsam, was Knappheit und Preissteigerungen beförderte. Rechenzentrumsbetreiber müssen das kompensieren. Gleichzeitig besteht die Erwartung, dass die Bauzeit von Rechenzentren wie seit Jahren weiter sinkt.

Mechanismen, die dies bewirken, sind IT-Verdichtung und Off-Site-Vorfertigung beispielsweise von containerisierten Kühlsystemen oder Stromversorgungsanlagen. Das erfordert mehr Zusammenarbeit zwischen allen Beteiligten bis hin zum gemeinsamen Entwurf von Komponenten.

Gleichzeitig versuchen sich Anwender abzusichern, indem sie für dieselben Komponenten mehrere Lieferanten einbeziehen, um jederzeit über eine Zweitquelle zu verfügen. Wer genügend finanzielle und personelle Ressourcen hat, kann auch eigene Prognosen mit einem Monitoring der betreffenden Lieferanten verbinden. Allerdings steht solchen aufwändigeren Ansätzen oft die Personalknappheit entgegen, die sich laut Uptime Institute auch 2022 fortsetzen wird – genau wie Unterbrechungen und Störungen der Lieferketten.

Kleine Rechenzentren stehen stärker unter Druck

Insgesamt bevorteilen diese Trends große, leistungsfähige und mit gewisser Kaufmacht ausgestattete Provider, während kleinere 2022 unter verstärkten Druck geraten. Denn meist haben sie weder ausreichende Mittel, um sich mehr Personal zu beschaffen, noch besitzen sie die nötigen Ressourcen, um beispielsweise selbst Prozessoren zu entwickeln.

Ihre Marktmacht ist beschränkt. Es ist also nicht zu hoch gegriffen, die weitere Konsolidierung gerade der mittelständischen Datacenter-Branche zu erwarten.

(ID:47962453)

:quality(80)/p7i.vogel.de/wcms/f8/9f/f89fc5b3ceb14b7ab5e18dc27342229e/0131606788v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/0e/03/0e032c8ef5c1fbf81895e76d1d030977/0131669954v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f0/55/f05563d06ec1adfe9418965c8198361e/0131573273v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/97/ae97c2dc5b160060993cc8c12d2c6760/0131604900v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/86/15/86152540923c089f2f69da6b62f2f0a5/0131647678v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a2/de/a2de7cb23cfbecebc9d41861fcd04b3b/0131646536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f8/90f8635e66eeec5e1585ce3a269d5316/0131650168v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/48/a0/48a062512b997888422d6fd83a7552f0/0131634933v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0a/83/0a8371885d52666e74c9b549a0a6050e/0131542674v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/6b/35/6b3528ecb1548d836b815c159a772d72/0131318428v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/44/dd444ffd9fdf1be2fb62dcc9e40e085f/0131240534v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/5b/f45bcf8db2cc67b07fd0378cc3300f4f/0130884384v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/ff/42ff4fc17a11a3fa7065cefc168ef25d/0130824377v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/c4/63c4700dcf2d980c5a5c4ed41890c62b/0130812458v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6e/80/6e803451356aedef2f7983857510d019/0131541101v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a7/78/a778073f09b71e34b258aadcc396f100/0130856536v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ad/e9/ade9d0a11085d64eaaacbe51d683beca/0130726498v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/b3/e7b349f9bb427752fd3f4ae4c52c957d/0130852653v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/b7/16b7b2637f84403b141e992af44500d9/0131265177v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/6c/2c6ceaad30aeee8c46974275a39c1717/0131220620v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b8/26/b82629c5b95d15047e5489328a63a6e0/0131192769v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ab/da/abda4198eec4667e63121b4038eb9696/0127011549v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bf/a9/bfa9522af622dfe0fca8fcf1ae0f157b/0131569943v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/b8/36b8ba441409b46b71455151dfc60538/0131002266v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d9/e4/d9e4f7b94025360fa28245bfccc07ada/0130927746v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f9/aef9cef6337f8d1593202170a319e812/0130764658v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/0c/20/0c2056ff1bf1bcb98586ca6c68d037f6/0131658852v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b4/35/b435d8950fd8d2a2c9c257aebce9f901/0131650764v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3b/0a/3b0a6454f10da767b7bee189834df9b7/0131639288v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/5d/6c/5d6cd85b4158d85fb69241d2a91421fb/0131626686v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/66/c3/66c33d1f71ef2/daxten-logo-600-x-600.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/67/92/67921e1a932db/logo-pqplus---rgb.jpeg)

:quality(80)/p7i.vogel.de/wcms/49/a0/49a0bb7a15339c8ba2bd4b9aaef4ff2a/0128861303v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b9/80/b980a323d683931084df752e1956d7cb/0127519887v1.jpeg)