Anbieter zum Thema

Wie behindern Legacy-Speicher-Architekturen die Virtualisierung

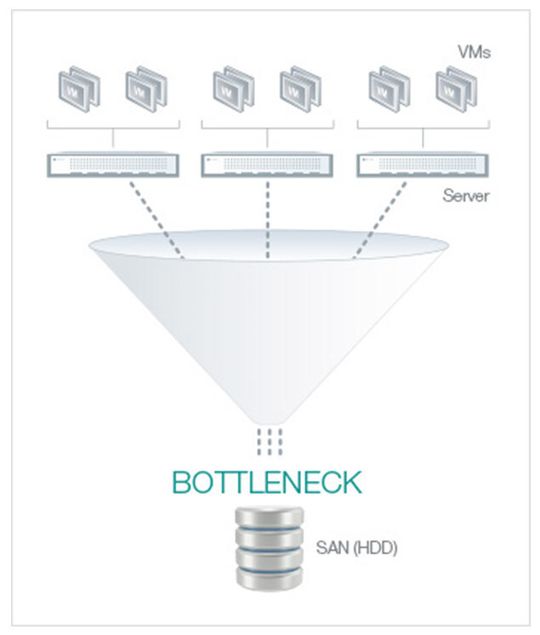

Wenn Server-Virtualisierung zu einer IT-Umgebung hinzugefügt wird, werden normalerweise alle Anwendungsdaten in den externen Aufbewahrungsorten oder Netzwerken (SANs) platziert, damit die Fähigkeit erhalten bleibt, alle Anwendungen dynamisch von jedem Server des Rechenzentrums laufen lassen zu können. Während Server Millionen von Input/Output Operations per Second (IOPS) verarbeiten können, liefert eine typische HDD nur eine Leistung von hundert bis zweihundert IOPS. Da mehr und mehr virtuelle Server Rechenzentren hinzugefügt werden, können HDDs innerhalb des SAN einfach mit den Server-Workload-Anforderungen mithalten (siehe: Abbildung 1)

Da viele Anwendungen zusammen laufen, werden diese kombinierten Speicherzugriffsanfragen vom Virtalisierungs-Layer gemischt, was viele Ransom-Zugriffe auf die Platten erzeugt, was als der „IO Blender Effekt“ bekannt ist. Aus diesem Grund erfordert Server-Virtualisierung starke Direktzugriffsfunktionen, die für HDDs das Größte Problem darstellen, weil deren physikalische Köpfe ständig von einem zum anderen Ort springen müssen.

Die Performance-Unterschiede zwischen Server und HDDs sind ziemlich offensichtlich und um diese zu überwinden (vor dem Aufkommen der Flash-Technologie), waren IT-Abteilungen gezwungen, Zehntausende HDDs zu kaufen, um die Server-IOPS-Leistungsanforderung zu erfüllen. Da jedes SAN mit seinen Hunderten von Festplatten weiter gewachsen ist, waren auch deutlich mehr Strom und damit verbundene Kühlsysteme erforderlich, was die Gesamtkosten (TCO) von Rechenzentren wiederum erhöht hat.

Fehleranfällige und behäbige Mechanik

Da mechanische HDDs fehleranfälliger sind, kommt erschwerend hinzu, dass komplexe Systeme für eine hohe Verfügbarkeit benötigt wurden, um Ausfälle einer HDD sowie Speicher-Arrays zu handhaben. Diese Systeme erhöhten weiterhin die Anzahl an benötigten HDDs als auch zusätzlicher Software auf dem SAN-Layer, um das System am Laufen zu halten, was noch mehr Kosten für das Rechenzentrum bedeutete.

Um den Effekt zu adressieren, den Virtualisierung auf HDD-Speicher hat, beschränkten IT-Profis die Anzahl an Virtuellen Maschinen (VMs), welche sie in jedem Host-System platziert hatten und hielten sich in einigen Fällen sogar zurück, empfindliche Loads (zum Beipsiel Datenbanken oder Email) in die virtuelle Umgebung zu leiten, da befürchtet wurde, dass diese Datenzugriffsmuster durch das Mischen der IO mit anderen VMs behindert werden würde. In diesen Fällen wurden isolierte, nicht virtualisierte Anwendungen erzeugt, welche die Infrastruktur- und Wartungskosten erhöhten.

Während IT-Profis dazu angehalten wurden, die Server-Virtualisierung als Mittel zur Kostensenkung im Rechenzentrum einzusetzen, wurden ihre Bemühungen durch die Mängel der Virtualisierung seitens der HDD-Speicher behindert. Bis vor kurzem wurde jede Virtualisierung, welche versuchte die Server-OPEX und –CAPEX zu reduzieren, ausgewogen, durch damit einhergehende, steigende Kosten für HDD-SANs. Leider wurde HDD-Speicher zu einem Bremsklotz der Virtualisierung, indem Unternehmen und Cloud-Anbieter davon abgehalten werden, die wahren Vorteile und damit verbundene Kosteneinsparungen zu realisieren.

(ID:42863855)

:quality(80)/p7i.vogel.de/wcms/4b/52/4b528e4b495a537cda6df2ae3eee775e/0130637010v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/1e/c2/1ec23ddf856d7a9ae248cd86978d6d5c/0130589195v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c7/07/c70741a9965866bd8d11097c7527434d/0130259722v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/fa/de/fade1fa6d93c07353e982a2a98ed034e/0130479899v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2c/11/2c11353be10b8aff5cfc4c83246199e9/0130640586v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8d/4b/8d4b9d1c35d906dd02a4016e67f0fb3f/0130590496v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/47/ba/47badbad12b88f76a54efdc53dcee47f/0130578281v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6d/59/6d59f3b9abe3ea5b8f5bcbe5de6be044/0130735419v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d4/5d/d45d3fc6c39a14238cdac4fff43da879/0130623645v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/8a/ba/8abadeb121d645fdb8fb5a68d6a4c9b8/0130541481v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/df/59/df596b0cd1c6e279e2a06aa94b0f0c73/0130621422v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/bf/d3/bfd3a10ee878513bdf4c27db38128ed0/0130670809v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/07/41/074132597ce1f888063b59ce3da8c344/0130320494v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/55/fe/55fe30fb3e4238e2da3996ee30316f7a/0130004524v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/54/69/5469ac4ce69d115dc6d6a4428b950932/0130145481v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/81/b3/81b359118a0e0e395cdebbddcfa03243/0130668020v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/93/91/9391c9624ce4cfd414eaed171c3e50b8/0130668778v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d4/dc/d4dc56ad5d2bb62d41a7b3e8b5fc75b0/0130593379v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/00/7b/007bb7da9316579cf326428b5c07611f/0130584185v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/7c/b2/7cb29edda7829fe4e9bae7b933475857/0130625445v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f2/19/f2191a91a4520cd144d2882ff289ba7d/0130322683v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/01/57/0157bd3a882ee5b00df773dc6ad30d64/0130317537v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/31/bd/31bda9357929b4ed0ef5ef78a0ee5fb6/0130327180v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/91/9c/919c50054f687fff00a31cc36c87e8cb/0129994860v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2b/24/2b24360375569a58afeaf1ffeaa339ae/0130711035v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/d7/f4d749968329f6af369d193ca86ec0d9/0130616681v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/21/64/2164611d7885eee82ea1892cae99dd5a/0130618575v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f3/da/f3dacd38e5834ae3f3c9d0a4bc9664d3/0113348475.jpeg)

:quality(80)/p7i.vogel.de/wcms/90/f5/90f56ec6cb3ddbdabca2162fd5477836/0113078524.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/09/0f097990002b7600075e43c92af4a3fd/0110524571.jpeg)

:quality(80)/p7i.vogel.de/wcms/66/ae/66ae9e32738784b57e2ad8c1a4b0986f/0109756744.jpeg)

:quality(80)/p7i.vogel.de/wcms/21/1c/211c24358dafb0b5433509e917e532b3/0130567036v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/5c/1e/5c1e606e8d54467bc29043a16a344dd7/0130157161v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/17/ab/17ab3338f508225455c868356603ca19/0130105849v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ee/3f/ee3f063b82737f0369c09ba7854587b5/0127234708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f1/f0/f1f007a4518fa65d3cb0ea5ca465142a/0121300054v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a8/28/a828f76369267628d833a12c26dd6579/0121131534v3.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/63/e5/63e5f25ac31ef/logo.png)

:fill(fff,0)/p7i.vogel.de/companies/66/c3/66c33d1f71ef2/daxten-logo-600-x-600.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/67/92/67921e1a932db/logo-pqplus---rgb.jpeg)

:quality(80)/p7i.vogel.de/wcms/01/57/0157bd3a882ee5b00df773dc6ad30d64/0130317537v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b6/b8/b6b861346b607b7ecc0b60dc45c46012/0129449658v1.jpeg)